OpenMythos, rilasciato su GitHub da Kye Gomez, si propone di reinterpretare in chiave open-source il funzionamento di Claude Mythos, modello sviluppato da Anthropic, senza accesso diretto al codice originale o a documentazione tecnica ufficiale. Questa operazione si colloca a metà strada tra reverse engineering concettuale e ricerca sperimentale, basandosi su ipotesi derivate da osservazioni indirette, pubblicazioni correlate e analisi comparative.

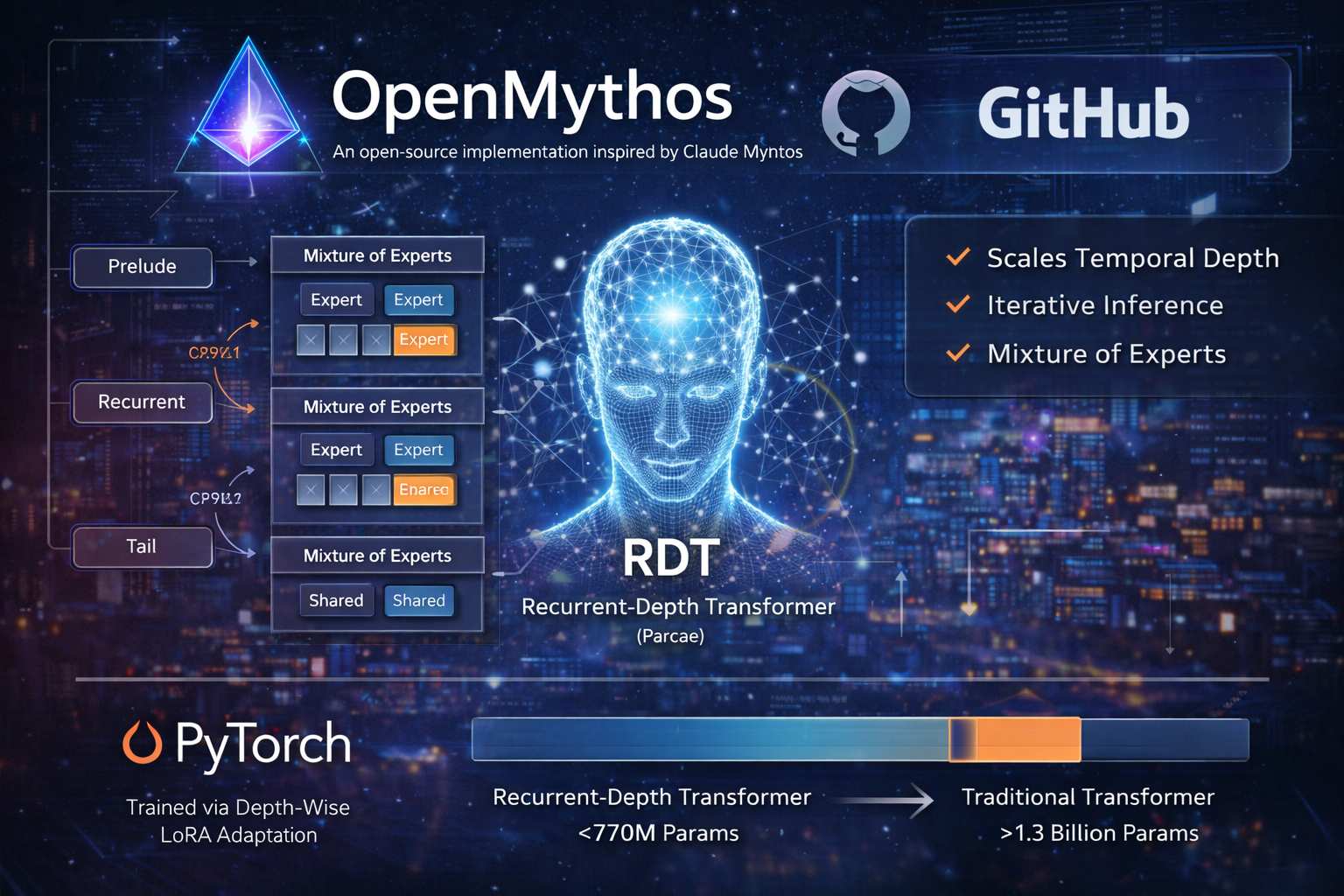

Il cuore del progetto OpenMythos risiede nell’adozione di un’architettura denominata Parcae, implementata in PyTorch, che introduce un paradigma differente rispetto ai Transformer tradizionali. Mentre modelli come GPT, LLaMA e Mistral costruiscono la propria capacità inferenziale attraverso una sequenza di strati con pesi distinti, la struttura proposta da OpenMythos si basa su un concetto di profondità ricorrente. Questo approccio, definito Recurrent-Depth Transformer (RDT), utilizza un singolo blocco parametrico che viene applicato iterativamente più volte durante la fase di inferenza.

La conseguenza tecnica di questa scelta è rilevante: la potenza computazionale del modello non è più determinata primariamente dalla quantità di parametri, ma dal numero di iterazioni effettuate durante il processo inferenziale. In altre parole, la profondità non è codificata staticamente nella rete, ma diventa una variabile dinamica che può essere modulata in funzione della complessità del problema affrontato. Questo introduce un concetto di “scalabilità temporale” dell’inferenza, in cui il tempo di calcolo sostituisce, almeno in parte, la dimensione del modello come fattore determinante delle prestazioni.

L’architettura Parcae si articola in tre fasi principali, denominate Preludio, Ricorrente e Coda. La fase Ricorrente costituisce il nucleo operativo e viene iterata fino a un massimo di sedici cicli. Durante ciascuna iterazione, lo stato nascosto del modello viene aggiornato combinando l’informazione derivante dallo stato precedente con una reiniezione del segnale di input originale. Questa scelta progettuale affronta uno dei problemi classici delle architetture iterative profonde, ovvero la degradazione dell’informazione nel corso delle iterazioni successive. Reintroducendo l’input a ogni passo, il modello mantiene un ancoraggio semantico stabile, evitando derive rappresentazionali.

Un ulteriore elemento distintivo è l’integrazione di un meccanismo di tipo Mixture of Experts, in cui il tradizionale strato feedforward viene sostituito da un insieme di reti specializzate attivate selettivamente. Questo approccio introduce una computazione sparsa, in cui solo una frazione degli esperti viene attivata per ciascun token, riducendo il costo computazionale complessivo pur mantenendo un’elevata capacità espressiva. La presenza di esperti condivisi garantisce una base comune di elaborazione, mentre la selezione dinamica degli altri esperti consente una diversificazione dei percorsi computazionali. Ogni iterazione, pur utilizzando gli stessi pesi globali, può quindi seguire una traiettoria diversa, generando una forma di esplorazione interna dello spazio delle soluzioni.

OpenMythos introduce un cambiamento concettuale rispetto a tecniche come la Chain of Thought. Invece di esplicitare i passaggi intermedi sotto forma di token testuali, il modello opera interamente in uno spazio latente continuo. Le iterazioni ricorrenti rappresentano fasi di ragionamento implicito, in cui le trasformazioni vettoriali interne svolgono un ruolo analogo ai passaggi logici esplicitati nei modelli tradizionali, ma senza generare output intermedi. Questo consente, almeno teoricamente, una maggiore efficienza e la possibilità di esplorare simultaneamente molteplici traiettorie inferenziali.

La capacità di adattare dinamicamente la profondità dell’inferenza rappresenta uno degli aspetti più innovativi della struttura RDT. Nei Transformer convenzionali, la profondità è fissata durante l’addestramento e difficilmente può essere estesa senza compromettere la stabilità del modello. Nel caso di OpenMythos, invece, il numero di iterazioni può essere aumentato durante l’inferenza per affrontare problemi più complessi, introducendo una forma di allocazione adattiva delle risorse computazionali. Problemi semplici richiedono poche iterazioni, mentre problemi complessi possono beneficiare di una maggiore profondità temporale.

Tuttavia, questa flessibilità introduce sfide significative in termini di stabilità dell’addestramento. Le architetture iterative sono soggette a fenomeni di instabilità dinamica, tra cui l’esplosione dello stato interno e la divergenza della funzione di perdita al crescere del numero di iterazioni. Per mitigare questi effetti, il progetto OpenMythos integra un sistema dinamico non lineare invariante nel tempo, concepito per stabilizzare l’evoluzione dello stato interno e prevenire oscillazioni incontrollate. Questo approccio richiama concetti provenienti dalla teoria dei sistemi dinamici, applicati al contesto del deep learning.

Un ulteriore problema affrontato è quello dell’overthinking computazionale, ovvero l’utilizzo eccessivo di risorse per token che non richiedono un’elaborazione complessa. Per risolvere questa inefficienza, il modello introduce meccanismi di arresto adattivo, che regolano automaticamente il numero di iterazioni necessarie in base alla difficoltà del compito. Questo consente di ottimizzare il bilanciamento tra prestazioni e costo computazionale, evitando sprechi di risorse.

La tecnica Depth-Wise LoRA rappresenta un ulteriore livello di raffinamento dell’architettura. Inserendo piccole matrici di adattamento in ciascuna iterazione, il modello introduce variazioni minime ma significative tra i diversi passaggi, pur mantenendo una struttura di pesi condivisa. Questo consente di aumentare la capacità espressiva senza incrementare in modo sostanziale il numero di parametri, preservando l’efficienza del sistema.

I risultati preliminari suggeriscono che questo approccio possa offrire vantaggi concreti in termini di efficienza parametrica. Studi citati nel contesto del progetto indicano che un modello RDT con circa 770 milioni di parametri può raggiungere prestazioni comparabili a un Transformer tradizionale con oltre 1,3 miliardi di parametri, a parità di dati di addestramento. Questo dato rafforza l’ipotesi che la profondità iterativa possa rappresentare un’alternativa valida all’espansione dimensionale dei modelli.