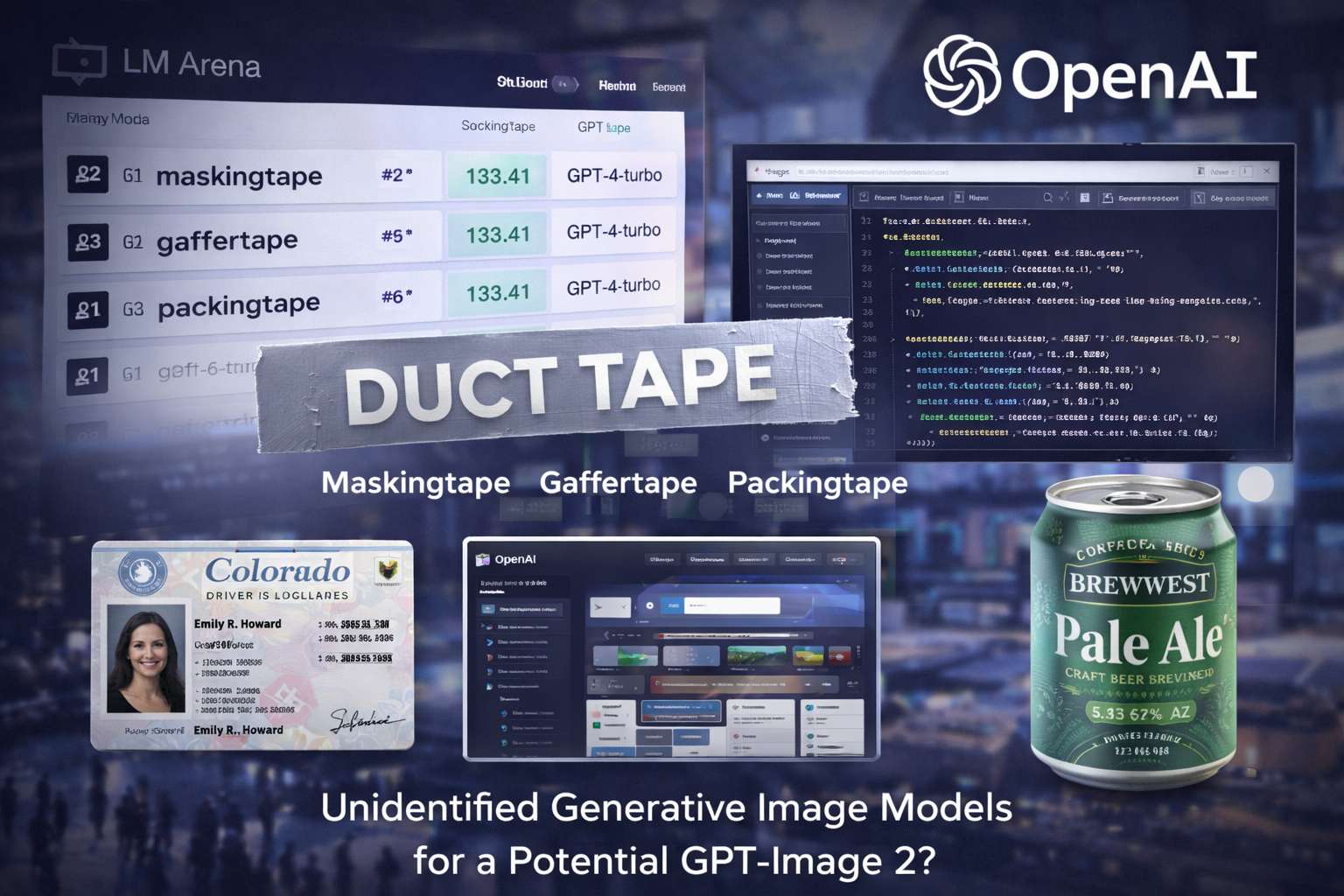

La recente e fugace comparsa sulla piattaforma di benchmarking LM Arena di una serie di modelli non identificati, denominati convenzionalmente con i suffissi “maskingtape”, “gaffertape” e “packingtape”, ha segnato un punto di discontinuità tecnologica nel settore della visione artificiale generativa. Questo ecosistema di modelli, ribattezzato dalla comunità tecnica come “Duct Tape” e associato allo sviluppo di GPT-Image-2 da parte di OpenAI, non rappresenta un semplice incremento incrementale delle capacità grafiche, ma una vera e propria ristrutturazione del modo in cui le reti neurali interpretano il rapporto tra semantica testuale e rappresentazione visiva. Il salto qualitativo osservato sposta il confine della generazione di immagini da una fase puramente estetica a una fase funzionale e strutturale, dove la precisione del dettaglio tecnico prevale sulla mera verosimiglianza artistica.

Il superamento dei limiti storici della tipografia all’interno dei modelli di diffusione costituisce l’innovazione più rilevante di questa nuova architettura. Mentre i sistemi precedenti, inclusi DALL-E 3 e le prime iterazioni di Nano Banana Pro, mostravano una cronica incapacità nel gestire la coerenza dei glifi, spesso distorcendo stringhe di testo semplici in artefatti privi di significato, GPT-Image-2 dimostra una padronanza assoluta della resa grafica del linguaggio. La capacità del modello di renderizzare correttamente non solo l’alfabeto latino, ma anche sistemi di scrittura complessi come il coreano, il cinese e il giapponese, suggerisce un’integrazione profonda tra i pesi linguistici del modello e il decoder d’immagine. Questa precisione trasforma l’IA in uno strumento in grado di generare autonomamente interfacce utente (UI), packaging di prodotti e documenti ufficiali con una leggibilità indistinguibile da un prodotto grafico professionale.

Un secondo pilastro tecnico di questo avanzamento risiede nella cosiddetta “comprensione del mondo” o coerenza contestuale. A differenza dei modelli tradizionali che operano attraverso una sintesi probabilistica di pixel basata su pattern estetici, GPT-Image-2 sembra operare su un modello mentale della realtà fisica e digitale. L’accuratezza nel riprodurre ambienti complessi, come lo schermo di una workstation di sviluppo completa di strutture di codice coerenti e schede browser logicamente correlate, indica che il processo di addestramento ha beneficiato di una vasta base di dati multimodale in cui la relazione logica tra gli oggetti è stata preservata. Questa capacità di modellazione del contesto permette di generare layout web e mockup di applicazioni che rispettano le gerarchie visive e funzionali del design reale, riducendo drasticamente il divario tra bozza generativa e prototipo finale.

Gli esperti ipotizzano che GPT-Image-2 non sia un’estensione dei flussi di lavoro esistenti, ma un sistema ibrido completamente riprogettato. L’ipotesi più accreditata riguarda la combinazione di metodi di generazione a passaggio singolo con approcci autoregressivi e di diffusione. Questa sinergia permetterebbe di mantenere un’elevata fedeltà ai prompt testuali, tipica dei modelli autoregressivi, garantendo al contempo la texture e il fotorealismo estremo dei modelli di diffusione. L’ottimizzazione di questa pipeline ha portato a una riduzione dei tempi di latenza, con velocità di generazione che scendono sotto la soglia dei tre secondi, un parametro critico per l’integrazione in flussi di lavoro in tempo reale e per il test A/B attualmente in corso su alcuni segmenti di utenza ChatGPT.

Infine, l’emergere di tali capacità solleva questioni di sicurezza di natura inedita. La perfezione nel rendering di documenti d’identità, screenshot di sistema e prove visive testuali mina il concetto stesso di affidabilità del contenuto digitale. È interessante notare come OpenAI sembri aver riallocato le ingenti risorse computazionali precedentemente destinate al progetto Sora verso questo nuovo standard di generazione statica. Questa scelta strategica suggerisce la volontà di consolidare un modello di generazione “general-purpose” estremamente potente e sicuro prima di passare alla distribuzione di massa di strumenti video, puntando sulla creazione di un’infrastruttura capace di supportare la creazione di contenuti complessi che vadano oltre l’intrattenimento, toccando settori quali il marketing, l’ingegneria del software e la produzione documentale.