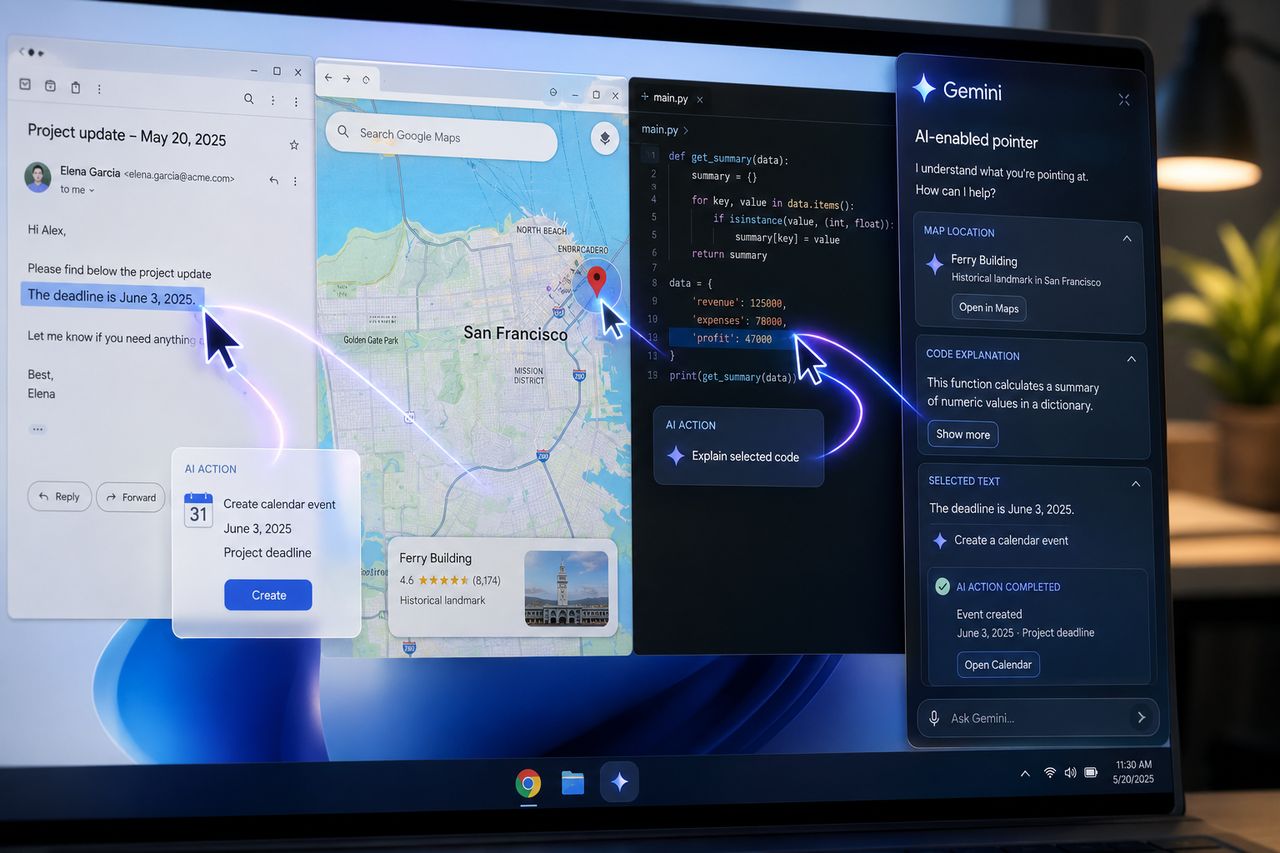

Google sta sperimentando una nuova interfaccia AI che potrebbe modificare profondamente il modo in cui gli utenti interagiscono con computer e applicazioni: un puntatore del mouse potenziato da Gemini capace di comprendere il contesto visivo e semantico di ciò che viene indicato sullo schermo. Il progetto, sviluppato da Google DeepMind, introduce il concetto di “AI-enabled pointer”, cioè un cursore intelligente che non si limita più a registrare posizione e click, ma interpreta attivamente gli elementi verso cui l’utente dirige l’attenzione.

L’idea tecnica alla base del sistema è piuttosto diversa dai tradizionali assistenti AI separati dall’interfaccia principale. Oggi la maggior parte dei chatbot richiede infatti all’utente di interrompere il proprio workflow, aprire una finestra dedicata e descrivere manualmente il contesto tramite prompt testuali. Google vuole invece eliminare questo passaggio trasformando direttamente il cursore in un canale di comunicazione contestuale tra utente e modello AI.

Secondo le informazioni disponibili, il sistema utilizza Gemini per acquisire in tempo reale il contesto visivo e semantico attorno alla posizione del mouse. In pratica, il modello non interpreta soltanto coordinate sullo schermo, ma comprende il significato degli elementi indicati: testo, immagini, mappe, codice, tabelle, date o componenti dell’interfaccia.

Questo approccio introduce un nuovo paradigma di interazione chiamato da Google “show and tell”. Invece di scrivere lunghi prompt per spiegare a un’AI cosa osservare, l’utente può semplicemente puntare un elemento e lasciare che il sistema comprenda automaticamente il contesto operativo. Nei prototipi mostrati da DeepMind, il cursore AI riesce ad esempio a riconoscere aree specifiche di immagini, paragrafi di testo o porzioni di codice sorgente e proporre immediatamente azioni contestuali.

Le demo iniziali includono strumenti di image editing e navigazione mappe controllabili combinando puntamento e voce. In altri esempi, il sistema è in grado di identificare automaticamente date presenti in email per creare eventi calendario, sintetizzare paragrafi selezionati, tradurre testo o manipolare contenuti visuali direttamente tramite il cursore.

Questa tecnologia rappresenta un’evoluzione diretta dei progetti agentici sviluppati da Google negli ultimi due anni, inclusi Project Mariner e le nuove integrazioni Gemini Intelligence annunciate per Android e Chrome. L’obiettivo comune è spostare Gemini da semplice chatbot conversazionale a sistema operativo contestuale capace di comprendere continuamente ciò che l’utente sta facendo.

Uno degli aspetti tecnicamente più importanti riguarda la trasformazione dei “pixel” in entità operative. Nei sistemi tradizionali, l’interfaccia grafica viene interpretata principalmente come immagine. Nel nuovo approccio di DeepMind, invece, il modello cerca di convertire gli elementi visuali in oggetti semanticamente comprensibili e direttamente utilizzabili dagli agenti AI. Questo permette al sistema di collegare il cursore non solo alla posizione visiva, ma anche alle intenzioni operative dell’utente.

Google sembra inoltre voler integrare profondamente questa tecnologia all’interno del proprio ecosistema hardware e software. Le prime implementazioni sperimentali sarebbero già in arrivo dentro Chrome tramite una funzione chiamata “Magic Pointer”, mentre una versione più estesa dovrebbe essere integrata nei nuovi laptop AI-centrici denominati Googlebook.

Il progetto si inserisce nella più ampia transizione verso interfacce agentiche persistenti. Negli ultimi mesi, infatti, l’industria AI sta progressivamente abbandonando il modello classico basato su chatbot isolati per sviluppare sistemi capaci di osservare continuamente il contesto operativo dell’utente, interagire con applicazioni e prendere iniziative autonome. Gemini Intelligence, Remy e i nuovi strumenti agentici di Google seguono tutti questa direzione.

Il puntatore AI tenta anche di risolvere uno dei principali problemi degli attuali workflow con modelli linguistici: la frammentazione dell’attenzione. Ogni volta che un utente deve interrompere il lavoro per spiegare manualmente a un chatbot cosa vede sullo schermo, si crea infatti un costo cognitivo significativo. Il cursore contestuale cerca di eliminare questa barriera rendendo l’interazione AI più implicita e continua.

Questa evoluzione apre però anche nuove questioni legate a privacy, sicurezza e controllo operativo. Un sistema AI che osserva continuamente il contesto dello schermo e interpreta ogni movimento del cursore necessita infatti di accesso molto esteso alle attività dell’utente. Inoltre, trasformare il puntatore in un agente operativo significa potenzialmente permettere all’AI di interagire direttamente con file, applicazioni e workflow sensibili.

Il progetto mostra comunque una direzione molto chiara dell’evoluzione delle interfacce uomo-macchina: l’AI non viene più trattata come uno strumento separato dall’interfaccia, ma come una componente contestuale integrata direttamente nei meccanismi fondamentali del sistema operativo e dell’interazione grafica.