Con il rilascio open source di Solar Open 100B, Upstage compie una mossa che va ben oltre il semplice annuncio tecnologico e assume un valore strategico per l’intero ecosistema dell’intelligenza artificiale coreana. Il modello, sviluppato interamente in casa e reso pubblico su Hugging Face insieme a un dettagliato rapporto tecnico, rappresenta il primo risultato concreto del progetto nazionale per la creazione di un modello di fondazione indipendente promosso dal Ministero della Scienza e delle ICT, di cui Upstage è capofila. È una dichiarazione d’intenti chiara: dimostrare che anche al di fuori dei grandi poli tecnologici statunitensi o cinesi è possibile costruire modelli di frontiera competitivi, efficienti e culturalmente radicati.

Solar Open nasce infatti da un approccio “from scratch”, che ha visto Upstage gestire in modo autonomo ogni fase del processo, dalla raccolta dei dati fino all’addestramento finale. In un settore in cui molti modelli vengono affinati partendo da basi preesistenti, questa scelta rafforza il valore del progetto, perché testimonia una capacità industriale e scientifica completa. Il risultato è un modello da 102 miliardi di parametri che, pur avendo dimensioni molto inferiori rispetto ad alcuni giganti recenti, riesce a competere – e in diversi casi a superare – modelli di riferimento globali.

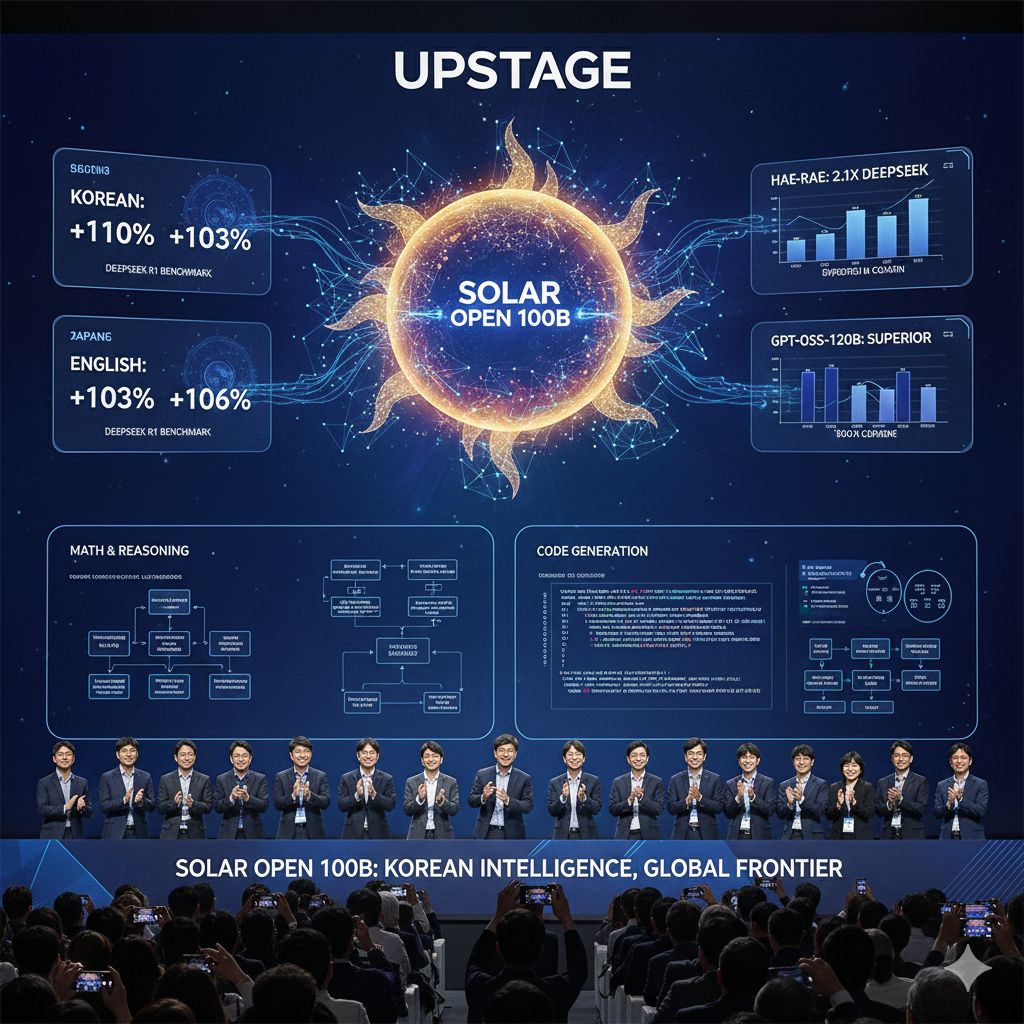

Uno degli aspetti più rilevanti riguarda le prestazioni comparative. Solar Open, pur avendo circa il 15% delle dimensioni di DeepSeek R1, lo supera nei benchmark principali in tre lingue chiave: coreano, inglese e giapponese. I risultati indicano un incremento rispettivamente del 110%, 103% e 106%, un dato che colpisce perché dimostra come l’efficienza architetturale e la qualità dell’addestramento possano compensare, e talvolta ribaltare, il semplice vantaggio dimensionale. Questo posizionamento multilingue rafforza l’idea di un modello pensato per essere “profondamente coreano” ma al tempo stesso competitivo su scala internazionale.

È però nella lingua coreana che Solar Open esprime il suo punto di forza più evidente. Nei benchmark dedicati alla comprensione culturale e alla conoscenza linguistica coreana, come Hae-Rae e CLicK, il modello ha ottenuto risultati più che doppi rispetto a DeepSeek-R1 e ha persino superato in modo netto il test gpt-oss-120B-medium di OpenAI. Questo dato non è solo tecnico, ma culturale e politico: dimostra che un modello addestrato con attenzione alle specificità linguistiche e contestuali può raggiungere livelli di comprensione che i modelli generalisti faticano a ottenere.

Al di fuori dell’ambito strettamente linguistico, Solar Open mostra prestazioni solide anche in domini complessi come matematica, esecuzione di istruzioni articolate e scenari agentici. In questi contesti, il modello si colloca su livelli paragonabili a DeepSeek-R1 e mantiene una competitività significativa rispetto a modelli proprietari di fascia alta come gpt-oss-120B-medium, anche per quanto riguarda la conoscenza avanzata e la scrittura di codice. Questo equilibrio tra specializzazione linguistica e robustezza generale è uno degli elementi che rendono Solar Open particolarmente interessante per applicazioni reali.

Alla base di questi risultati c’è un lavoro esteso sui dati. Upstage ha utilizzato un dataset di pre-addestramento di circa 20 trilioni di token, ponendo grande attenzione alla qualità più che alla sola quantità. Per superare la cronica scarsità di dati in coreano, spesso definita una lingua a basso contenuto di risorse nel contesto AI, l’azienda ha fatto ampio uso di dati sintetici e di contenuti specializzati provenienti da settori come finanza, diritto e medicina. Parallelamente, sono state migliorate le tecniche di filtraggio e le metodologie di apprendimento, riducendo il rumore e aumentando la densità informativa del corpus.

Un altro elemento chiave è l’architettura adottata. Solar Open utilizza un approccio Mixture of Experts, con 129 modelli esperti, ma ne attiva solo 12 miliardi per ciascun calcolo effettivo. Questo consente di massimizzare l’efficienza computazionale senza sacrificare la capacità espressiva del modello. L’ottimizzazione a livello GPU ha aumentato il throughput di token al secondo di circa l’80%, mentre lo sviluppo interno del framework di reinforcement learning SnapPO ha dimezzato i tempi di addestramento. Nel complesso, queste scelte hanno permesso a Upstage di risparmiare circa 12 miliardi di won in costi infrastrutturali, dimostrando che l’innovazione architetturale ha un impatto diretto anche sulla sostenibilità economica.

Il valore del progetto è stato riconosciuto anche a livello internazionale. Solar Open è stato inserito nella lista dei “modelli di intelligenza artificiale degni di nota” da Epoch AI, un segnale importante di credibilità scientifica e visibilità globale. Parallelamente, Upstage ha scelto una strada inusuale per il settore, annunciando l’intenzione di condividere parte del proprio dataset con l’AI Hub nazionale, contribuendo a rafforzare l’ecosistema pubblico della ricerca sull’intelligenza artificiale. La pubblicazione di dati grezzi, normalmente considerati un asset competitivo strategico, rappresenta una scelta controcorrente che punta a creare valore collettivo oltre il singolo prodotto.

Sul fronte delle collaborazioni, Upstage ha costruito un consorzio di alto profilo che include realtà industriali e accademiche come KAIST e Sogang University, insieme a partner tecnologici e di ricerca. L’obiettivo dichiarato è accelerare lo sviluppo di servizi verticali e trasformare Solar Open nello “standard di lavoro abilitato dall’intelligenza artificiale”, adattabile a contesti finanziari, legali, industriali, sanitari, pubblici ed educativi. In questa direzione si inseriscono anche le collaborazioni con aziende leader di settore e l’espansione internazionale tramite filiali e partner globali.

Solar Open non rimane però confinato alla ricerca. Upstage prevede di integrarlo in servizi già ampiamente utilizzati, come AskUp, che conta milioni di utenti, e nella piattaforma aziendale AI Workspace. Le API saranno distribuite attraverso Upstage Console, con l’intento di abbassare la barriera d’ingresso per sviluppatori e imprese e favorire una diffusione capillare del modello sia nel settore privato sia in quello pubblico.

Nelle parole del CEO Kim Seong-hun, Solar Open è “l’intelligenza artificiale più coreana ma allo stesso tempo globale”, capace di comprendere in profondità il contesto linguistico ed emotivo del coreano senza rinunciare a una competitività internazionale. Questa visione riassume il senso più profondo del progetto: non solo creare un grande modello linguistico, ma affermare un nuovo punto di equilibrio tra identità locale e ambizione globale. In questo senso, Solar Open 100B non è soltanto un traguardo tecnologico, ma un possibile punto di svolta per l’emergere di una vera intelligenza artificiale di frontiera coreana.