L’evoluzione dell’Intelligenza Artificiale segna un punto di svolta fondamentale, un passaggio epocale che sposta l’asse delle sue capacità: dall’essere un mero strumento di etichettatura e classificazione statica, l’AI si sta trasformando in un sofisticato “motore di ragionamento”. Questa è la direzione strategica delineata da OpenAI, un ripensamento profondo che promette di ridefinire il modo in cui i sistemi intelligenti interagiscono con la realtà e, in particolare, gestiscono una delle sfide più complesse del mondo digitale: la moderazione dei contenuti.

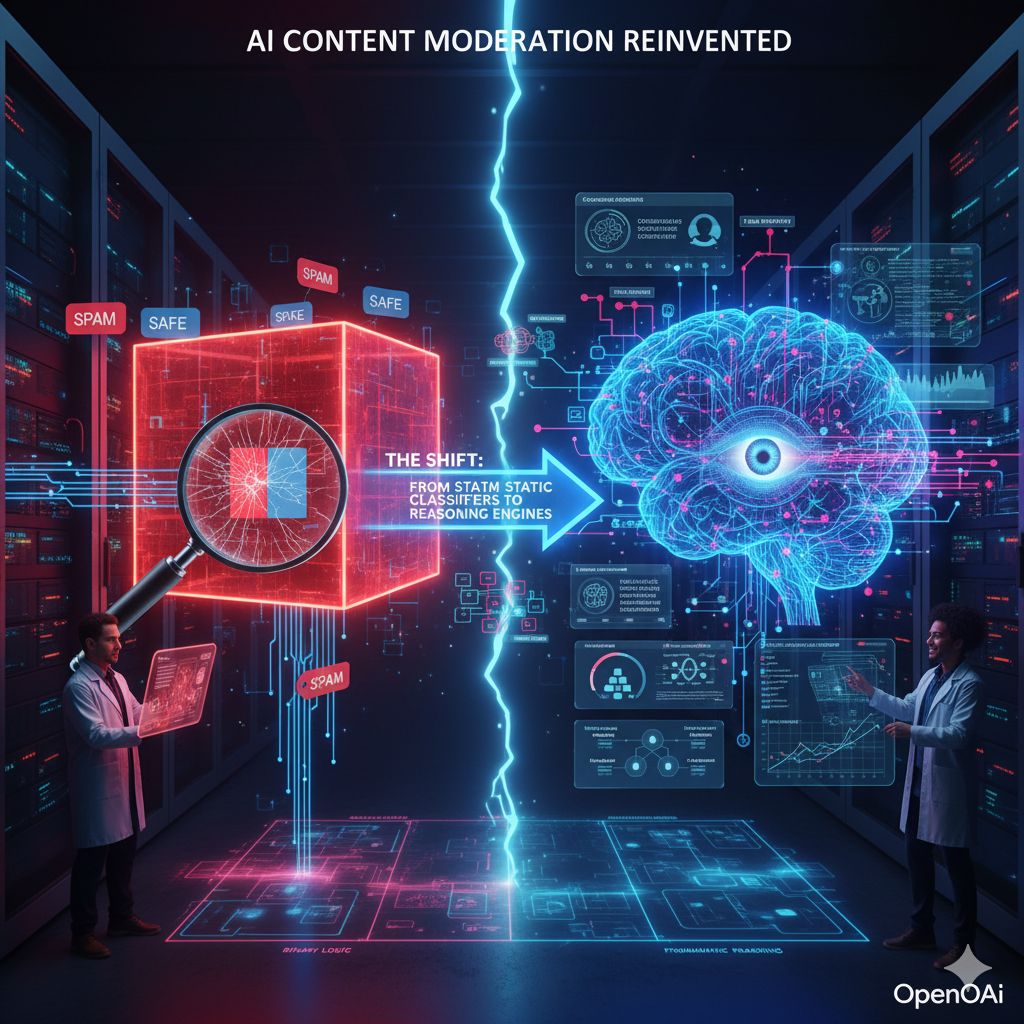

Per anni, l’approccio dominante nel campo della sicurezza e della conformità dei contenuti digitali si è basato sui cosiddetti “classificatori statici”. Questi modelli, addestrati su enormi set di dati etichettati, eccellono nell’applicare un’etichetta binaria a un input: “accettabile” o “non accettabile”, “spam” o “sicuro”, “discorso d’odio” o “neutro”. Il loro funzionamento è rapido ed efficiente su larga scala, ma la loro natura è intrinsecamente limitata. Essi operano come sofisticati sistemi di corrispondenza di pattern, incapaci di cogliere le sfumature, l’ironia, il contesto culturale o la sequenza di eventi che portano a una violazione. Se un contenuto presenta una variazione linguistica o un riferimento indiretto che non era presente nei dati di addestramento, il classificatore statico fallisce, generando falsi positivi (contenuti innocui bloccati) o, peggio, falsi negativi (contenuti dannosi lasciati in circolo). Sono sistemi che rispondo a un “cosa è questo?”, ma sono muti di fronte a un “perché è così?”.

La nuova frontiera spinta da OpenAI mira a superare questa limitazione monolitica, introducendo modelli che non si limitano a etichettare, ma che possono effettivamente ragionare. Un motore di ragionamento rappresenta una vera e propria rivoluzione concettuale. Questi modelli sono concepiti non solo per comprendere il contenuto testuale o visivo, ma per eseguire una catena di inferenze logiche. Possono analizzare il contesto più ampio in cui un’affermazione è stata fatta, valutare l’intento dell’utente e persino anticipare le potenziali conseguenze di un contenuto specifico.

Nel contesto della moderazione, ciò significa trasformare l’AI da un mero vigilante a un analista forense. Anziché limitarsi a segnalare la presenza di determinate parole chiave, il motore di ragionamento è in grado di ricostruire la dinamica di un’interazione. Ad esempio, può determinare se un contenuto, preso isolatamente, è innocuo, ma diventa parte di un comportamento vessatorio più ampio e coordinato. Questa capacità di giudizio stratificato e non lineare è ciò che distingue il ragionamento dalla semplice classificazione.

Le implicazioni di questa svolta sono immense. La moderazione dei contenuti può diventare notevolmente più accurata, riducendo l’onere decisionale sugli operatori umani, che in precedenza erano costretti a intervenire per risolvere le ambiguità lasciate dai classificatori rigidi. Un motore di ragionamento può fornire una spiegazione, quasi una “sentenza motivata”, del perché un contenuto sia stato rimosso o mantenuto. Questa trasparenza algoritmica non solo rafforza la fiducia nel sistema di moderazione, ma offre anche la possibilità di feedback più precisi per l’addestramento futuro del modello.

L’ambizione di OpenAI non è semplicemente quella di creare modelli più grandi o più veloci, ma di renderli fondamentalmente più intelligenti e affidabili, dotandoli di una capacità di giudizio che un tempo era ritenuta esclusiva del discernimento umano. Il passaggio dai classificatori statici ai motori di ragionamento segna, in definitiva, il tentativo di infondere nei sistemi di Intelligenza Artificiale la logica, il contesto e la capacità di pianificazione che sono il cuore del pensiero critico, aprendo la strada a un futuro digitale gestito con maggiore accuratezza e responsabilità.