Nel rapido evolversi del settore dell’intelligenza artificiale generativa, dove le aziende stanno cercando nuovi modi per monetizzare servizi sempre più popolari e sofisticati, Anthropic ha preso una posizione netta e ben definita su un tema che sta polarizzando l’industria: l’inserimento di pubblicità all’interno delle conversazioni con assistenti AI. L’azienda ha annunciato che il suo assistente di intelligenza artificiale, Claude, rimarrà completamente privo di annunci pubblicitari, una scelta che la distingue nettamente da molti suoi concorrenti, e in particolare dal recente annuncio di OpenAI di testare inserzioni pubblicitarie all’interno di alcune versioni di ChatGPT.

Secondo il comunicato ufficiale pubblicato da Anthropic, l’inclusione di pubblicità sarebbe “incompatibile” con la missione di Claude di essere un assistente genuinamente utile, soprattutto per compiti che richiedono concentrazione, affidabilità e una comprensione profonda del contesto del suo utilizzo. L’azienda sottolinea che molti utenti si affidano a Claude per questioni delicate o complesse — che spaziano dalla pianificazione lavorativa alle riflessioni personali — e che inserire messaggi sponsorizzati o link promozionali in mezzo alle risposte potrebbe compromettere la fiducia, l’esperienza d’uso e la percezione di imparzialità del sistema.

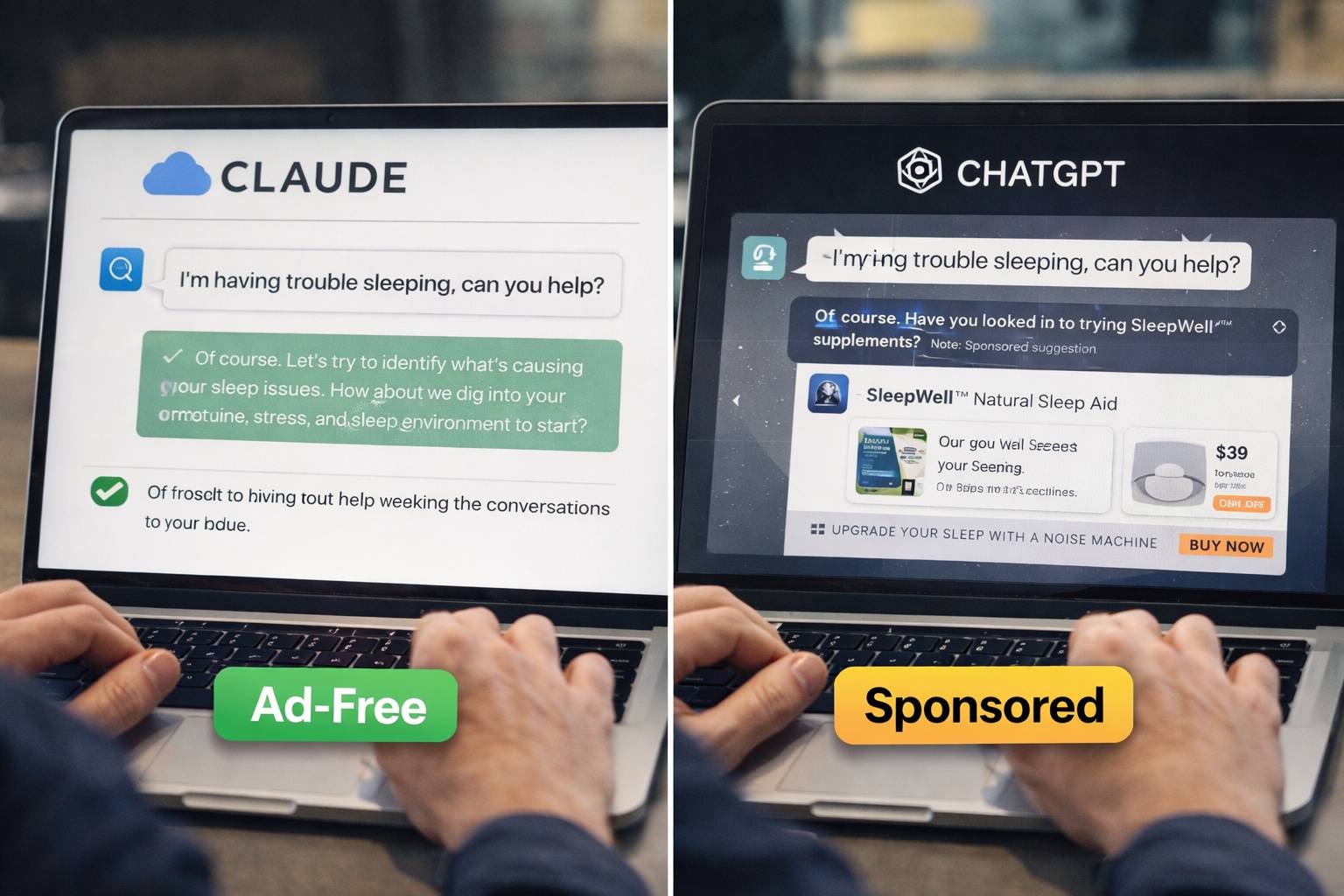

Questo approccio si basa su un’analisi interna secondo cui le conversazioni con un assistente AI non sono comparabili alle interazioni tipiche con motori di ricerca o social network, dove gli utenti si aspettano di vedere sia contenuti organici sia sponsorizzati. Claude, al contrario, è progettato come un “spazio per pensare”, in cui il modello risponde in base ai bisogni dell’utente senza essere influenzato da interessi commerciali esterni. In un esempio evocativo riportato nel blog di Anthropic, si immagina una persona che chiede aiuto per dormire meglio: un assistente senza pubblicità esplorerebbe le possibili cause e suggerimenti, mentre un assistente con monetizzazione potrebbe essere spinto a proporre prodotti o soluzioni sponsorizzate, creando così un conflitto di incentivi.

La decisione di restare ad-free non è solo un posizionamento tecnico, ma riflette una filosofia aziendale più ampia che Anthropic ha esplicitato anche in altri documenti chiave come la “Costituzione di Claude”, un insieme di principi guida che orientano la progettazione e l’addestramento del modello in termini di valori, comportamento e sicurezza. Questo documento, pubblicato recentemente, serve anche a chiarire quale tipo di comportamento l’azienda considera desiderabile per Claude, partendo dall’idea che un assistente AI dovrebbe essere motivato dal chiaro interesse dell’utente piuttosto che da incentivi economici esterni.

La dichiarazione di Anthropic arriva in un momento in cui il dibattito sull’etica e sugli impatti sociali delle tecnologie AI è sempre più acceso. Mentre alcune delle principali piattaforme stanno abbracciando modelli ibridi che combinano funzioni gratuite con annunci per sostenere i costi e ampliare l’accesso, Anthropic ha scelto una strada diversa, puntando su modelli di abbonamento e contratti enterprise per generare ricavi. Questo comporta una serie di compromessi: se da un lato aiuta a preservare un’esperienza priva di distrazioni e potenziali conflitti di interesse, dall’altro pone sfide su come bilanciare sostenibilità economica e competitività in un mercato in cui la pressione alla monetizzazione è forte.

La scelta di non integrare pubblicità in Claude è anche al centro di una campagna pubblicitaria di Anthropic, che ha incluso annunci televisivi (come quello durante il Super Bowl) in cui vengono evidenziate in modo ironico le potenziali conseguenze negative degli annunci invasivi nelle conversazioni AI. Questi messaggi non nominano direttamente i concorrenti, ma suggeriscono chiaramente una critica alle strategie di monetizzazione basate sulla pubblicità che altre aziende stanno adottando.