Le recenti rivelazioni riportate dal Wall Street Journal e da Axios hanno sollevato interrogativi rilevanti sul ruolo dei modelli di intelligenza artificiale nelle operazioni militari statunitensi, in particolare in relazione all’utilizzo di Claude, il modello sviluppato da Anthropic, nell’ambito di pianificazioni e simulazioni collegate a un’operazione congiunta tra Stati Uniti e Israele contro l’Iran. Secondo le fonti citate, la tecnologia basata su Claude sarebbe stata impiegata non solo per attività di raccolta e analisi informativa, ma anche per la selezione di obiettivi e per la simulazione di scenari operativi sul campo di battaglia.

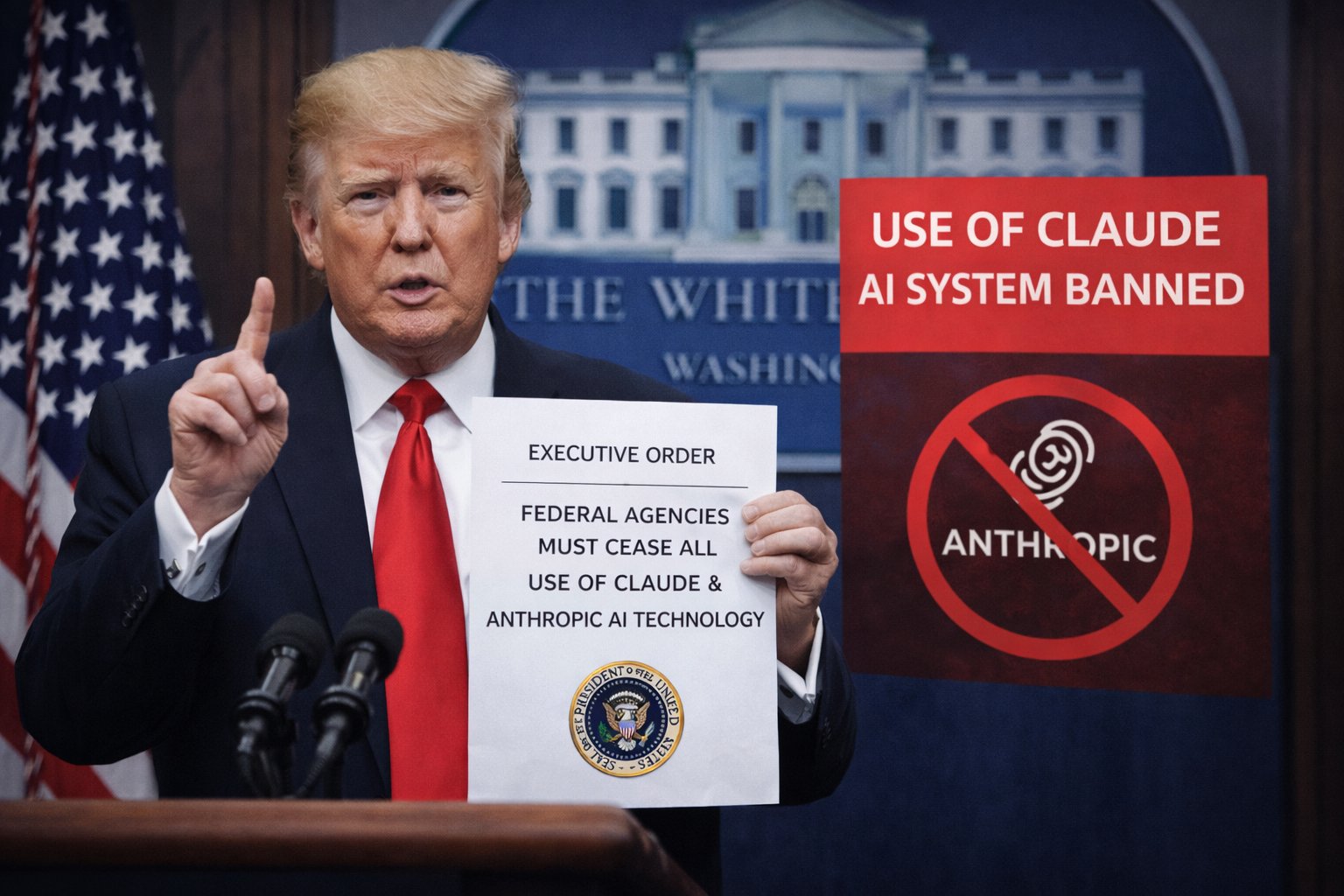

Queste informazioni emergono in un contesto politico e istituzionale particolarmente complesso. Poche ore prima dell’avvio dell’operazione, il presidente Donald Trump avrebbe ordinato alle agenzie federali di interrompere immediatamente l’uso del cloud associato ad Anthropic. Successivamente, sarebbe stato firmato un contratto per consentire l’utilizzo di modelli di OpenAI su una rete classificata del Dipartimento della Difesa. Tale sequenza di decisioni evidenzia la tensione tra esigenze operative immediate e scelte politiche relative alla catena di fornitura tecnologica in ambito militare.

Dal punto di vista tecnico, l’eventuale impiego di un modello come Claude in contesti militari non implica necessariamente un controllo diretto dell’IA su sistemi d’arma autonomi, ma può riguardare funzioni di supporto decisionale avanzato. I modelli linguistici di grandi dimensioni possono essere utilizzati per analizzare grandi volumi di dati non strutturati, sintetizzare rapporti di intelligence, generare ipotesi operative, simulare scenari strategici e supportare la pianificazione logistica. In particolare, l’integrazione con sistemi di droni e piattaforme di simulazione può consentire la generazione e valutazione di molteplici scenari tattici in tempi estremamente ridotti rispetto ai metodi tradizionali.

Nel caso specifico riportato dalle fonti giornalistiche, Claude sarebbe stato utilizzato anche per la selezione degli obiettivi e per simulazioni di campi di battaglia. Ciò suggerisce un’integrazione con sistemi di modellazione e simulazione, dove l’IA contribuisce alla valutazione di variabili come distribuzione delle forze, condizioni ambientali, traiettorie di volo e potenziali effetti collaterali. In tali architetture, il modello linguistico non agisce in isolamento, ma come componente di un ecosistema più ampio che include sensori, sistemi di raccolta dati, modelli fisici e piattaforme di comando e controllo.

La controversia istituzionale è esplosa quando il Segretario alla Difesa Pete Hegseth ha dichiarato pubblicamente che nessun appaltatore o partner sotto contratto con l’esercito statunitense avrebbe potuto intrattenere rapporti commerciali con Anthropic. Tuttavia, la società ha risposto tramite il proprio blog ufficiale, contestando la legittimità di tale affermazione e sostenendo che una designazione di rischio per la catena di approvvigionamento rappresenterebbe una misura senza precedenti nei confronti di un’azienda americana. Dal punto di vista giuridico, Anthropic ha sottolineato che eventuali restrizioni potrebbero applicarsi esclusivamente all’uso dei propri servizi nell’ambito specifico dei contratti del Dipartimento della Difesa, senza estendersi automaticamente a rapporti commerciali con altri clienti.

Il Segretario Hegseth ha successivamente riconosciuto la difficoltà pratica di separare rapidamente strumenti di intelligenza artificiale già profondamente integrati nei sistemi militari. L’adozione di modelli AI nei processi di pianificazione e analisi non avviene in modo superficiale o temporaneo, ma attraverso integrazioni tecniche che coinvolgono pipeline di dati, interfacce API, sistemi di autenticazione, infrastrutture di rete classificate e protocolli di sicurezza. Una volta che tali componenti sono state incorporate nei flussi operativi, la loro sostituzione richiede test di compatibilità, validazione della sicurezza, certificazioni e riaddestramento del personale. Per questo motivo, è stato indicato un periodo di transizione fino a sei mesi per garantire una migrazione graduale verso soluzioni alternative.

L’episodio evidenzia una questione strutturale più ampia: la crescente dipendenza delle istituzioni militari da tecnologie di intelligenza artificiale sviluppate da aziende private. L’integrazione di modelli generativi e sistemi di apprendimento automatico nelle operazioni di difesa solleva interrogativi su governance, controllo, responsabilità e resilienza della catena di fornitura. Se da un lato l’AI consente di accelerare l’analisi e migliorare la qualità delle decisioni in ambienti ad alta complessità, dall’altro crea un’interdipendenza tra settore pubblico e privato che rende complesso un disimpegno rapido in caso di controversie politiche o strategiche.

L’amministratore delegato di Anthropic, Dario Amodei, ha difeso pubblicamente la posizione dell’azienda, richiamando il diritto costituzionale di esprimere dissenso nei confronti del governo. Questa dimensione aggiunge un ulteriore livello di complessità, in quanto la questione non riguarda solo aspetti tecnici o contrattuali, ma anche principi costituzionali e libertà di espressione. In prospettiva, è plausibile che la disputa evolva in un contenzioso legale volto a chiarire i limiti dell’autorità del Dipartimento della Difesa in materia di designazioni di rischio e restrizioni commerciali.

Dal punto di vista tecnologico, il caso dimostra quanto sia difficile “ritirare” strumenti di intelligenza artificiale una volta che essi sono stati incorporati in sistemi operativi critici. L’AI non è più un componente periferico, ma un elemento integrato nei processi decisionali, nei sistemi di simulazione e nelle piattaforme di analisi strategica. La sostituzione di un modello con un altro non è un semplice cambio di fornitore, ma un’operazione che richiede revisione delle interfacce, validazione delle prestazioni, test di sicurezza e ricalibrazione dei workflow.