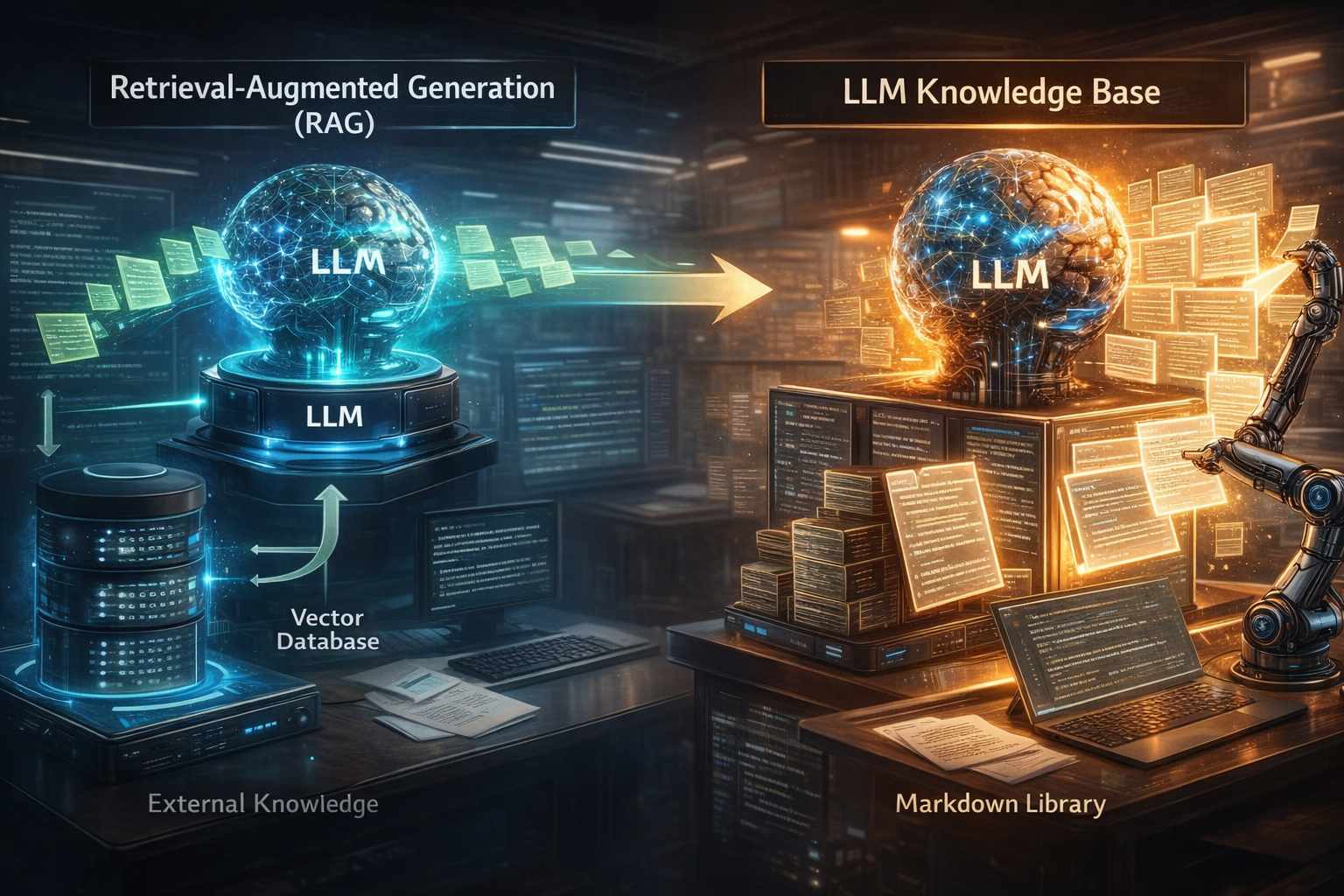

L’architettura Retrieval-Augmented Generation (RAG) è oggi una delle soluzioni più diffuse per collegare modelli linguistici a basi di conoscenza esterne, ma una nuova proposta attribuita ad Andrej Karpathy suggerisce un approccio differente, basato su una knowledge base persistente costruita e mantenuta direttamente dall’intelligenza artificiale. Questo paradigma si descrive come una “LLM Knowledge Base” capace di bypassare il RAG tradizionale attraverso una libreria markdown in continua evoluzione, gestita e aggiornata autonomamente dal modello.

Il punto di partenza della proposta è una critica implicita all’architettura RAG. Nei sistemi tradizionali, ogni interrogazione avvia un ciclo di retrieval in cui il modello ricerca documenti rilevanti, li inserisce nel contesto e genera la risposta. Questo processo è intrinsecamente stateless, ovvero non accumula conoscenza strutturata nel tempo, ma ripete la ricerca ad ogni richiesta. Secondo la visione descritta, questo comportamento comporta ridondanza computazionale e una perdita di continuità semantica tra le interazioni.

L’alternativa proposta si basa su una memoria persistente costruita come una wiki o libreria di documenti markdown che il modello aggiorna progressivamente. Invece di interrogare continuamente fonti esterne, il sistema compila i contenuti in una base strutturata che cresce nel tempo e viene raffinata attraverso nuove informazioni. Questo approccio introduce una dimensione cumulativa della conoscenza, trasformando l’LLM da semplice generatore stateless a sistema con memoria evolutiva.

Il funzionamento dell’architettura è descritto come un flusso in più fasi, basato esclusivamente su file. Inizialmente i contenuti grezzi vengono raccolti in un archivio uniforme, ad esempio documenti, articoli o dataset convertiti in formato markdown. Successivamente il modello analizza questo materiale e lo sintetizza in documenti strutturati, collegati tra loro con riferimenti e riepiloghi. Infine, l’AI esegue cicli periodici di revisione, identificando lacune, aggiornando contenuti e migliorando la coerenza complessiva della base di conoscenza.

Uno degli aspetti distintivi rispetto al RAG è l’assenza di embedding e database vettoriali. Nel paradigma tradizionale, il retrieval si basa su chunking dei documenti e ricerca semantica per similarità. Nel modello proposto, invece, il contenuto viene “compilato” in forma leggibile e interconnessa, eliminando la necessità di indicizzazione vettoriale. Questo riduce la complessità infrastrutturale e rende la base di conoscenza direttamente consultabile anche da utenti umani.

Il vantaggio principale di questo approccio è la persistenza della conoscenza. Nei sistemi RAG, ogni risposta è il risultato di un retrieval temporaneo; nella knowledge base evolutiva, invece, il sistema mantiene un corpus consolidato che si arricchisce nel tempo. Questa caratteristica consente di ridurre la latenza, migliorare la coerenza tra risposte successive e creare un contesto sempre più raffinato.

Un ulteriore elemento evidenziato riguarda la possibilità di integrare strumenti di versionamento e collaborazione. Alcune implementazioni utilizzano repository Git e strumenti come Obsidian per gestire la base markdown, consentendo di tracciare le modifiche e intervenire manualmente quando necessario. Questo avvicina l’architettura a un sistema di documentazione tecnica dinamica, piuttosto che a un semplice database semantico.

La “LLM Knowledge Base” modifica il ruolo del modello linguistico. L’LLM non si limita più a generare risposte, ma agisce come curatore della conoscenza, sintetizzando fonti, creando collegamenti e mantenendo la struttura informativa. Questo comportamento introduce una componente agentica, in cui il modello gestisce attivamente il proprio contesto informativo.

L’approccio risulta particolarmente interessante nei contesti in cui la base di conoscenza è relativamente stabile e deve essere aggiornata progressivamente. In questi scenari, la compilazione preventiva delle informazioni riduce il numero di operazioni di retrieval e migliora la qualità del ragionamento, perché il modello lavora su contenuti già organizzati.

La proposta si inserisce in un trend più ampio che mette in discussione la centralità del RAG. Alcuni studi suggeriscono che il retrieval continuo introduce latenza e possibili errori di selezione dei documenti, mentre soluzioni basate su memoria persistente o contesto esteso possono ridurre la complessità e migliorare l’affidabilità in determinati scenari applicativi.

Il passaggio da RAG a knowledge base persistente implica anche un cambiamento nel ciclo di aggiornamento. Invece di aggiornare gli embedding e reindicizzare i dati, il sistema aggiorna direttamente i documenti compilati. Questo consente un controllo più esplicito della qualità informativa e una maggiore trasparenza, poiché la base di conoscenza è leggibile e verificabile.