Google ha presentato PaperOrchestra, un framework multi-agente progettato per automatizzare l’intero processo di redazione di articoli scientifici partendo da dati sperimentali e idee preliminari. Il sistema introduce un’architettura composta da agenti specializzati che collaborano per analizzare input non strutturati, costruire la struttura del documento, generare grafici e redigere un manoscritto completo pronto per la sottomissione accademica. L’obiettivo è trasformare la scrittura scientifica in un workflow automatizzato mantenendo un elevato livello di qualità e coerenza metodologica.

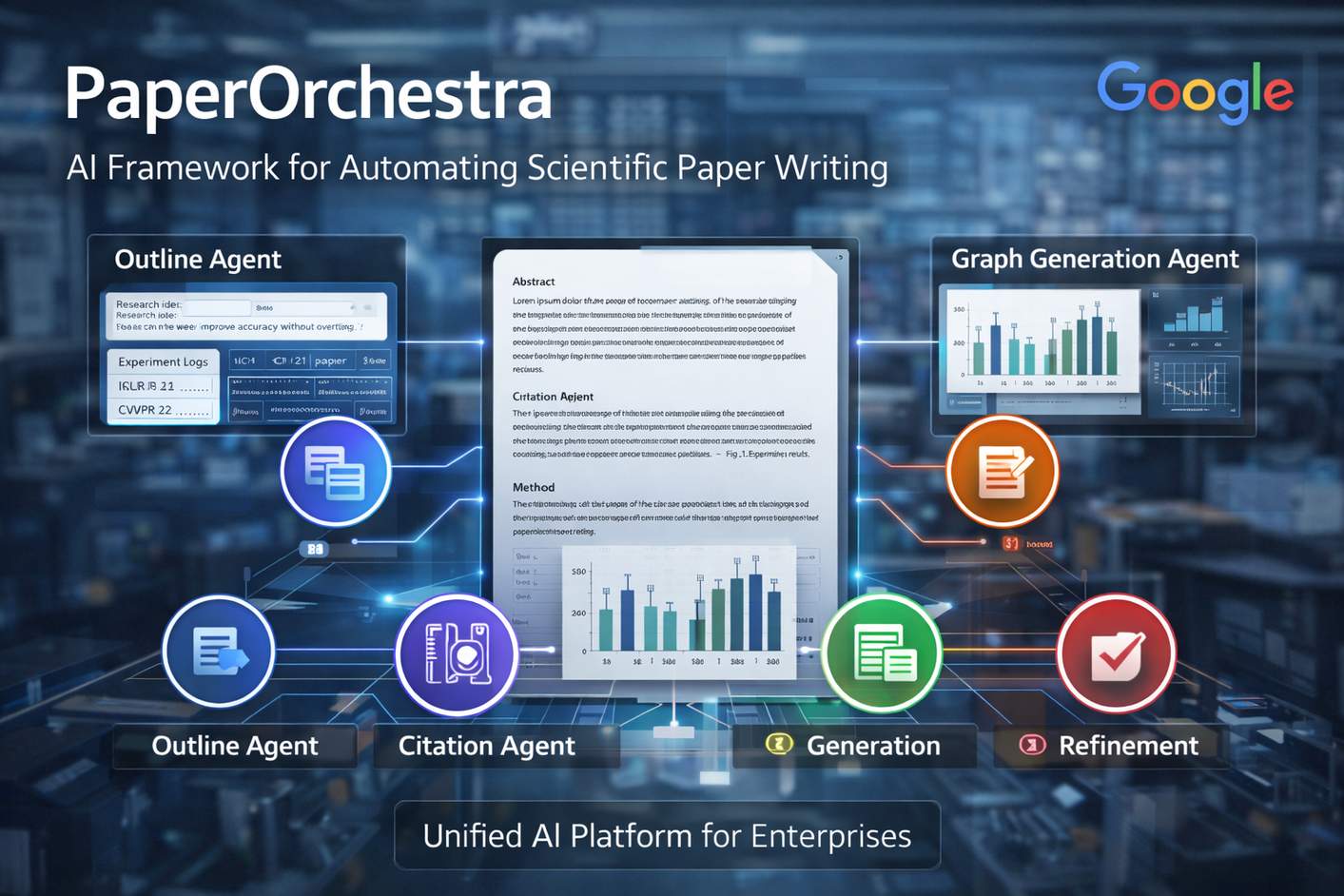

L’architettura del framework si basa sulla suddivisione del processo in agenti con ruoli distinti. Un agente di outline analizza l’idea di ricerca e i dati sperimentali per definire la struttura dell’articolo e il piano di visualizzazione, mentre altri agenti operano in parallelo per generare grafici e raccogliere la letteratura scientifica pertinente. Il sistema include un agente dedicato alla revisione bibliografica che utilizza database accademici per recuperare solo riferimenti verificati, riducendo il rischio di citazioni inesistenti, una criticità comune nei sistemi generativi tradizionali.

Il framework integra anche un agente di generazione del contenuto, incaricato di scrivere le diverse sezioni dell’articolo in formato LaTeX, inclusi abstract, metodologia, risultati e conclusioni. Successivamente interviene un agente di refinement che simula un processo di peer review, migliorando iterativamente il documento. Il sistema può tornare alle fasi precedenti se la qualità non raggiunge determinati criteri, introducendo un ciclo di ottimizzazione che mira a garantire coerenza e completezza del testo finale.

L’intero pipeline può essere completato in circa quaranta minuti e richiede decine di chiamate a modelli linguistici durante l’elaborazione. Questo flusso automatizzato consente di passare da dati sperimentali grezzi a un documento strutturato pronto per la pubblicazione, riducendo significativamente il tempo necessario per la redazione manuale.

Per valutare le prestazioni del sistema, i ricercatori hanno introdotto un benchmark dedicato, PaperWritingBench, costruito a partire da articoli scientifici accettati in conferenze come CVPR e ICLR. Il dataset è stato progettato per simulare la fase di scrittura iniziale, fornendo al sistema solo riassunti delle idee e log sperimentali. Questo approccio ha permesso di testare la capacità del framework di ricostruire articoli completi in condizioni realistiche.

I risultati sperimentali indicano miglioramenti significativi rispetto ai sistemi a singolo agente. Le valutazioni condotte da ricercatori umani hanno evidenziato un aumento della qualità della revisione bibliografica e un miglioramento complessivo della struttura del documento. Anche i test automatici hanno mostrato un vantaggio consistente nella qualità delle citazioni e nella completezza dell’articolo. Il sistema è stato inoltre in grado di generare un numero elevato di riferimenti bibliografici, avvicinandosi ai livelli tipici degli articoli redatti manualmente.

Un ulteriore aspetto rilevante riguarda la simulazione del processo di revisione accademica. In test basati su criteri simili a quelli utilizzati in conferenze scientifiche, gli articoli generati dal sistema hanno raggiunto tassi di accettazione simulati vicini a quelli degli articoli umani, indicando un livello di maturità crescente dei sistemi multi-agente nella produzione scientifica automatizzata. Tuttavia, è stato evidenziato che permane una differenza qualitativa rispetto agli articoli scritti interamente da ricercatori.

PaperOrchestra rappresenta un’evoluzione dei sistemi generativi verso architetture agentiche collaborative. Invece di affidare la generazione a un unico modello, il framework suddivide il lavoro tra agenti specializzati, migliorando l’affidabilità e la coerenza del risultato. Questo approccio riflette una tendenza più ampia nello sviluppo dell’intelligenza artificiale, in cui workflow complessi vengono orchestrati attraverso sistemi multi-agente.

Gli sviluppatori sottolineano che il sistema non è destinato a sostituire completamente i ricercatori, ma a migliorare la produttività scientifica. La responsabilità sulla correttezza e sull’originalità dei contenuti rimane umana, mentre l’AI viene utilizzata come supporto per accelerare le fasi di scrittura, organizzazione e revisione. Questo posizionamento indica una visione in cui l’automazione contribuisce al processo di ricerca senza eliminarne il controllo umano.