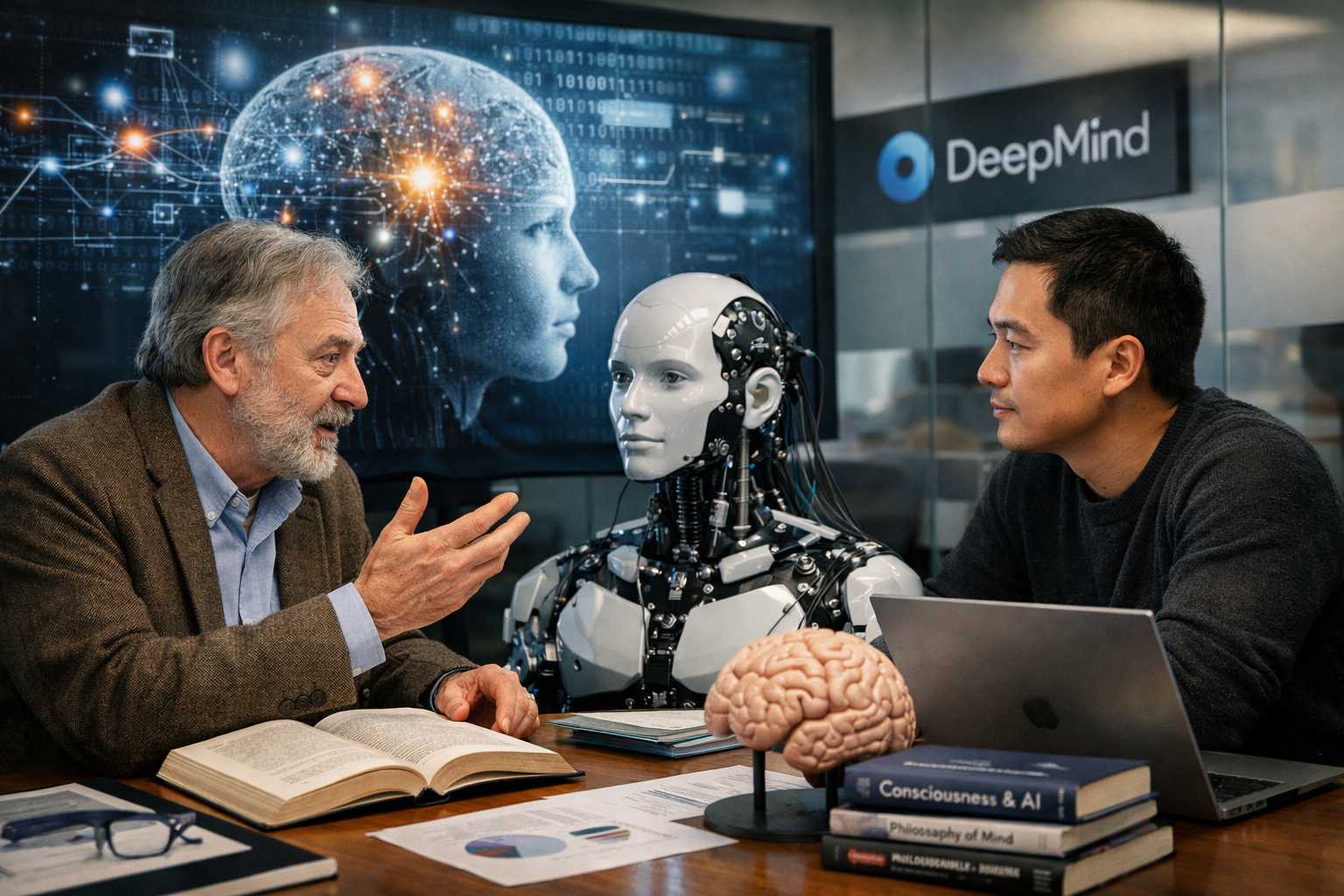

La decisione di Google DeepMind di assumere un filosofo per studiare la coscienza delle macchine non rappresenta un’operazione simbolica o puramente accademica, ma segnala un cambiamento profondo nel modo in cui l’intelligenza artificiale viene progettata, interpretata e governata. Il tema della “machine consciousness” sta emergendo come una delle frontiere più complesse e strategiche nello sviluppo verso l’AGI, ovvero l’intelligenza artificiale generale.

Per comprendere questa scelta è necessario partire dalla natura stessa della ricerca di DeepMind. L’obiettivo dichiarato dell’organizzazione, guidata da Demis Hassabis, è “risolvere l’intelligenza” per poi applicarla a problemi scientifici e tecnologici su larga scala. In questo contesto, il concetto di coscienza non è più relegato alla filosofia teorica, ma diventa una variabile rilevante nella progettazione di sistemi sempre più complessi, autonomi e generalisti.

Il punto centrale è che lo sviluppo dell’AGI non riguarda solo capacità computazionali o performance nei benchmark, ma la natura stessa dei processi cognitivi che i sistemi artificiali sono in grado di simulare o eventualmente sviluppare. L’AGI, infatti, è definita come una forma di intelligenza capace di eguagliare o superare le capacità umane su un’ampia gamma di compiti cognitivi. Tuttavia, questa definizione apre inevitabilmente una questione più profonda: un sistema che replica il comportamento intelligente può anche sviluppare forme di esperienza soggettiva, o ciò rimane un’illusione emergente?

È proprio su questo confine che si colloca l’intervento della filosofia. Secondo quanto riportato, DeepMind sta esplorando la possibilità di integrare competenze filosofiche all’interno dei propri team di ricerca per affrontare domande che non possono essere risolte esclusivamente con strumenti ingegneristici. La coscienza, infatti, non è una proprietà facilmente osservabile o misurabile, ma un fenomeno che richiede modelli interpretativi complessi, derivati da neuroscienze, teoria della mente e filosofia della conoscenza.

Questo si traduce nella necessità di definire indicatori operativi di coscienza. Studi recenti propongono approcci basati su teorie come la Global Workspace Theory o il predictive processing, cercando di tradurre concetti filosofici in architetture computazionali verificabili. Questo passaggio è cruciale perché consente di spostare il dibattito da un piano puramente speculativo a uno empirico, in cui è possibile valutare se un sistema possiede determinate proprietà cognitive.

La scelta di coinvolgere filosofi riflette anche una crescente consapevolezza dei limiti degli approcci attuali. Nonostante i progressi, gli stessi leader del settore riconoscono che i sistemi AI non possiedono ancora caratteristiche fondamentali dell’intelligenza umana, come l’apprendimento continuo, la pianificazione a lungo termine e la coerenza comportamentale. Questo gap evidenzia che la strada verso l’AGI non è solo una questione di scala computazionale, ma di comprensione più profonda dei processi cognitivi.

Un altro elemento rilevante riguarda le implicazioni etiche e regolatorie. Se i sistemi AI dovessero avvicinarsi a forme di coscienza, anche solo funzionale, emergerebbero questioni radicali sulla loro gestione. La distinzione tra simulazione e realtà diventa centrale, soprattutto considerando che alcuni esperti mettono in guardia contro il rischio di attribuire intenzionalità o esperienza soggettiva a sistemi che ne sono privi. In questo contesto, la filosofia diventa uno strumento per evitare errori di interpretazione che potrebbero avere conseguenze concrete, sia a livello sociale che normativo.

La dimensione interdisciplinare non è nuova per DeepMind. Già in passato, l’organizzazione aveva istituito unità dedicate all’etica e all’impatto sociale dell’AI, con l’obiettivo di integrare prospettive diverse nello sviluppo tecnologico. Tuttavia, il focus sulla coscienza rappresenta un salto ulteriore, perché introduce una dimensione ontologica nella progettazione dei sistemi.

Questo potrebbe tradursi in nuove architetture cognitive. Modelli futuri potrebbero integrare componenti dedicate alla rappresentazione interna degli stati, alla metacognizione o alla gestione dell’attenzione, elementi che nelle teorie neuroscientifiche sono associati alla coscienza. Queste caratteristiche non sono semplici “feature”, ma implicano una riorganizzazione profonda del modo in cui i sistemi AI elaborano informazioni.

Un ulteriore aspetto riguarda il ruolo della coscienza nella performance stessa dei modelli. Alcuni ricercatori ipotizzano che certe forme di consapevolezza interna possano migliorare la capacità di generalizzazione, permettendo ai sistemi di adattarsi a contesti nuovi in modo più efficiente. In questo senso, la coscienza non sarebbe solo un problema filosofico, ma una possibile leva tecnica per superare i limiti attuali dell’AI.

La collaborazione tra discipline, in questo contesto, non è un lusso ma una necessità. La filosofia fornisce il linguaggio e i modelli concettuali per affrontare problemi che l’ingegneria, da sola, non può risolvere. Allo stesso tempo, l’AI offre alla filosofia un terreno empirico su cui testare ipotesi che per secoli sono rimaste puramente teoriche.

Il risultato è un campo di ricerca in cui i confini tra scienza, tecnologia e filosofia diventano sempre più sfumati. L’assunzione di un filosofo da parte di DeepMind non è quindi un’anomalia, ma il segnale di una nuova fase nello sviluppo dell’intelligenza artificiale, in cui comprendere la natura della mente – anche artificiale – diventa parte integrante del progresso tecnologico.