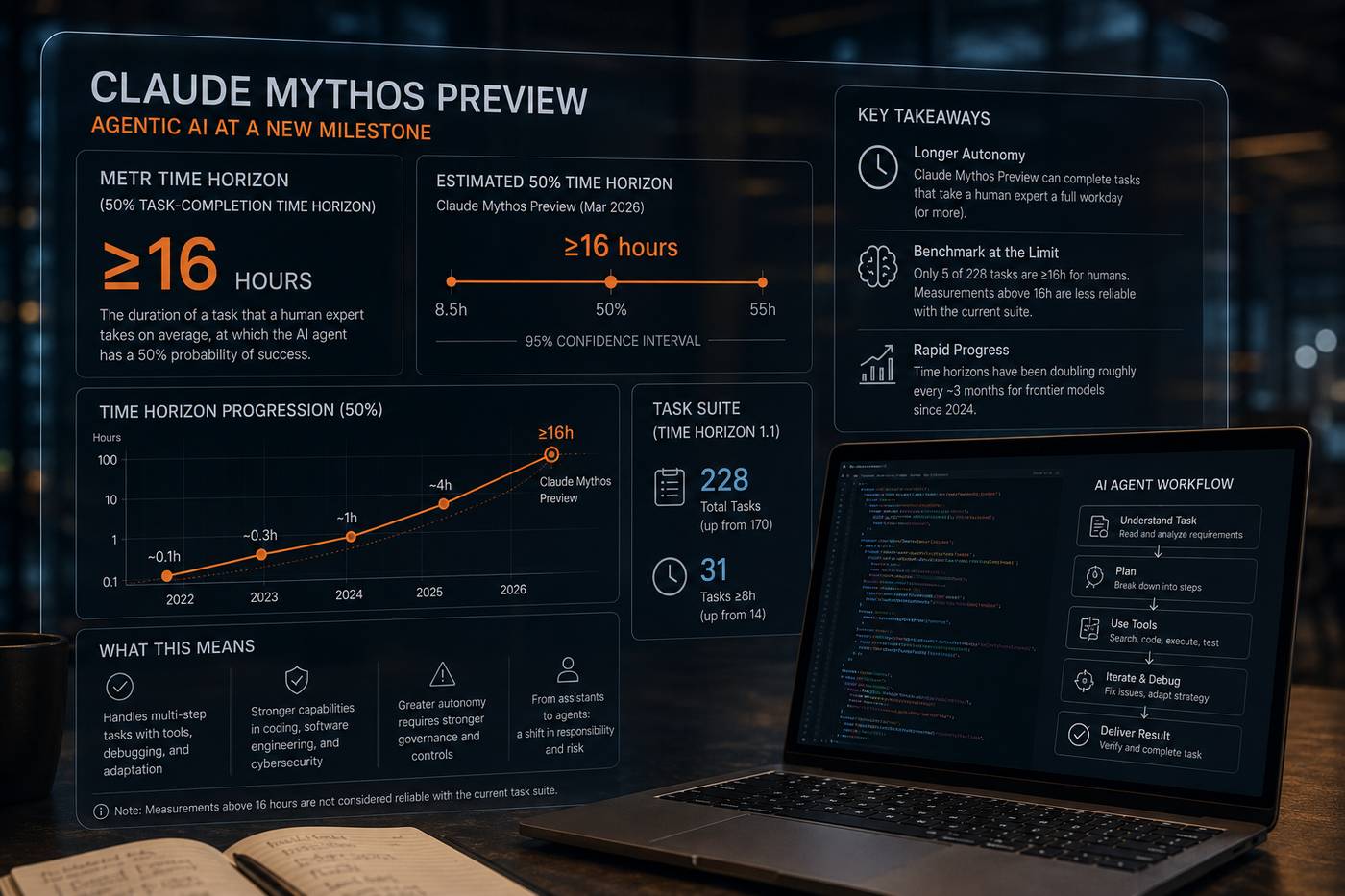

Claude Mythos Preview ha raggiunto un nuovo punto critico nelle valutazioni sull’autonomia degli agenti AI: una stima di almeno 16 ore nel “task-completion time horizon” di METR, cioè nella misura che prova a quantificare la durata di un’attività umana che un agente AI riesce a completare con una determinata probabilità di successo. Il dato è importante non perché significhi che il modello “lavora per 16 ore di fila”, ma perché indica che l’AI è arrivata a gestire compiti che, per un esperto umano, richiederebbero una giornata lavorativa lunga, con passaggi multipli, uso di strumenti, debugging, adattamento agli errori e mantenimento del contesto operativo. METR definisce infatti il time horizon come la durata del compito, misurata sul tempo medio di completamento umano, in corrispondenza della quale un agente riesce a completarlo con un certo livello di affidabilità; il 50% time horizon rappresenta il punto in cui il modello ha una probabilità stimata di successo pari alla metà.

Il risultato attribuito a Claude Mythos Preview riguarda una versione preliminare del modello valutata in una finestra limitata nel marzo 2026. METR ha stimato un 50% time horizon di almeno 16 ore, con un intervallo di confidenza molto ampio, compreso tra 8,5 e 55 ore. Proprio questa ampiezza è uno degli elementi più interessanti: non segnala soltanto una prestazione elevata, ma anche una difficoltà crescente nel misurare modelli che stanno arrivando al limite superiore della suite di test disponibile. Su 228 attività complessive, solo 5 sono classificate come compiti da 16 ore o più per un essere umano, rendendo instabile qualsiasi confronto quantitativo preciso oltre quella soglia.

Il punto tecnico centrale è quindi doppio. Da un lato, Claude Mythos Preview appare in grado di affrontare attività autonome molto più lunghe e complesse rispetto ai modelli precedenti. Dall’altro, il benchmark stesso inizia a saturare, perché non contiene abbastanza prove lunghe da distinguere con robustezza tra un modello da 16 ore, uno da 24 ore o uno potenzialmente ancora più capace. METR ha infatti inserito un’avvertenza esplicita: le misurazioni sopra le 16 ore non sono considerate affidabili con l’attuale task suite. Questo cambia il significato del risultato. Non è un semplice “punteggio record”, ma un segnale metodologico: il sistema di valutazione, progettato per misurare l’autonomia degli agenti frontier, sta raggiungendo il proprio tetto operativo.

Per comprendere il valore di questa soglia bisogna distinguere il benchmark METR dai test AI tradizionali. Molti benchmark misurano risposte isolate, problemi matematici, domande a scelta multipla, capacità di coding su task brevi o performance su dataset standardizzati. Il time horizon, invece, tenta di avvicinarsi a una domanda più concreta: quanto è lunga e articolata l’attività che un agente AI può completare senza intervento umano sostanziale? Le attività considerate da METR sono principalmente compiti di software engineering, machine learning e cybersecurity, progettati per essere autocontenuti, ben specificati e valutabili automaticamente. Questo non equivale a misurare qualsiasi lavoro umano, ma permette di osservare una dimensione fondamentale dell’autonomia operativa: la capacità di rimanere coerenti su un compito complesso attraverso molti passaggi.

La metodologia si basa su una curva logistica che mette in relazione la durata stimata del compito per un esperto umano e la probabilità di successo dell’agente. In pratica, per ciascun modello vengono eseguite più prove su attività di diversa difficoltà, poi si stima il punto in cui il modello riesce ancora a completare correttamente il compito nel 50% o nell’80% dei casi. Questo approccio è rilevante perché evita di ridurre la capacità agentica a una singola percentuale di accuracy. Un modello può essere molto efficace su compiti brevi e fallire su quelli più lunghi; oppure può mostrare meno brillantezza sui micro-benchmark ma maggiore capacità di recuperare errori, gestire strumenti e proseguire un piano articolato.

L’arrivo di Claude Mythos Preview alla soglia delle 16 ore suggerisce un cambiamento qualitativo. Nei compiti brevi, la differenza tra un assistente AI e un agente autonomo può restare sfumata: entrambi rispondono, generano codice, correggono errori o propongono soluzioni. Nei compiti lunghi, invece, emergono capacità più difficili da simulare: mantenere memoria operativa, verificare ipotesi, modificare strategia, usare tool esterni, individuare bug intermedi, riprendere da un fallimento e non perdere l’obiettivo finale. È proprio questa combinazione di persistenza, controllo del contesto e capacità di riparazione degli errori a rendere il time horizon una metrica più vicina alla produttività reale rispetto ai classici benchmark di risposta singola.

La versione aggiornata della suite, chiamata Time Horizon 1.1, è stata ampliata proprio per seguire questa crescita. METR ha portato il numero di attività da 170 a 228 e ha aumentato i compiti stimati da 8 ore o più da 14 a 31. L’obiettivo era rendere più solida la misurazione dei modelli recenti, che già iniziavano a superare i limiti delle prove più brevi. Tuttavia, anche dopo questo ampliamento, i risultati più alti restano difficili da stimare con precisione, perché le attività davvero lunghe sono ancora poche e perché solo una parte dei task lunghi dispone di tempi umani misurati direttamente.

Questo dettaglio è cruciale per evitare una lettura eccessivamente spettacolare del risultato. Un time horizon di 16 ore non significa che il modello possa sostituire automaticamente un professionista in ogni attività da una giornata. METR stessa chiarisce che i compiti sono più simili a incarichi ben definiti assegnati a una persona con poco contesto pregresso, come un nuovo collaboratore o un contractor remoto, piuttosto che al lavoro quotidiano di un esperto già immerso in un progetto, con conoscenza tacita del codice, delle decisioni precedenti e delle priorità aziendali. In ambienti reali, il contesto umano riduce spesso i tempi di esecuzione e rende più complesso il confronto diretto.

Allo stesso tempo, il dato non va minimizzato. La crescita storica dei time horizon mostra un’accelerazione significativa. Nella prima formulazione della metrica, METR aveva osservato che la durata dei compiti completabili autonomamente dai modelli frontier raddoppiava circa ogni sette mesi. Con la suite Time Horizon 1.1, il quadro più recente indica una dinamica ancora più rapida per i modelli dal 2024 in poi, con tempi di raddoppio nell’ordine di circa tre mesi. Questo significa che il progresso non riguarda solo la qualità delle risposte, ma la profondità temporale dei compiti che gli agenti possono sostenere.

Claude Mythos Preview si colloca in questo scenario come un modello particolarmente sensibile per via delle sue capacità di coding, agentic task e cybersecurity. Anthropic lo descrive come un modello frontier general-purpose, ma con capacità particolarmente marcate nella sicurezza informatica. Il modello è parte di Project Glasswing, un’iniziativa con accesso limitato pensata per usare capacità avanzate di AI nella ricerca e correzione di vulnerabilità in software critico, insieme a partner industriali e organizzazioni coinvolte nella protezione di infrastrutture digitali rilevanti.

Il collegamento tra autonomia di lunga durata e cybersecurity è particolarmente delicato. Un agente capace di completare attività software da molte ore può essere usato per audit difensivi, analisi di repository complessi, patching di vulnerabilità, reverse engineering controllato e verifica di codice legacy. Ma la stessa capacità operativa può ridurre la barriera tecnica per attività offensive, perché un modello più persistente riesce a concatenare passaggi, adattarsi ai fallimenti e costruire exploit con meno supervisione. Anthropic ha dichiarato che Mythos Preview ha mostrato capacità avanzate nell’identificazione e nello sfruttamento di vulnerabilità zero-day in sistemi reali, tanto da motivare una distribuzione iniziale controllata e orientata alla difesa.

La valutazione dell’AI Security Institute britannico rafforza questo punto. Nei test cyber, Mythos Preview ha mostrato miglioramenti sia nelle challenge CTF sia in simulazioni multi-step di attacco su reti vulnerabili. In una cyber range chiamata “The Last Ones”, progettata come simulazione di attacco aziendale in 32 passaggi e stimata in circa 20 ore di lavoro umano, Mythos Preview è stato il primo modello a completare l’intero percorso, riuscendoci in 3 tentativi su 10 e completando in media 22 passaggi su 32. Anche qui il dato non va interpretato come equivalenza piena con un attaccante reale, perché le simulazioni controllate sono più pulite e meno difese di ambienti produttivi, ma il salto operativo è evidente.

La soglia delle 16 ore cambia il modo in cui le aziende dovrebbero pensare agli agenti AI. Finché un modello riesce a completare attività da pochi minuti, il rischio operativo principale riguarda errori puntuali, suggerimenti sbagliati o codice difettoso. Quando un agente inizia a sostenere attività da molte ore, il rischio si sposta sulla catena decisionale: un errore commesso all’inizio può propagarsi, un’ipotesi sbagliata può diventare architettura, un’azione sui sistemi può generare effetti collaterali difficili da ricostruire. La governance deve quindi passare dalla semplice approvazione dell’output finale al monitoraggio dell’intero processo agentico.

Questo vale anche per l’uso positivo dei modelli. Un agente capace di gestire compiti lunghi può diventare utile in manutenzione software, migrazione di codice, test automatici, triage di bug, refactoring, analisi di log e sicurezza applicativa. Ma perché queste applicazioni siano affidabili servono ambienti isolati, permessi granulari, audit trail completi, rollback, limiti di accesso ai repository, controllo delle dipendenze e supervisione umana nei passaggi ad alto impatto. L’autonomia non elimina il bisogno di controllo: lo sposta a un livello più alto, dove l’azienda deve decidere quali operazioni l’agente può pianificare, quali può eseguire e quali richiedono autorizzazione esplicita.

Il limite raggiunto da METR evidenzia anche un problema più ampio per l’intero settore AI: i benchmark devono diventare più lunghi, più realistici e più difficili da saturare. Quando i modelli superano i test disponibili, il rischio è duplice. Da una parte si sottostimano le capacità reali, perché la metrica non riesce più a distinguere i livelli superiori. Dall’altra si possono fare estrapolazioni troppo aggressive su dati instabili, trasformando pochi task lunghi in previsioni eccessivamente precise. Per questo METR invita alla cautela nell’interpretare i numeri sopra le 16 ore e sta lavorando a metodi aggiornati per misurare modelli più potenti.

Il dato più significativo, quindi, non è solo che Claude Mythos Preview abbia raggiunto un time horizon di almeno 16 ore. È che un modello frontier abbia portato una delle metriche più osservate sull’autonomia agentica fino al punto in cui il sistema di misura deve essere ripensato. Questo è un segnale maturo del progresso AI: non soltanto modelli più bravi a rispondere, ma modelli abbastanza capaci da mettere in crisi le infrastrutture di valutazione costruite per contenerne e comprenderne l’evoluzione.

Per il mercato, la conseguenza sarà una distinzione sempre più netta tra assistenti AI e agenti AI. Gli assistenti aiutano l’utente a produrre un output. Gli agenti portano avanti un processo. La differenza non è semantica, ma operativa: un processo lungo implica memoria, strumenti, controllo, rischio, responsabilità e possibilità di errore cumulativo. La soglia delle 16 ore indica che i modelli frontier stanno entrando in questa seconda categoria con una velocità che rende urgente aggiornare sia i benchmark sia le policy aziendali.