Nvidia ha presentato una nuova tecnica di post-training chiamata “Star Elastic”, progettata per consentire la creazione di modelli AI di dimensioni differenti partendo da un unico checkpoint addestrato. L’obiettivo è ridurre drasticamente i costi computazionali, infrastrutturali e operativi legati alla gestione di molteplici varianti di uno stesso modello linguistico, introducendo un’architettura “elastica” capace di adattarsi dinamicamente a diversi livelli di capacità e consumo hardware.

Il problema che Star Elastic cerca di risolvere è diventato centrale nello sviluppo dei moderni Large Language Model. Oggi le aziende AI distribuiscono spesso versioni multiple dello stesso modello, ad esempio 8B, 30B o 70B parametri, per adattarsi a differenti casi d’uso, livelli di latenza e capacità hardware. Ogni variante richiede normalmente training, ottimizzazione, storage e deployment separati. Questo comporta costi enormi sia dal punto di vista computazionale sia dal lato operativo, perché ogni modello deve essere mantenuto, aggiornato e servito indipendentemente.

La tecnica proposta da Nvidia cambia radicalmente questo approccio introducendo il concetto di modello “nested”, cioè un modello principale che contiene al proprio interno sottoversioni più piccole come sottoinsiemi strutturali del modello completo. In pratica, invece di addestrare tre modelli differenti, si costruisce un singolo modello padre dal quale possono essere estratti modelli più compatti mantenendo parte significativa delle performance originarie.

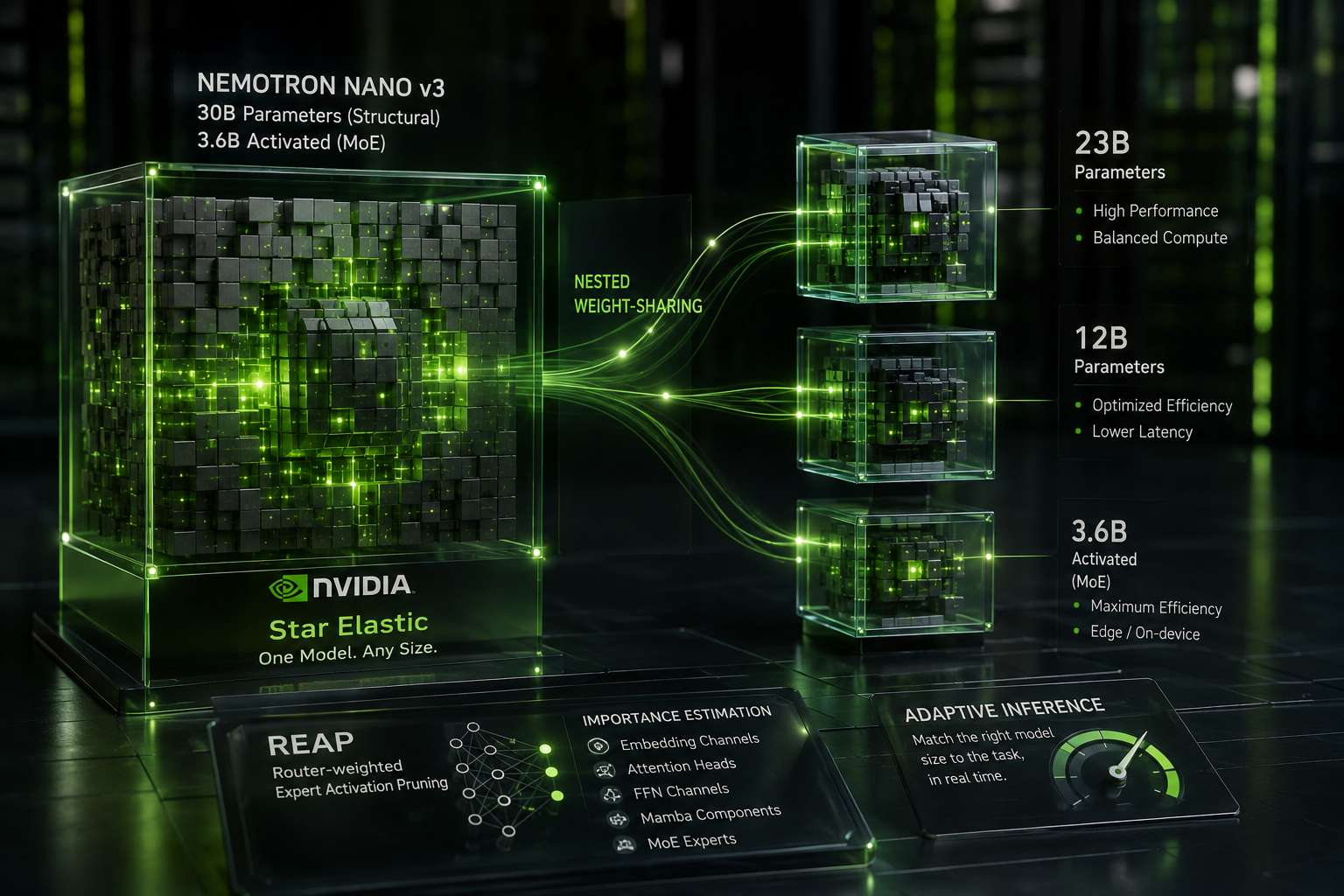

Nel caso mostrato da Nvidia, il lavoro è stato sviluppato utilizzando come base Nemotron Nano v3, un modello con circa 30 miliardi di parametri strutturali ma con solo 3,6 miliardi di parametri effettivamente attivati grazie all’utilizzo di un’architettura Mixture of Experts (MoE). Con Star Elastic, da questo modello possono essere generate versioni più piccole da 23B e 12B mantenendo la stessa struttura di base e condividendo pesi selezionati.

Il cuore tecnico del sistema è il meccanismo di “nested weight-sharing”, cioè la condivisione gerarchica dei pesi tra le diverse dimensioni del modello. Nvidia non si limita semplicemente a tagliare parametri o ridurre layer come avviene nei classici processi di pruning. Il sistema cerca invece di identificare quali componenti della rete neurale contribuiscano maggiormente alla qualità finale del modello e li preserva sistematicamente anche nelle varianti più piccole.

Per farlo viene utilizzato un processo chiamato “importance estimation”. L’algoritmo valuta il contributo effettivo di embedding channels, attention heads, FFN channels, componenti Mamba e soprattutto esperti MoE, cercando di determinare quali parti della rete abbiano il peso maggiore nel mantenimento delle performance. I componenti più importanti vengono quindi mantenuti in tutte le varianti elastiche del modello, mentre quelli meno critici possono essere rimossi nelle versioni compatte.

Questo approccio è particolarmente interessante perché affronta uno dei problemi storici del pruning neurale: il degrado qualitativo. Molti sistemi di compressione riducono parametri o layer ma introducono rapidamente perdita di accuratezza, peggioramento del reasoning o instabilità generativa. Star Elastic cerca invece di preservare la struttura funzionale del modello mantenendo le parti statisticamente più rilevanti.

Nel caso delle architetture Mixture of Experts, il problema diventa ancora più complesso. I modelli MoE non attivano contemporaneamente tutti i parametri, ma utilizzano un sistema di routing che seleziona dinamicamente quali esperti utilizzare per ogni token o sequenza. Questo consente di costruire modelli enormi mantenendo relativamente basso il numero di parametri attivi durante l’inferenza.

Nvidia ha sviluppato per questo un sistema specifico chiamato REAP, acronimo di “Router-weighted Expert Activation Pruning”. La tecnica non si limita a misurare quanto frequentemente un esperto venga utilizzato, ma considera contemporaneamente i valori di routing e il contributo reale dell’esperto all’output finale. In questo modo il sistema cerca di preservare gli esperti realmente importanti invece di mantenere semplicemente quelli statisticamente più attivati.

Il vantaggio infrastrutturale di questo approccio potrebbe essere enorme. Oggi molte aziende devono mantenere versioni differenti dello stesso LLM per deployment cloud, edge AI, inferenza mobile e ambienti enterprise con hardware eterogeneo. Gestire queste varianti richiede enormi quantità di storage, pipeline separate di ottimizzazione e deployment multipli.

Con un modello elastico, invece, sarebbe teoricamente possibile distribuire un unico checkpoint dal quale derivare dinamicamente varianti differenti in base alle risorse disponibili. Un server ad alta potenza potrebbe eseguire la versione completa del modello, mentre un’infrastruttura più limitata potrebbe utilizzare una sottoversione compatta senza dover scaricare o addestrare modelli separati.

Questo aspetto è particolarmente importante per l’AI enterprise e per l’edge computing. Molte aziende stanno infatti cercando di portare modelli AI direttamente su dispositivi locali, workstation o ambienti on-premise per motivi di privacy, latenza e sovranità dei dati. Tuttavia i modelli frontier risultano spesso troppo grandi per essere eseguiti efficientemente su hardware limitato. Le architetture elastiche potrebbero offrire una soluzione intermedia tra qualità e sostenibilità computazionale.

La tecnica si inserisce inoltre in una tendenza più ampia del settore AI: la ricerca di efficienza. Negli ultimi anni il progresso dei modelli è stato trainato soprattutto dalla crescita delle dimensioni e della potenza computazionale. Tuttavia questo approccio sta iniziando a mostrare limiti economici ed energetici sempre più evidenti. I costi di training e inferenza dei modelli frontier stanno aumentando a ritmi difficili da sostenere anche per i principali hyperscaler.

Per questo motivo molte aziende stanno investendo in tecniche di compressione, distillazione, quantizzazione e sparse computing. Star Elastic rappresenta un’evoluzione di questa direzione, ma con un approccio più flessibile rispetto ai classici sistemi statici di model compression.

Dal punto di vista operativo, uno dei vantaggi più interessanti riguarda il deployment dinamico. In teoria, un sistema AI potrebbe adattare automaticamente la dimensione del modello in funzione del carico infrastrutturale, della complessità della richiesta o dei vincoli energetici. Query semplici potrebbero essere eseguite da una sottoversione compatta, mentre task complessi potrebbero attivare il modello completo.

Questo concetto si avvicina all’idea di “adaptive inference”, cioè sistemi AI capaci di modulare dinamicamente il consumo computazionale in tempo reale. In un contesto di crescente domanda AI globale, l’efficienza energetica sta diventando una priorità critica sia economica sia infrastrutturale.

L’impatto potenziale riguarda anche il mercato hardware. Nvidia domina attualmente il settore AI non soltanto grazie alle GPU, ma anche attraverso il controllo dell’intero stack software e infrastrutturale. Tecniche come Star Elastic rafforzano ulteriormente questa posizione perché consentono di ottimizzare l’utilizzo delle risorse GPU in modo molto più granulare.

Le architetture elastiche potrebbero inoltre ridurre alcuni dei problemi di frammentazione dei deployment enterprise. Oggi molte organizzazioni devono scegliere tra modelli piccoli ma veloci e modelli grandi ma costosi. Un framework elastico consentirebbe invece di utilizzare una singola architettura adattabile a contesti differenti.