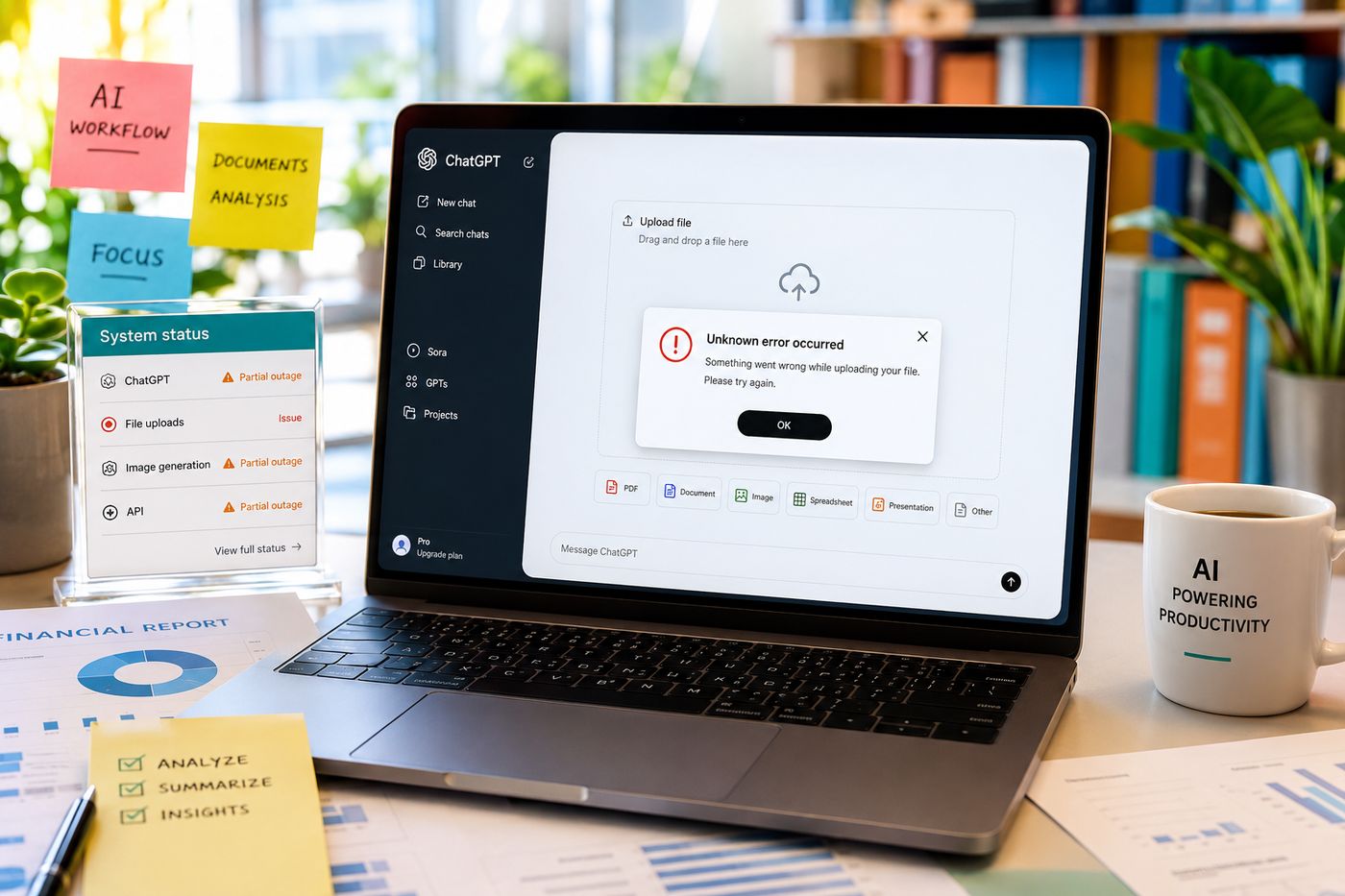

Un nuovo malfunzionamento ha colpito il sistema di upload file di ChatGPT, causando errori diffusi durante il caricamento di documenti, PDF, immagini e allegati utilizzati nelle conversazioni con l’assistente. Gli utenti hanno iniziato a segnalare messaggi come “Unknown error occurred” o blocchi improvvisi del caricamento, con impossibilità di completare l’analisi dei file o utilizzare funzionalità collegate agli strumenti multimodali della piattaforma. Secondo la pagina di stato di OpenAI, il problema si inserisce in una serie di interruzioni operative che hanno coinvolto ChatGPT, generazione immagini e API nel corso delle ultime settimane.

Il problema è particolarmente significativo perché il caricamento file rappresenta oggi uno dei componenti centrali delle piattaforme AI enterprise e consumer. ChatGPT non viene più utilizzato soltanto come chatbot testuale: molte aziende lo impiegano per analisi documentale, revisione contratti, interpretazione di report PDF, sintesi di spreadsheet, lettura di immagini tecniche e gestione di workflow multimodali complessi. Quando il sistema di upload smette di funzionare, non si interrompe semplicemente una funzione accessoria, ma si blocca una parte rilevante dell’interazione uomo-macchina nelle architetture AI moderne.

I sistemi di upload AI sono molto più complessi di quanto possano sembrare. Il caricamento di un file all’interno di una piattaforma generativa non consiste soltanto nel trasferire dati verso un server. Il documento deve essere verificato, processato, convertito, indicizzato e reso compatibile con la pipeline di inferenza del modello. Nel caso di PDF, ad esempio, il sistema deve estrarre testo, interpretare layout, separare immagini, ricostruire tabelle e generare rappresentazioni tokenizzate utilizzabili dal modello linguistico. Nel caso delle immagini, entrano in gioco pipeline vision separate che effettuano preprocessamento, ridimensionamento, encoding e gestione della memoria GPU.

Questo rende i sistemi multimodali particolarmente vulnerabili ai colli di bottiglia infrastrutturali. A differenza delle semplici query testuali, l’upload di file richiede storage temporaneo, sistemi di parsing, code di elaborazione asincrona e spesso orchestrazione tra microservizi differenti. Un errore in uno solo di questi layer può impedire il completamento dell’intero workflow. In ambienti ad altissimo traffico come ChatGPT, anche piccoli problemi di sincronizzazione tra frontend, storage object service e pipeline inference possono propagarsi rapidamente generando errori diffusi.

La frequenza crescente degli outage riflette anche il cambiamento architetturale delle piattaforme AI moderne. I grandi provider stanno progressivamente trasformando i chatbot in ambienti operativi completi, con memoria persistente, strumenti integrati, agenti autonomi, elaborazione documentale e capacità multimodali. Ogni nuova funzione introduce però dipendenze infrastrutturali aggiuntive. Il sistema non deve più soltanto generare testo: deve coordinare retrieval, storage, autenticazione, orchestrazione agentica, accesso a tool esterni e gestione di file eterogenei.

Questo fenomeno sta modificando profondamente anche il profilo di rischio operativo delle AI platform. Nei primi anni dell’AI generativa, il problema principale riguardava accuratezza e qualità delle risposte. Oggi la sfida si sta spostando sulla resilienza infrastrutturale. Una piattaforma enterprise AI deve garantire disponibilità continua, consistenza operativa e gestione stabile di carichi multimodali estremamente variabili. I sistemi diventano quindi sempre più simili a grandi cloud platform distribuite piuttosto che a semplici modelli linguistici accessibili via chat.

La gestione dei file rappresenta uno dei punti più delicati perché coinvolge direttamente memoria, banda e consumo computazionale. I documenti caricati possono contenere centinaia di pagine, immagini ad alta risoluzione o dataset complessi che richiedono quantità elevate di VRAM e inferenza prolungata. Questo comporta una pressione enorme sulle infrastrutture GPU, soprattutto nei momenti di picco globale. Un aumento improvviso dei caricamenti può saturare code di elaborazione, storage temporaneo o servizi di parsing documentale molto prima che si saturino i sistemi di generazione testuale tradizionali.

Esiste inoltre un problema di frammentazione tecnologica. I file caricati dagli utenti possono avere formati estremamente diversi: PDF generati digitalmente, scansioni OCR, immagini compresse, fogli Excel complessi, documenti corrotti o file prodotti da software legacy. Ogni categoria richiede pipeline differenti e introduce possibili punti di errore. La multimodalità amplia enormemente la superficie tecnica da gestire rispetto ai chatbot text-only.

Il malfunzionamento evidenzia anche quanto le piattaforme AI siano diventate infrastrutture critiche per il lavoro quotidiano. Molti utenti utilizzano ChatGPT come ambiente operativo integrato per revisione documentale, coding, analisi finanziaria, ricerca e gestione dati. Quando il caricamento file si interrompe, vengono bloccati workflow professionali reali. Questo è uno degli effetti più evidenti della trasformazione dell’AI generativa da strumento sperimentale a componente infrastrutturale del lavoro digitale.