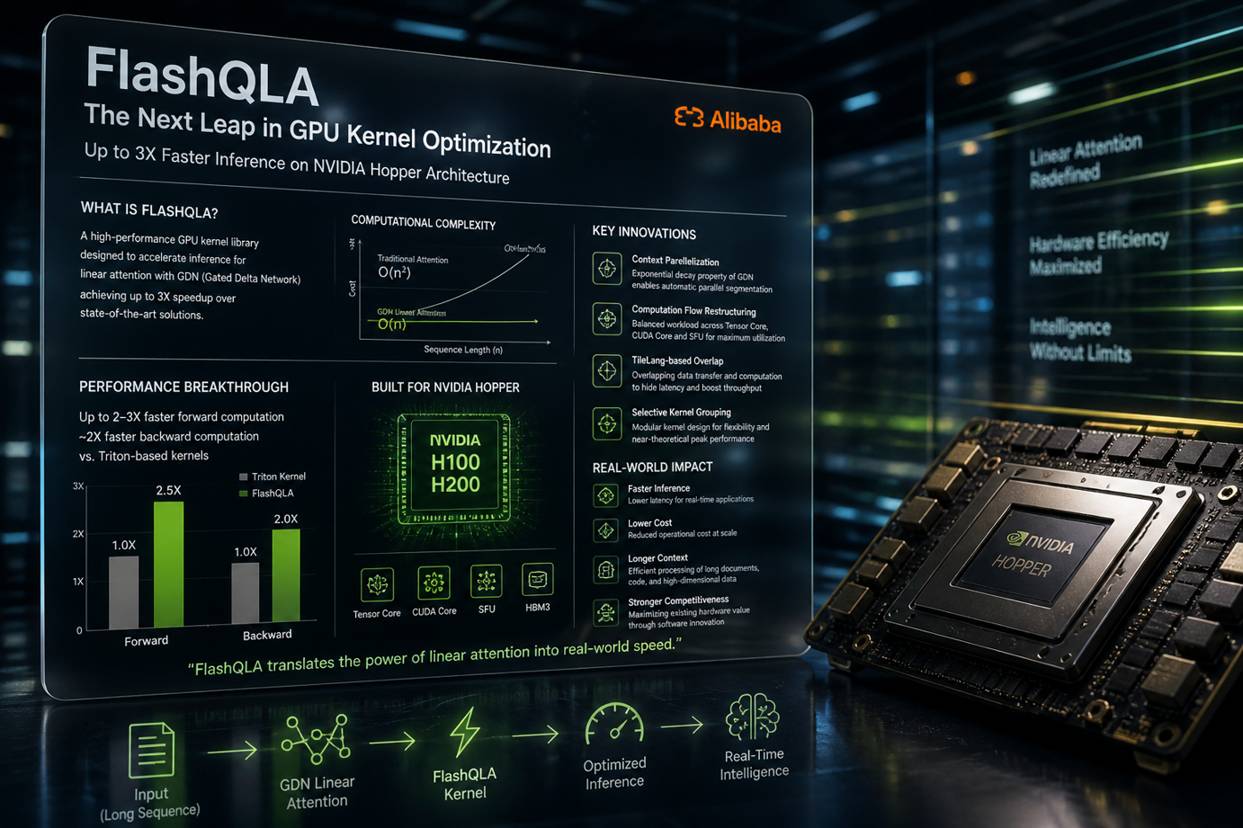

Nel contesto attuale della competizione tra modelli linguistici avanzati, il focus tecnologico si sta progressivamente spostando dai livelli più visibili dell’innovazione, come l’architettura dei modelli o la disponibilità di hardware avanzato, verso uno strato molto più profondo e meno accessibile: quello dei kernel GPU. È in questo ambito che Alibaba ha introdotto FlashQLA, una libreria progettata per ottimizzare in modo radicale i calcoli di inferenza, raggiungendo miglioramenti di velocità fino a tre volte rispetto alle soluzioni esistenti sulle architetture Hopper di NVIDIA.

Il kernel GPU rappresenta il livello più basso dell’esecuzione computazionale nei sistemi di intelligenza artificiale, ed è responsabile della gestione diretta delle operazioni matematiche che costituiscono il cuore dei modelli. La sua progettazione richiede una conoscenza estremamente dettagliata delle caratteristiche hardware, inclusa la gestione della memoria, la sincronizzazione delle operazioni e l’utilizzo efficiente delle unità di calcolo come Tensor Core, CUDA Core e Special Function Unit. Nonostante questa complessità, gran parte degli sviluppatori si affida a framework intermedi come Triton o FlashAttention, che semplificano lo sviluppo ma introducono inevitabilmente limiti nell’ottimizzazione specifica per singole architetture GPU.

FlashQLA nasce proprio per superare questi limiti, proponendo un’implementazione altamente specializzata per una particolare forma di attenzione lineare basata sulla struttura GDN, acronimo di Gated Delta Network. Questa architettura affronta uno dei problemi più critici dei modelli Transformer tradizionali: la crescita quadratica del costo computazionale rispetto alla lunghezza dell’input. Nei sistemi convenzionali, infatti, il meccanismo di attenzione richiede operazioni che scalano con il quadrato del numero di token, rendendo estremamente onerosa l’elaborazione di sequenze lunghe. GDN introduce una trasformazione che riduce questa complessità a una crescita lineare, modificando radicalmente il profilo di efficienza del modello.

Questa riduzione della complessità computazionale ha implicazioni dirette sulle applicazioni pratiche. L’elaborazione di documenti estesi, codice sorgente o flussi di dati ad alta dimensionalità diventa significativamente più sostenibile, sia in termini di tempo che di consumo di risorse. In questo scenario, FlashQLA si posiziona come un abilitatore tecnologico, traducendo i vantaggi teorici dell’attenzione lineare in prestazioni concrete a livello hardware.

Un elemento distintivo dell’approccio adottato da Alibaba è l’integrazione di FlashQLA in un ecosistema più ampio, rappresentato dal modello Q-One, che utilizza una struttura ibrida. Questo modello combina l’attenzione lineare basata su GDN con meccanismi di attenzione tradizionali, come l’attenzione di pooling, per mantenere un equilibrio tra efficienza computazionale ed espressività. L’obiettivo non è semplicemente ridurre i costi, ma preservare la capacità del modello di catturare relazioni complesse nei dati, intervenendo selettivamente sulle parti dell’architettura in cui l’ottimizzazione porta i maggiori benefici.

I miglioramenti di prestazione dichiarati da FlashQLA derivano da una serie di innovazioni mirate. Una delle più rilevanti è la cosiddetta parallelizzazione contestuale, che sfrutta la proprietà di decadimento esponenziale del meccanismo GDN per suddividere automaticamente sequenze lunghe in segmenti elaborabili in parallelo. Questo consente alla GPU di mantenere un elevato grado di occupazione, riducendo i tempi morti e aumentando l’efficienza complessiva dell’elaborazione.

Un secondo elemento riguarda la ristrutturazione del flusso di calcolo, progettata per ridurre il carico sulle unità computazionali interne. Ottimizzando la distribuzione delle operazioni tra Tensor Core, CUDA Core e altre unità specializzate, FlashQLA riesce a massimizzare l’utilizzo delle risorse disponibili, evitando colli di bottiglia che limitano le prestazioni nei kernel più generici. Questo tipo di ottimizzazione richiede una comprensione approfondita dell’hardware Hopper, inclusi modelli come H100 e H200, per i quali la libreria è stata specificamente progettata.

Un terzo contributo significativo è rappresentato dall’adozione di un approccio basato su TileLang, che consente di sovrapporre le operazioni di trasferimento dati e calcolo. In un sistema GPU tradizionale, queste due fasi sono spesso sequenziali, con conseguenti tempi di attesa che riducono l’efficienza complessiva. L’esecuzione simultanea permette invece di minimizzare le latenze e aumentare il throughput, contribuendo in modo diretto al miglioramento delle prestazioni osservato.

Un aspetto particolarmente interessante della progettazione di FlashQLA è la scelta di non concentrare tutte le operazioni in un singolo kernel monolitico. Al contrario, le operazioni vengono raggruppate in modo selettivo, mantenendo una certa modularità che consente ottimizzazioni specifiche per ciascuna fase del calcolo. Questa strategia aumenta la flessibilità del sistema e permette di avvicinarsi alle prestazioni teoriche massime delle GPU, un obiettivo raramente raggiunto nei contesti applicativi reali.

I risultati empirici riportati indicano miglioramenti fino a 2-3 volte nei calcoli forward e circa 2 volte nei calcoli backward rispetto ai kernel basati su Triton. Questi numeri non rappresentano soltanto un incremento di velocità, ma hanno implicazioni economiche dirette. Ridurre il tempo di inferenza significa abbattere i costi operativi dei servizi basati su intelligenza artificiale, soprattutto in scenari che richiedono l’elaborazione di grandi volumi di dati o interazioni in tempo reale.

L’impatto strategico di questa innovazione si estende oltre il piano puramente tecnico. In un contesto geopolitico caratterizzato da restrizioni sull’esportazione di hardware avanzato per l’intelligenza artificiale, l’ottimizzazione software diventa un fattore critico per mantenere la competitività. L’iniziativa di Alibaba può essere interpretata come un tentativo di massimizzare il valore dei chip NVIDIA già disponibili, compensando eventuali limitazioni nell’accesso a nuove generazioni di hardware attraverso un utilizzo più efficiente delle risorse esistenti.