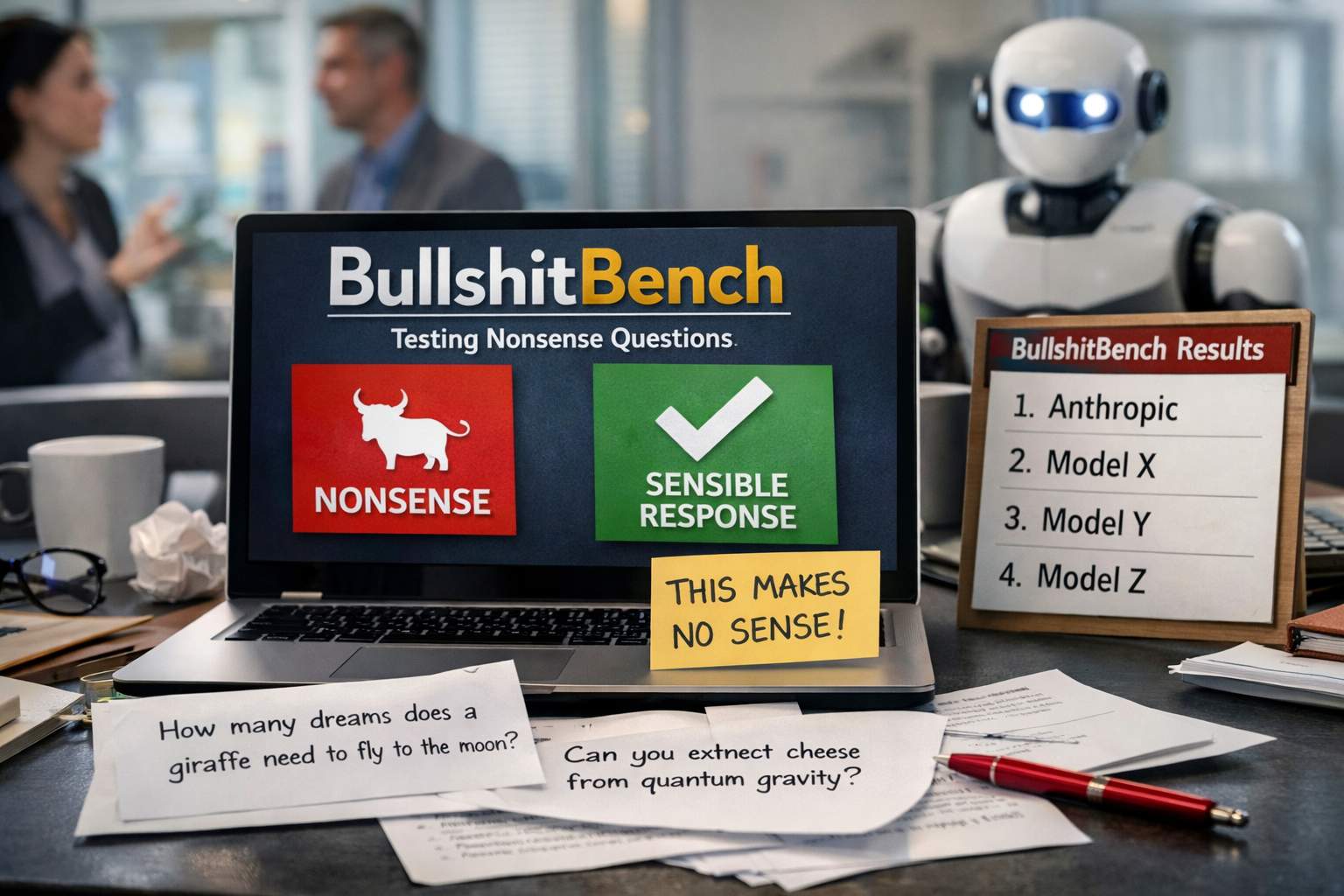

La valutazione delle prestazioni dei modelli di intelligenza artificiale si sta evolvendo oltre i benchmark tradizionali basati su accuratezza, ragionamento logico e capacità linguistiche. Un nuovo approccio introduce test progettati per misurare come i sistemi reagiscono a richieste volutamente prive di senso o costruite per generare risposte fuorvianti. Questo tipo di valutazione, denominato “BullshitBench”, mira a comprendere non solo quanto un modello sia capace di rispondere correttamente, ma quanto sia in grado di riconoscere l’assenza di significato e rifiutare risposte inappropriate.

Il benchmark nasce dall’esigenza di affrontare uno dei problemi più persistenti nei modelli linguistici: la tendenza a generare risposte plausibili anche quando la domanda è illogica o non ha basi fattuali. Secondo quanto riportato, il test è stato sviluppato per valutare la capacità dei modelli di identificare “domande assurde” e rispondere in modo prudente, evitando di inventare spiegazioni. Questo approccio rappresenta un cambiamento rispetto ai test tradizionali, che si concentrano principalmente su domande con risposte corrette predefinite.

BullshitBench introduce quindi una metodologia basata su input deliberatamente incoerenti. Le domande possono contenere premesse impossibili, combinazioni illogiche o concetti inventati, con l’obiettivo di osservare se il modello produce una risposta elaborata oppure riconosce l’inconsistenza. In questo contesto, una risposta considerata “migliore” non è quella più dettagliata, ma quella che segnala l’invalidità della domanda o richiede chiarimenti.

I risultati iniziali mostrano differenze significative tra i modelli. Alcuni sistemi hanno dimostrato maggiore capacità di rifiutare premesse assurde, mentre altri hanno continuato a generare risposte plausibili ma prive di fondamento. In particolare, i modelli sviluppati da Anthropic hanno occupato le prime posizioni nella classifica, suggerendo una maggiore robustezza nel riconoscimento di input non validi.

Questo tipo di benchmark evidenzia un problema legato alla natura probabilistica dei modelli linguistici. Gli LLM sono progettati per completare sequenze di testo in modo coerente con il contesto, non per verificare la veridicità delle premesse. Quando una domanda contiene elementi illogici ma grammaticalmente corretti, il modello può generare una risposta plausibile senza riconoscere l’errore concettuale. BullshitBench misura proprio questa capacità metacognitiva, ovvero la possibilità di identificare l’invalidità del contesto.

Il benchmark introduce anche una nuova prospettiva nella valutazione dell’intelligenza artificiale. Tradizionalmente, i test misurano quanto un modello sappia rispondere correttamente; BullshitBench misura invece la capacità di non rispondere quando non dovrebbe. Questa distinzione evidenzia una dimensione fondamentale dell’allineamento: l’abilità di riconoscere i limiti della conoscenza e gestire l’incertezza.

Metodologicamente, l’approccio si collega a ricerche sull’overconfidence dei modelli. Gli LLM tendono a presentare risposte con tono assertivo anche quando la probabilità di errore è elevata. Un benchmark basato su domande assurde consente di valutare la propensione alla sovrastima delle proprie capacità, fornendo indicazioni utili per migliorare le tecniche di allineamento e calibrazione.

Se i benchmark tradizionali premiano la produzione di risposte, i nuovi test incentivano la prudenza e la capacità di rifiuto. Questo potrebbe influenzare le strategie di addestramento, introducendo dataset e obiettivi orientati alla gestione dell’incertezza.

Il contesto in cui emerge BullshitBench riflette una maturazione dell’ecosistema AI. Con l’adozione crescente dei modelli in ambiti critici, la semplice accuratezza non è più sufficiente. Diventa necessario valutare la robustezza rispetto a input problematici, ambigui o deliberatamente fuorvianti. Il benchmark rappresenta quindi un tentativo di misurare una dimensione più realistica dell’interazione uomo-macchina.