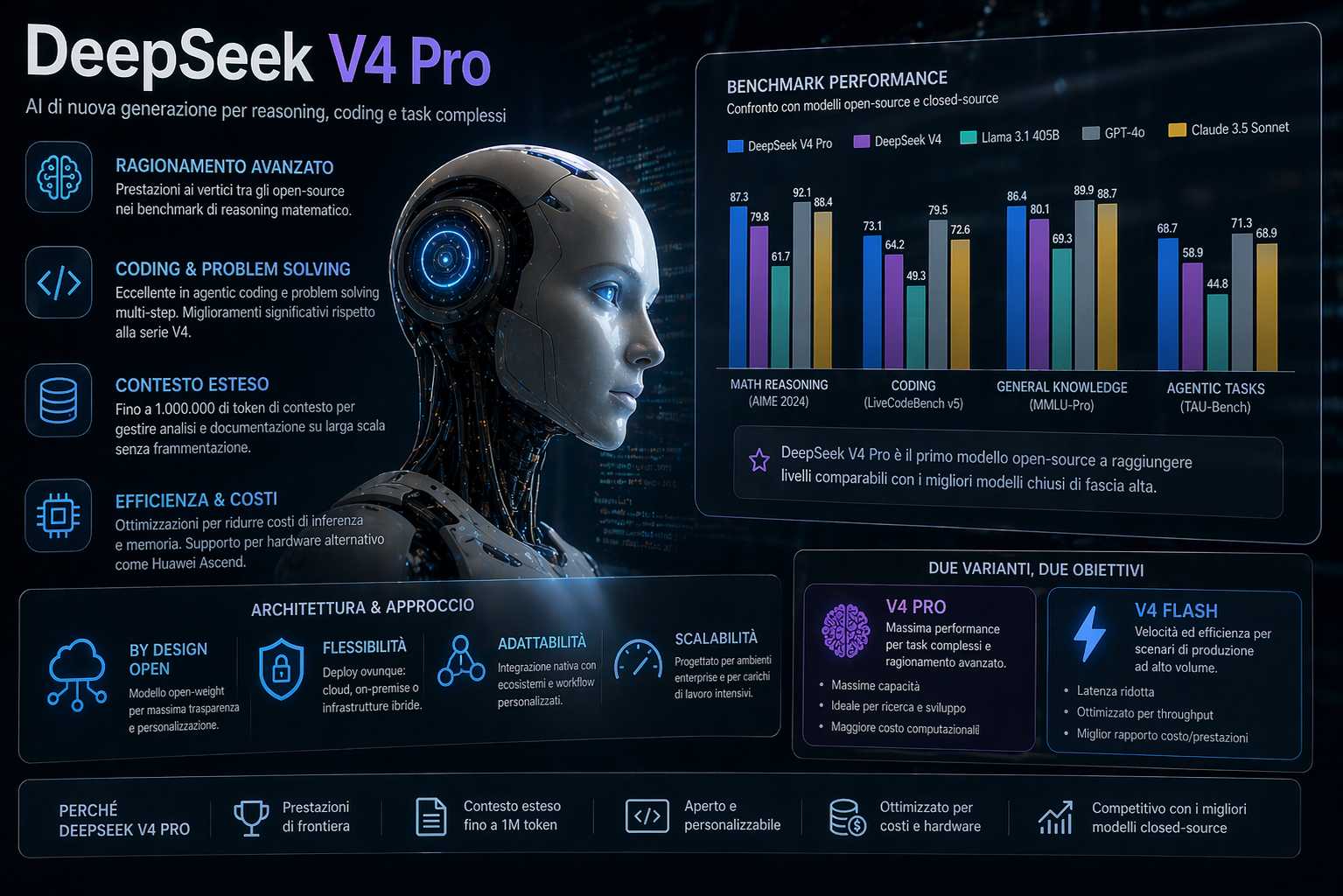

DeepSeek V4 Pro viene presentato come la variante ad alte prestazioni della nuova famiglia V4, progettata per massimizzare le capacità di ragionamento, coding e gestione di task multi-step. Questo orientamento emerge chiaramente dai risultati riportati, che evidenziano performance competitive su benchmark chiave legati al ragionamento matematico, alla programmazione e alla conoscenza generale. In particolare, il modello si posiziona ai vertici tra le soluzioni open-source e, in alcuni casi, riduce significativamente il gap rispetto ai modelli chiusi più avanzati, pur senza superarli sistematicamente in ogni metrica.

Uno degli aspetti tecnici più rilevanti riguarda l’architettura e la gestione del contesto. DeepSeek V4 introduce un contesto esteso fino a un milione di token, una soglia che consente di affrontare scenari operativi complessi, come analisi di codice su larga scala o elaborazione di documentazione tecnica estesa, senza frammentazione del contesto. Questo elemento non è solo quantitativo, ma riflette una scelta progettuale orientata all’utilizzo in ambienti agentici, dove la continuità informativa è essenziale per mantenere coerenza tra le diverse fasi di un task.

DeepSeek V4 Pro è stato testato su una serie di suite che rappresentano oggi lo standard de facto per valutare modelli di frontiera. Tra questi, i test di coding e reasoning mostrano un miglioramento netto rispetto alle versioni precedenti della stessa famiglia, mentre nei benchmark di conoscenza generale il modello si colloca tra i migliori open-weight disponibili. Tuttavia, il confronto con i modelli proprietari evidenzia ancora un leggero svantaggio, soprattutto nelle attività che richiedono integrazione multimodale avanzata o ragionamento altamente astratto.

Questo risultato, apparentemente intermedio, assume però un significato diverso se analizzato nel contesto dell’open-source. DeepSeek V4 Pro viene infatti posizionato come il primo modello open a raggiungere livelli di performance comparabili con sistemi chiusi di fascia alta, riducendo drasticamente la distanza che fino a poco tempo fa separava questi due ecosistemi. In questo senso, il valore del modello non risiede solo nei numeri assoluti, ma nel fatto che tali prestazioni siano ottenute in un contesto di maggiore accessibilità e potenziale personalizzazione.

DeepSeek ha introdotto ottimizzazioni specifiche per ridurre i costi di inferenza e memoria, un aspetto particolarmente rilevante per l’utilizzo in ambienti enterprise o su infrastrutture non hyperscale. L’architettura del modello è stata progettata per mantenere alte prestazioni anche su hardware alternativo rispetto agli standard dominati da NVIDIA, come dimostra l’adattamento ai chip Ascend di Huawei.

La presenza di due varianti, Pro e Flash, rafforza ulteriormente questa impostazione. Mentre la versione Pro punta alla massima performance su task complessi, la variante Flash privilegia velocità ed efficienza, offrendo una soluzione più adatta a scenari di produzione ad alto volume. Questa dualità evidenzia una tendenza crescente nel design dei modelli AI: non esiste più un’unica configurazione ottimale, ma un insieme di compromessi tra capacità, costo e latenza.

DeepSeek V4 Pro è particolarmente competitivo nei contesti di “agentic coding” e problem solving strutturato. Questo significa che il modello non si limita a generare codice, ma è in grado di affrontare problemi complessi, decomporli in sottotask e produrre soluzioni coerenti lungo più passaggi. Si tratta di una capacità sempre più centrale nell’evoluzione degli LLM, perché segna il passaggio da strumenti di generazione a veri e propri sistemi operativi cognitivi.

Nonostante questi progressi, rimangono alcune limitazioni strutturali. Il modello, pur essendo competitivo, non supera in modo consistente i migliori sistemi closed-source, soprattutto nei benchmark più avanzati. Inoltre, il costo computazionale della versione Pro può risultare significativamente più elevato rispetto a soluzioni ottimizzate per l’efficienza, limitandone l’adozione in contesti con risorse limitate.

DeepSeek non cerca più di competere solo sulla qualità delle risposte, ma su un equilibrio tra prestazioni, apertura e costo. Questo sposta il confronto con OpenAI e Anthropic su un piano diverso, dove la disponibilità del modello e la possibilità di personalizzazione diventano fattori altrettanto rilevanti quanto i benchmark puri.