Colpisci le tue foto con questo strumento di privacy AI per ingannare il riconoscimento facciale

Il riconoscimento facciale ubiquitario è una grave minaccia alla privacy. L’idea che le foto che condividiamo vengano raccolte dalle aziende per formare algoritmi venduti commercialmente è preoccupante. Chiunque può acquistare questi strumenti, scattare una foto di uno sconosciuto e scoprire chi sono in pochi secondi. Ma i ricercatori hanno escogitato un modo intelligente per aiutare a combattere questo problema.

La soluzione è uno strumento chiamato Fawkes ed è stato creato dagli scienziati del Sand Lab dell’Università di Chicago. Prende il nome dalle maschere di Guy Fawkes indossate dai rivoluzionari nel fumetto e nel film V per Vendetta , Fawkes usa l’intelligenza artificiale per alterare sottilmente e quasi impercettibilmente le tue foto al fine di ingannare i sistemi di riconoscimento facciale.

FAR GIRARE FAWKES SULLE TUE FOTO È COME AGGIUNGERE UNA MASCHERA INVISIBILE AI TUOI SELFIE

Il modo in cui funziona il software è un po ‘complesso. Scorrere le tue foto attraverso Fawkes non ti rende esattamente invisibile al riconoscimento facciale. Invece, il software apporta sottili modifiche alle tue foto in modo che qualsiasi algoritmo che scansiona quelle immagini in futuro ti veda completamente come una persona diversa. In sostanza, eseguire Fawkes sulle tue foto è come aggiungere una maschera invisibile ai tuoi selfie.

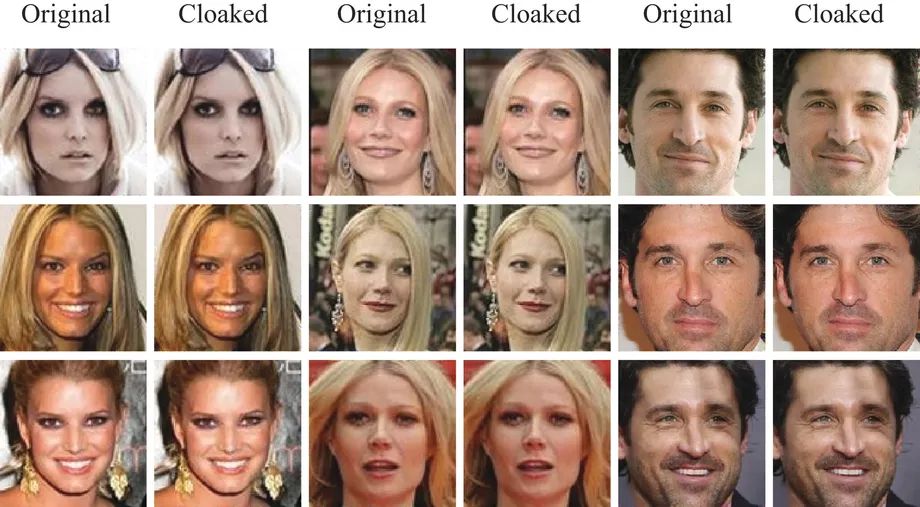

Gli scienziati chiamano questo processo “occultamento” ed è inteso a corrompere le risorse di cui i sistemi di riconoscimento facciale devono funzionare: database di volti raschiati dai social media. La società di riconoscimento facciale Clearview AI, ad esempio, afferma di aver raccolto circa tre miliardi di immagini di volti da siti come Facebook, YouTube e Venmo, che utilizza per identificare gli estranei. Ma se le foto che condividi online sono state esaminate da Fawkes, dicono i ricercatori, allora la faccia che gli algoritmi sanno non sarà in realtà la tua.

Secondo il team dell’Università di Chicago, Fawkes ha successo al 100% contro i servizi di riconoscimento facciale all’avanguardia di Microsoft (Azure Face), Amazon (Rekognition) e Face ++ del gigante tecnologico cinese Megvii.

“Quello che stiamo facendo è usare la foto mascherata in sostanza come un cavallo di Troia, per corrompere modelli non autorizzati per imparare la cosa sbagliata su ciò che ti fa sembrare te e non qualcun altro”, Ben Zhao, professore di informatica all’università di Chicago che ha contribuito a creare il software Fawkes, ha detto a The Verge . “Una volta che si verifica la corruzione, sei continuamente protetto, indipendentemente da dove vai o sei visto.”

La riconosceresti a malapena. Foto della regina Elisabetta II prima (a sinistra) e dopo (a destra) correndo attraverso il software di occultamento di Fawkes. Immagine: The Verge

Il gruppo dietro l’opera – Shawn Shan, Emily Wenger, Jiayun Zhang, Huiying Li, Haitao Zheng e Ben Y. Zhao – ha pubblicato un documento sull’algoritmo all’inizio di quest’anno . Ma alla fine del mese scorso hanno anche rilasciato Fawkes come software gratuito per Windows e Mac che chiunque può scaricare e utilizzare. Ad oggi dicono che è stato scaricato più di 100.000 volte.

Nei nostri test abbiamo scoperto che Fawkes ha un design scarso ma abbastanza facile da applicare. Ci vogliono un paio di minuti per elaborare ogni immagine e le modifiche apportate sono per lo più impercettibili. All’inizio di questa settimana, il New York Times ha pubblicato una storia su Fawkes in cui notava che l’effetto di occultamento era abbastanza ovvio, spesso apportando cambiamenti di genere alle immagini come dare baffi alle donne. Ma il team di Fawkes afferma che l’algoritmo aggiornato è molto più sottile e i test di The Verge concordano con questo.

QUANTA DIFFERENZA PUÒ FARE UNO STRUMENTO COME FAWKES?

Ma Fawkes è un proiettile d’argento per la privacy? È dubbio. Per cominciare, c’è il problema dell’adozione. Se leggi questo articolo e decidi di utilizzare Fawkes per nascondere le foto che caricherai sui social media in futuro, sarai sicuramente in minoranza. Il riconoscimento facciale è preoccupante perché è una tendenza a livello di società e quindi la soluzione deve essere anche a livello di società. Se solo gli esperti di tecnologia proteggono i loro selfie, crea disuguaglianza e discriminazione.

In secondo luogo, molte aziende che vendono algoritmi di riconoscimento facciale hanno creato i loro database di volti molto tempo fa e non è possibile recuperare retroattivamente tali informazioni. Il CEO di Clearview, Hoan Ton-That, lo ha detto al Times . “Ci sono miliardi di foto non modificate su Internet, tutte su nomi di dominio diversi”, ha detto Ton-That. “In pratica, è quasi certamente troppo tardi per perfezionare una tecnologia come Fawkes e implementarla su larga scala.”

Confronti di volti non coperti e mascherati con Fawkes. Immagine: SAND Lab, Università di Chicago

Naturalmente, tuttavia, la squadra dietro Fawkes non è d’accordo con questa valutazione. Notano che sebbene aziende come Clearview dichiarino di avere miliardi di foto, ciò non significa molto se si considera che dovrebbero identificare centinaia di milioni di utenti. “È probabile che, per molte persone, Clearview abbia solo un numero molto limitato di foto pubblicamente accessibili”, afferma Zhao. E se le persone pubblicheranno più foto ammantate in futuro, dice, prima o poi la quantità di immagini ammantate supererà quelle non nascoste.

Sul fronte dell’adozione, tuttavia, il team di Fawkes ammette che, affinché il loro software faccia la differenza, deve essere rilasciato in modo più ampio. Non hanno in programma di creare un’app Web o mobile a causa di problemi di sicurezza, ma sperano che aziende come Facebook possano integrare tecnologie simili nella propria piattaforma in futuro.

Integrare questa tecnologia sarebbe nell’interesse di queste aziende, afferma Zhao. Dopotutto, aziende come Facebook non vogliono che le persone smettano di condividere le foto e queste aziende sarebbero comunque in grado di raccogliere i dati di cui hanno bisogno dalle immagini (per funzionalità come il tag di foto) prima di mascherarli sul web pubblico. E mentre l’integrazione di questa tecnologia ora potrebbe avere solo un piccolo effetto per gli utenti attuali, potrebbe aiutare a convincere le generazioni future, attente alla privacy, a iscriversi a queste piattaforme.

“L’adozione da parte di piattaforme più grandi, ad esempio Facebook o altri, potrebbe col tempo avere un effetto paralizzante su Clearview rendendo sostanzialmente [la loro tecnologia] così inefficace da non essere più utile o finanziariamente redditizio come servizio”, afferma Zhao. “Clearview.ai fallire perché non è più pertinente o preciso è qualcosa di cui saremmo soddisfatti [come] come risultato del nostro lavoro.”