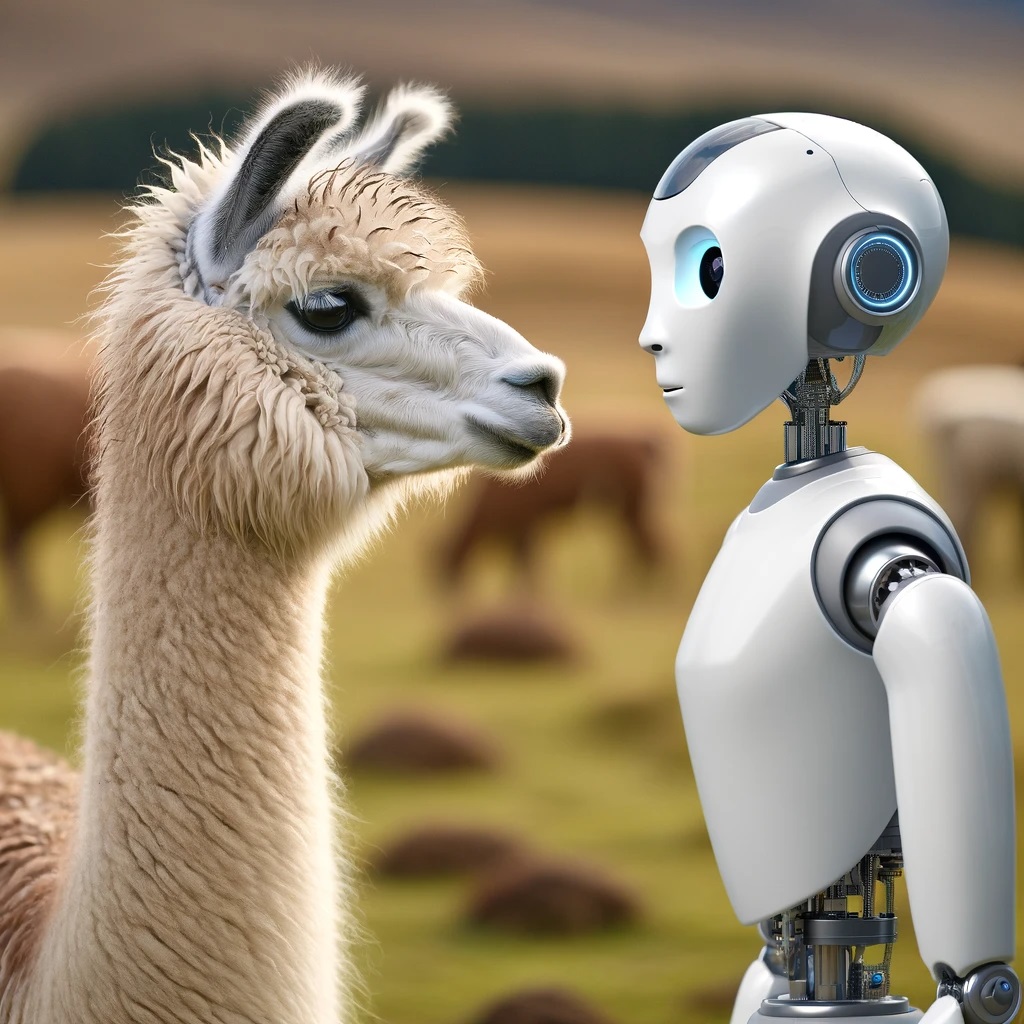

Potrebbe un membro del regno dei camelidi emergere come il protagonista dell’epopea dell’intelligenza artificiale del 2023? Il riferimento è al Llama di Meta, il gigante dei modelli linguistici che ha fatto breccia nel campo dell’IA a febbraio, seguito dall’evoluzione Llama 2 in luglio e dall’innovativo Code Llam a agosto. È lecito affermare che il dominio di Llama è assai concreto.

L’entusiasmo dei lettori è palpabile. “Come? Ma sicuramente ChatGPT è stato l’episodio più eclatante dell’IA nel 2023!” si potrebbe protestare. “ChatGPT di OpenAI, varato il 30 novembre 2022, che ha attratto 100 milioni di utenti in soli due mesi? ChatGPT, colui che ha introdotto l’intelligenza artificiale generativa nell’immaginario collettivo? Senza dubbio, quello è stato l’evento dell’anno!”

Indubbiamente, ChatGPT rappresenta un punto di non ritorno per l’intelligenza artificiale generativa. Come Rowan Curran di Forrester ha osservato, “è stata la scintilla che ha infiammato il dibattito sull’intelligenza artificiale generativa”.

Eppure, con l’arrivo di Llama di Meta a febbraio, il primo grande LLM “open source” gratuito (pur con alcune restrizioni rispetto alle tradizionali definizioni di open source), l’IA open source ha cominciato a guadagnare terreno, innescando un acceso dibattito che ha tenuto banco per tutto l’anno. Ciò nonostante le perplessità espresse da altri colossi tech, aziende di LLM e regolatori circa la sicurezza di modelli AI con codice e pesi accessibili liberamente e nonostante gli onerosi costi computazionali che hanno rappresentato una sfida per l’intero settore.

Meta sostiene che dalla pubblicazione di Llama, la comunità AI open source ha sviluppato e distribuito più di 7.000 varianti sulla piattaforma Hugging Face, dando vita a una vera e propria menagerie digitale che include Koala, Vicuna, Alpaca, Dolly e RedPajama. Molti altri modelli open source sono disponibili, come Mistral, Hugging Face e Falcon, ma Llama ha segnato un punto di svolta grazie al supporto di una potenza tecnologica quale Meta.

Si potrebbe paragonare ChatGPT al blockbuster Barbie del 2023, mentre Llama e il suo esercito di IA open source sembrano l’Universo Marvel, con i suoi innumerevoli spin-off che collettivamente potrebbero definire il futuro dell’IA.

“Questo darà origine ad applicazioni GenAI più concrete e impattanti, e a un consolidamento dell’infrastruttura open source per le applicazioni GenAI nel futuro,” mi ha confidato Kjell Carlsson di Domino Data Lab.

L’impatto a lungo termine sarà quindi guidato dall’intelligenza artificiale open source. L’era dei modelli esclusivi e proprietari si potrebbe dire sia cominciata con ChatGPT. OpenAI si è lanciata nel 2015 con una filosofia più open source e trasparente. Tuttavia, nel 2023, Ilya Sutskever, cofondatore e capo scienziato di OpenAI, ha ammesso a The Verge che condividere la loro ricerca è stato un errore, citando preoccupazioni per la concorrenza e la sicurezza.

Yann LeCun di Meta, invece, ha sostenuto la distribuzione di Llama 2 sotto licenza commerciale insieme ai pesi del modello. “Ho difeso questa scelta internamente,” ha rivelato durante la conferenza AI Native di settembre. “Ritengo fosse inevitabile, considerando che i grandi modelli linguistici diventeranno una risorsa infrastrutturale di base per tutti, e quindi deve essere aperta.”

Carlsson però avverte che confrontare ChatGPT e Llama è come paragonare mele e arance. Llama 2 è il vero cambiamento di gioco, perché è stato progettato per funzionare con meno dati e potenza computazionale rispetto a modelli precedenti, rendendolo più accessibile a più sviluppatori.

Con l’attuale corsa all’IA generativa, non c’è modo di prevedere quale delle due filosofie prevarrà. “In questo momento, è ancora tutto aperto,” ha concluso Carlsson. “Ma una cosa è certa: il futuro dell’IA generativa è più eccitante e imprevedibile che mai.”

Durante un’intervista rilasciata a VentureBeat nei locali della Meta a New York, Joelle Pineau, che è a capo della ricerca in intelligenza artificiale presso l’azienda, ha evidenziato che il suo ingresso in Meta nel 2017 è stato motivato dall’approccio di FAIR all’apertura e alla trasparenza nella ricerca. “L’impegno nella scienza aperta è stato il motivo principale della mia decisione; molti dei nostri ricercatori condividono questo stesso sentimento. Questo principio è insito nell’essenza stessa dell’organizzazione,” ha spiegato.

Pineau ha però sottolineato che le ragioni dietro la scelta di perseguire la ricerca aperta si sono evolute. “Se nel 2017 il fulcro era la qualità della ricerca e l’aspirazione a standard superiori, ora ci rendiamo conto dell’importanza che la ricerca aperta riveste nell’alimentare la produttività dell’ecosistema, spronando la creazione di start-up e offrendo loro un modello alternativo di sviluppo,” ha dichiarato Pineau.

Ciononostante, ha precisato che le pubblicazioni di Meta sono soggette a valutazioni caso per caso. “Non ci impegniamo a rendere tutto pubblico sempre e comunque; ogni rilascio è valutato attentamente per bilanciare benefici e rischi.”

Angela Fan, una ricercatrice di Meta FAIR che ha contribuito allo sviluppo del modello Llama originale e della sua seconda versione, ha discusso del loro impegno nell’integrare tali modelli nelle funzioni prodotto mostrate all’ultimo evento Connect, nonostante alcune di queste innovazioni abbiano scatenato controversie. “Nonostante la tecnologia sia ancora agli albori e presenti delle debolezze, siamo giunti a un punto tale da poter realizzare prodotti davvero innovativi e integrarli efficacemente nelle nostre applicazioni,” ha affermato Fan.

Fan ha inoltre menzionato il continuo interesse dell’azienda per i feedback sia dalla comunità degli sviluppatori sia dalle start-up che utilizzano Llama per molteplici applicazioni. “Siamo curiosi di sapere cosa pensa la gente di Llama 2 e cosa vorrebbero vedere in Llama 3,” ha detto.

La ricercatrice ha evidenziato che il segreto di Llama risiede in “una serie di piccoli dettagli eseguiti alla perfezione e per un periodo di tempo prolungato”, citando come esempi la selezione del dataset originale adeguato, la determinazione del numero di parametri e l’ottimizzazione del tasso di apprendimento durante il pre-addestramento.

Vipul Ved Prakash, co-fondatore di Together, ha lodato l’ecosistema open source e l’ampio utilizzo della tecnologia come “la nostra visione di lungo termine”, riferendosi anche alla creazione del dataset RedPajama, che emula il set di dati di Llama, e al lancio di una piattaforma e servizio cloud full-stack per sviluppatori di start-up e imprese per la creazione di IA open source.

Questo impegno nell’open source è visto da Prakash come un punto di svolta per il 2023, che non solo distribuisce i costi attraverso la rete, ma consente anche a più attori di offrire tuning e inferenza senza dover sopportare interamente i costi di sviluppo dei modelli.

Nel frattempo, al Summit sulla sicurezza nel Regno Unito, la comunità dell’IA open source si è trovata a difendere l’accessibilità dei Large Language Models (LLM) contro i timori regolatori che tali tecnologie potrebbero essere sfruttate da agenti malevoli. In risposta, personalità di spicco come LeCun e Andrew Ng hanno firmato una dichiarazione, pubblicata da Mozilla, che promuove l’IA open source come soluzione, non come minaccia.

Il dibattito tra Llama e ChatGPT, così come tra open e closed source, rimane aperto. Interrogati sul punto, alcuni esperti hanno indicato ChatGPT come il vincitore per il suo impatto immediato e la facilità d’uso, mentre altri hanno sottolineato la potenziale resilienza a lungo termine e l’agilità di Llama grazie alla sua natura open source.