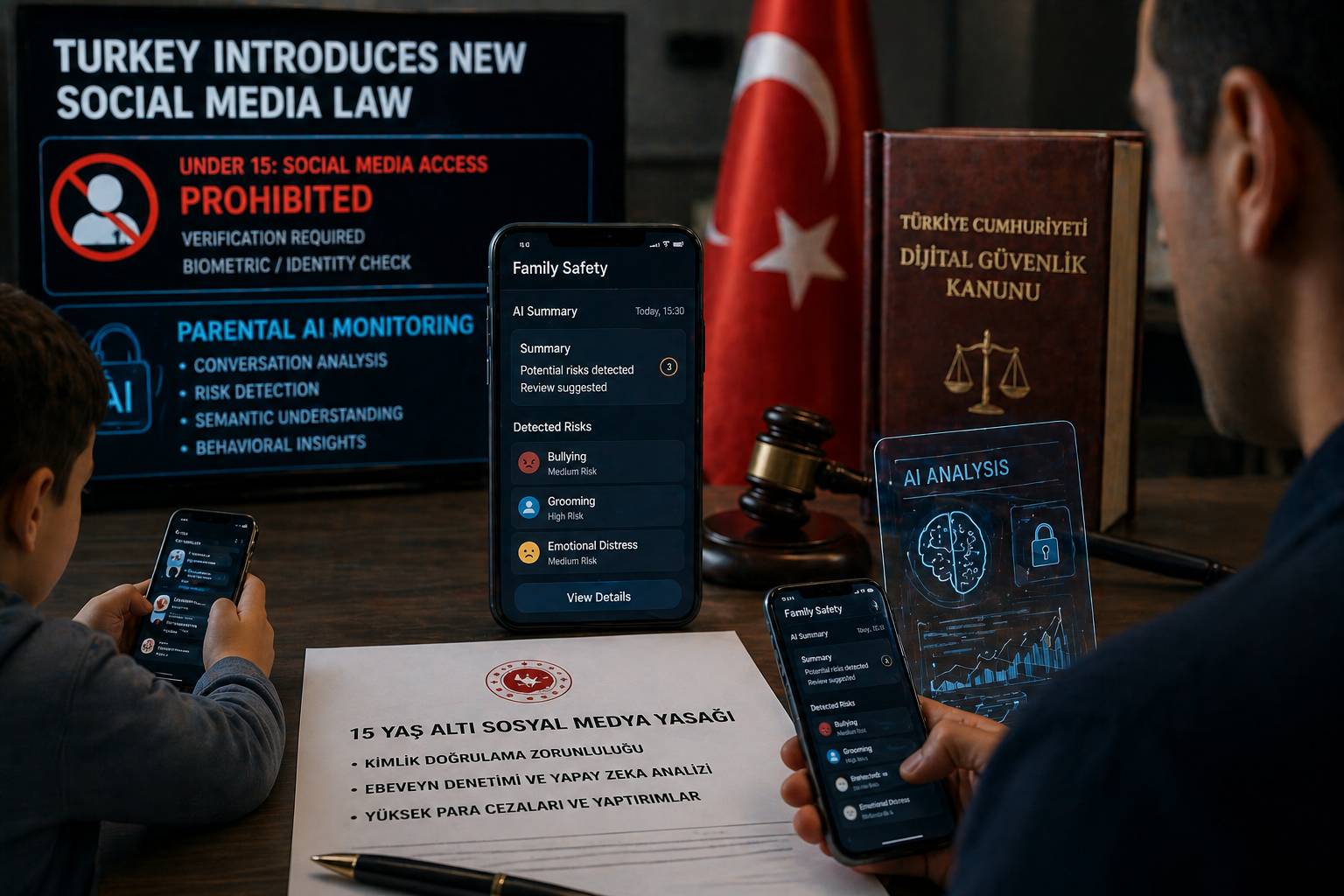

La Turchia ha portato all’introduzione di un pacchetto di leggi volto a ridefinire il rapporto tra minori e piattaforme di comunicazione digitale. La misura più drastica riguarda l’imposizione di un divieto assoluto di accesso ai social network per tutti i soggetti che non abbiano ancora compiuto i quindici anni di età. Questa decisione si inserisce in un quadro di preoccupazione nazionale riguardante la sicurezza informatica, la salute mentale e l’esposizione precoce a contenuti non filtrati. Per rendere operativo tale divieto, il governo ha stabilito protocolli di verifica dell’identità estremamente rigorosi, obbligando le aziende tecnologiche a implementare sistemi di autenticazione biometrica o basati su documenti d’identità statali, rendendo di fatto inefficaci i precedenti metodi di dichiarazione dell’età facilmente aggirabili dagli utenti più giovani.

Dopo questa restrizione demografica, il dibattito si è spostato sulle modalità di monitoraggio per la fascia d’età immediatamente superiore, coinvolgendo direttamente colossi come Meta nell’implementazione di nuovi strumenti di supervisione. La novità tecnicamente più rilevante e controversa riguarda lo sviluppo di sistemi di intelligenza artificiale progettati per analizzare i flussi di conversazione privata dei figli per conto dei genitori. A differenza dei software di monitoraggio tradizionali, che si limitavano a bloccare parole chiave o tracciare la posizione geografica, questi nuovi algoritmi basati su modelli linguistici avanzati sono in grado di interpretare il contesto semantico e il tono emotivo delle chat. L’intelligenza artificiale non si limita a riportare ciò che viene scritto, ma elabora dei riassunti periodici per i genitori, segnalando potenziali rischi legati al bullismo, all’adescamento o a disturbi comportamentali, pur mantenendo, secondo le aziende, un certo grado di protezione della lettera del messaggio originale.

Questa architettura di controllo solleva questioni tecnologiche e legali di enorme complessità, specialmente per quanto riguarda la crittografia end-to-end. Per permettere a un’intelligenza artificiale di “leggere” e sintetizzare il contenuto delle conversazioni su piattaforme come WhatsApp o Instagram, è necessario che l’analisi avvenga a livello del dispositivo o che vi sia un accesso autorizzato ai metadati e ai testi decriptati. L’integrazione di questi strumenti nel framework legislativo turco impone a Meta e ad altre multinazionali una sfida tecnica senza precedenti: bilanciare la promessa di privacy assoluta fatta agli utenti con l’obbligo di fornire ai tutori legali gli strumenti analitici richiesti dalle nuove normative. Il sistema di IA deve quindi operare in un ambiente ibrido, dove il monitoraggio parentale diventa una funzione di sicurezza integrata nel sistema operativo della stessa applicazione social.

L’impatto di tali misure si estende anche alla responsabilità dei fornitori di servizi, che ora devono rispondere direttamente della presenza di account non autorizzati sulle proprie reti. Le sanzioni previste per la mancata osservanza del limite dei quindici anni sono severe e possono includere limitazioni della banda o multe miliardarie, spingendo le piattaforme verso un’automazione sempre più spinta dei processi di espulsione degli utenti minorenni. Mentre il governo difende la legge come un atto necessario di sovranità digitale e protezione dell’infanzia, l’implementazione tecnica di questi filtri basati sull’IA rappresenta un precedente globale nel monitoraggio delle comunicazioni private, segnando il passaggio da una vigilanza umana e sporadica a una sorveglianza algoritmica costante e automatizzata della vita digitale delle nuove generazioni.