La diffusione degli agenti basati su modelli linguistici ha portato alla luce una delle principali criticità operative delle architetture AI moderne: la gestione del contesto. Man mano che le conversazioni e le interazioni si estendono nel tempo, il numero di token necessari per mantenere coerenza cresce rapidamente, generando un aumento dei costi computazionali e una perdita progressiva di efficacia nel ragionamento. In questo scenario si inserisce xMemory, una tecnica di gestione della memoria progettata per ridurre il cosiddetto “context bloat” e migliorare l’efficienza degli agenti AI.

Il problema nasce dal modo in cui gli agenti tradizionali trattano la memoria. La maggior parte dei sistemi si basa su approcci di retrieval come il Retrieval-Augmented Generation, che recupera frammenti di informazioni da archivi esterni o dalla cronologia delle conversazioni. Tuttavia, questo metodo tende a introdurre ridondanze, contesto non rilevante e dipendenze temporali difficili da gestire, aumentando il numero di token inviati al modello a ogni richiesta. Ogni elemento incluso nel contesto comporta infatti un costo e un impatto sulla capacità di ragionamento, rendendo necessario un equilibrio tra completezza e sintesi.

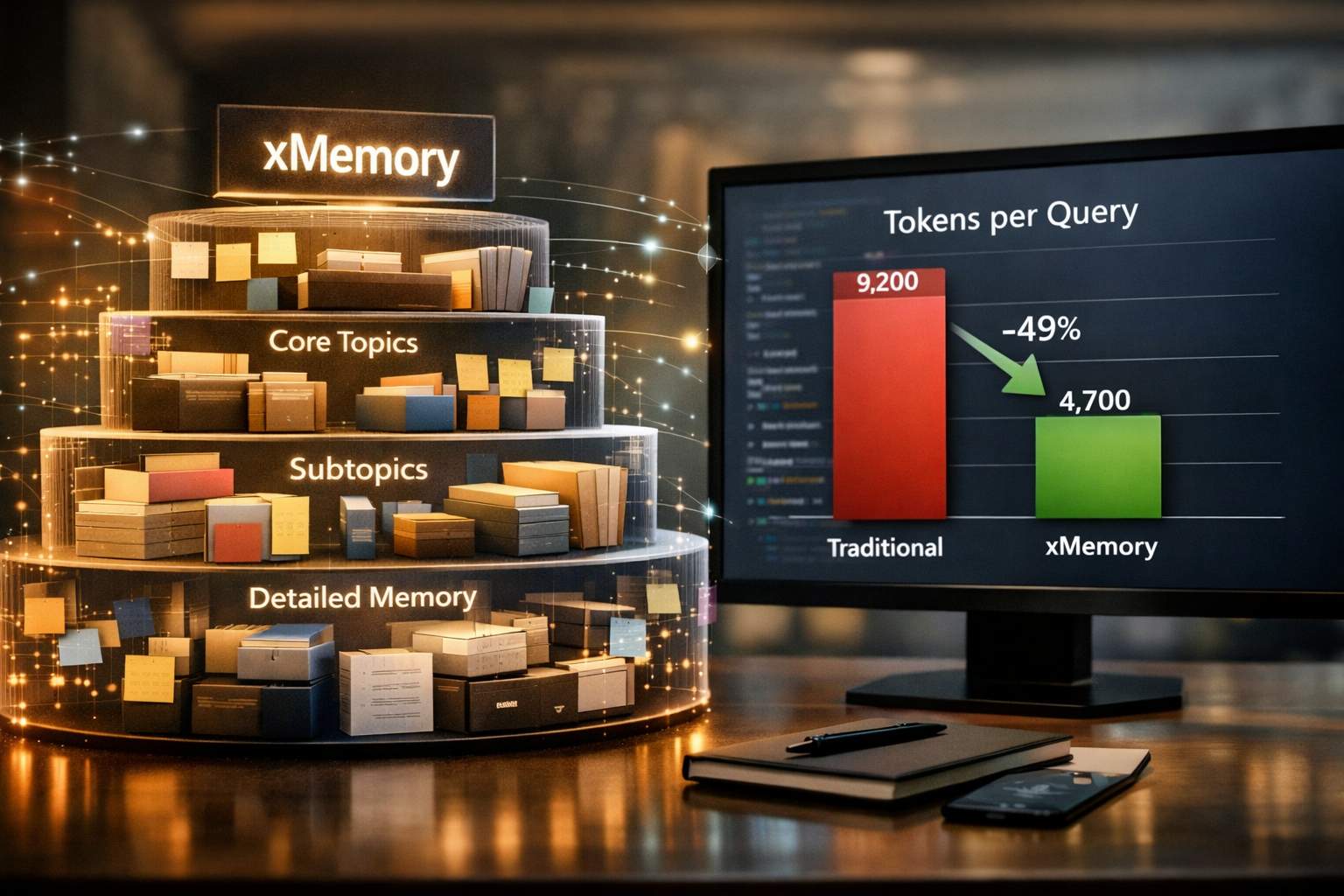

xMemory affronta questo problema introducendo un modello di memoria gerarchico basato su temi semantici. Invece di trattare la cronologia come una sequenza piatta o come un semplice database vettoriale, il sistema organizza le informazioni in una struttura multilivello, che consente un recupero “top-down” mirato. Questo significa che l’agente seleziona prima i concetti rilevanti e solo successivamente espande i dettagli necessari, evitando di caricare l’intera cronologia.

La ricerca descritta nell’analisi mostra che questo approccio ha un impatto diretto sull’efficienza operativa. In alcuni test, xMemory riduce l’utilizzo di token da oltre 9.000 a circa 4.700 per query, quasi dimezzando il consumo rispetto ai sistemi tradizionali. Questa riduzione non riguarda solo il costo, ma anche la qualità delle risposte e la capacità di mantenere coerenza su conversazioni lunghe o multi-sessione.

xMemory ridefinisce il concetto di unità di recupero. Invece di recuperare singoli messaggi o documenti, il sistema scompone le conversazioni in componenti semantiche correlate, aggregandole in temi e sottotemi. Questo processo permette di evitare duplicazioni e di preservare relazioni temporali importanti per il ragionamento. La memoria non viene compressa in modo aggressivo, ma riorganizzata in una struttura che consente di recuperare solo le informazioni indispensabili per la richiesta corrente.

Un altro aspetto rilevante è il miglioramento del ragionamento a lungo termine. Nei sistemi tradizionali, l’aumento del contesto porta spesso a una degradazione delle prestazioni, perché il modello deve elaborare informazioni irrilevanti o contraddittorie. La gerarchia semantica di xMemory riduce questo rumore, mantenendo un contesto compatto e coerente. Questo si traduce in risposte più accurate e in una maggiore stabilità nelle applicazioni enterprise, come assistenti personalizzati o strumenti di supporto decisionale che operano su sessioni multiple.

L’impatto economico è particolarmente significativo. Poiché i costi degli agenti AI sono fortemente legati al numero di token processati, ridurre il contesto significa abbassare direttamente le spese di inferenza. In ambienti produttivi, dove gli agenti possono eseguire migliaia di richieste al giorno, anche una riduzione del 40-50% dei token comporta un risparmio sostanziale e una maggiore prevedibilità dei costi operativi.