Il 1° febbraio 2025 segna una data storica per l’Unione Europea con l’entrata in vigore delle prime restrizioni operative dell’AI Act, la pionieristica legge europea volta a regolamentare l’uso dell’intelligenza artificiale (IA). Sebbene la normativa sia stata ufficialmente adottata il 1° agosto 2024, è solo ora che alcune delle sue disposizioni più stringenti diventano effettive, mirando a prevenire utilizzi dell’IA considerati “inaccettabili” e a garantire un equilibrio tra innovazione tecnologica e tutela dei diritti fondamentali dei cittadini.

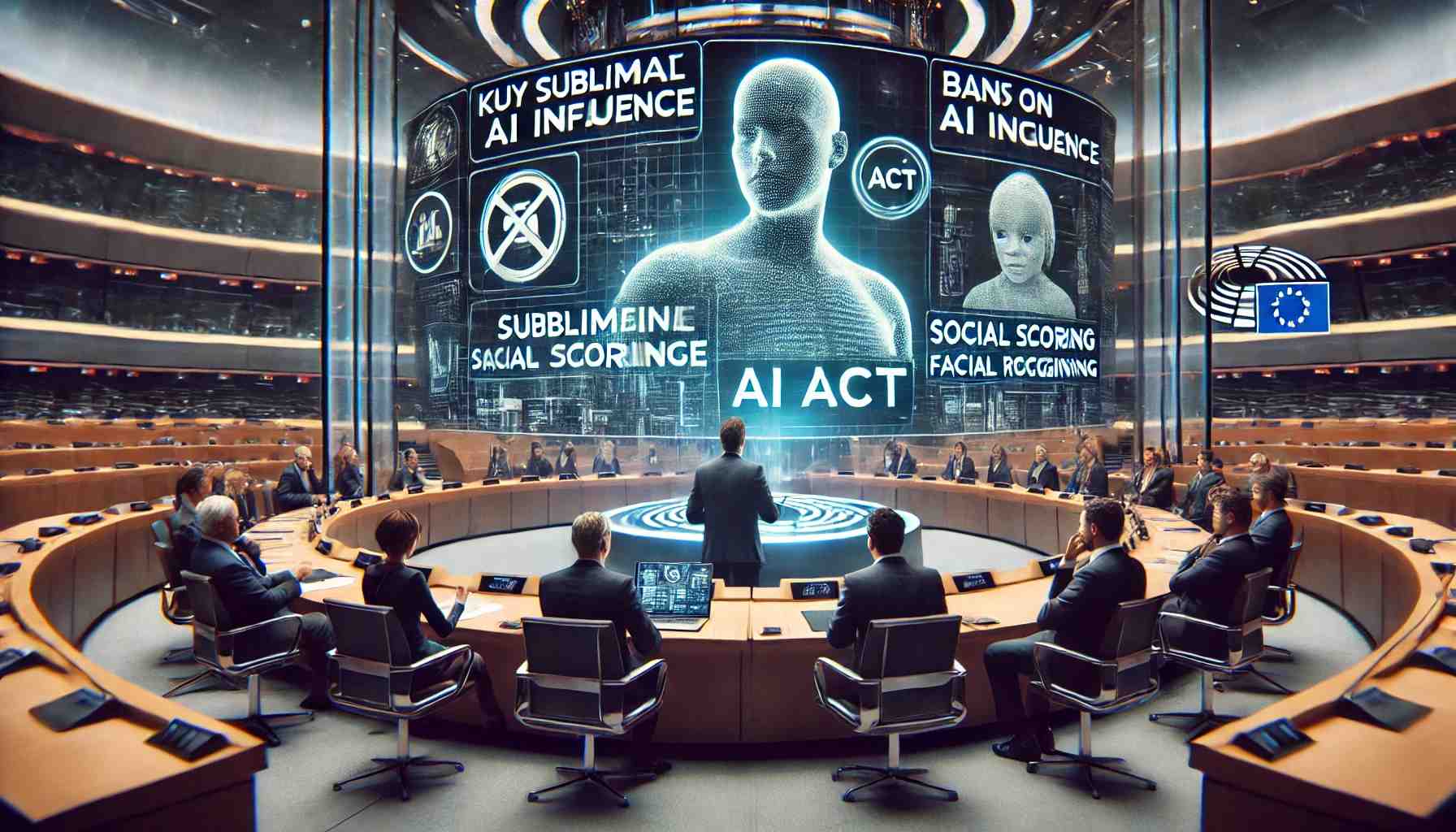

Tra le misure più significative introdotte dall’AI Act vi è il divieto di sistemi di IA progettati per influenzare il comportamento umano in modo subliminale, ovvero senza che gli individui ne siano consapevoli. Questo include tecnologie che potrebbero manipolare decisioni o azioni delle persone senza il loro esplicito consenso o conoscenza.

Un altro aspetto cruciale riguarda il cosiddetto “punteggio sociale”. L’AI Act vieta espressamente qualsiasi sistema che classifichi i cittadini in base al loro comportamento o alle loro opinioni, prevenendo così pratiche discriminatorie o lesive della dignità individuale.

Inoltre, l’utilizzo dell’IA per prevedere la probabilità che una persona commetta un reato, basandosi su tratti della personalità o dati biometrici anziché su prove concrete, è ora proibito. Questo per evitare pregiudizi e discriminazioni basate su analisi algoritmiche non supportate da evidenze fattuali.

L’AI Act impone restrizioni rigorose sull’uso del riconoscimento facciale. È vietata la creazione di database attraverso la raccolta di immagini dai social media o dalle telecamere di sicurezza senza consenso. Inoltre, non è consentito l’uso di software che analizzano le espressioni facciali per interpretare le emozioni delle persone in contesti come scuole o luoghi di lavoro.

L’identificazione di individui in tempo reale in spazi pubblici per scopi di polizia è anch’essa vietata, salvo in circostanze eccezionali come la ricerca di persone scomparse o la prevenzione di atti terroristici. Queste misure cercano di bilanciare la necessità di sicurezza pubblica con la protezione della privacy individuale.

Guardando al futuro, entro il 2 agosto 2025, le aziende dovranno mantenere un registro dettagliato dei test e dello sviluppo dei loro sistemi di IA, seguendo protocolli di sicurezza specifici. Il mancato rispetto di queste normative potrà comportare sanzioni fino al 7% del fatturato dell’azienda. Gli Stati membri dell’UE sono inoltre tenuti a istituire autorità di supervisione incaricate di monitorare e garantire la conformità alle nuove regole.

L’introduzione dell’AI Act ha suscitato reazioni contrastanti. I sostenitori elogiano l’approccio proattivo dell’UE nel prevenire potenziali abusi dell’IA, considerandolo un modello lungimirante per la regolamentazione tecnologica globale. Tuttavia, i critici temono che tali restrizioni possano rallentare l’innovazione, soprattutto in un contesto in cui altre potenze mondiali come gli Stati Uniti e la Cina avanzano rapidamente nel settore dell’intelligenza artificiale.