Alibaba ha presentato ufficialmente la nuova serie di modelli di intelligenza artificiale Qwen 3.5 Medium, rafforzando la propria strategia verso un’intelligenza artificiale più efficiente dal punto di vista strutturale e computazionale. Con questo rilascio open source, Alibaba si allontana dall’approccio puramente basato sull’espansione massiva dei parametri per inseguire modelli di frontiera, concentrandosi invece su innovazioni architetturali, qualità dei dati e tecniche avanzate di apprendimento per rinforzo.

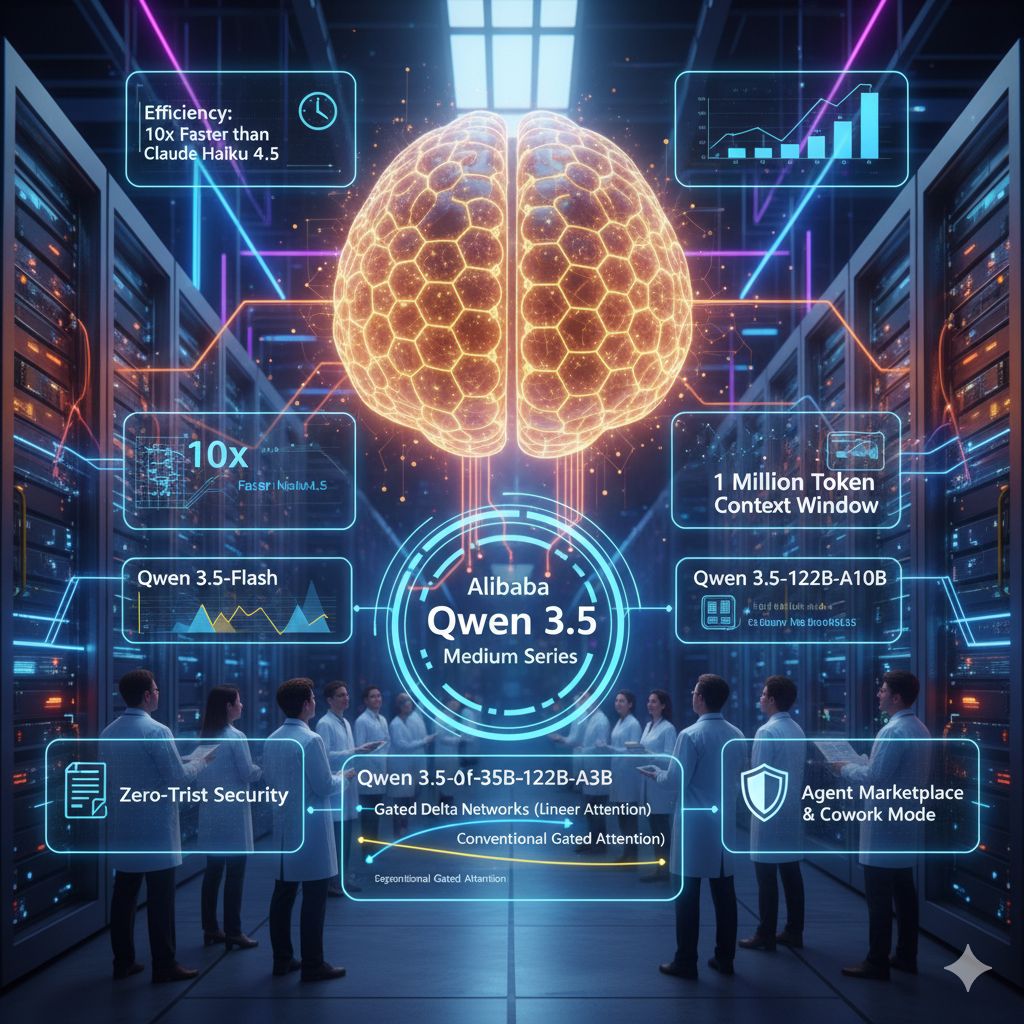

La serie Qwen 3.5 Medium comprende diverse varianti: Qwen 3.5-Flash, Qwen 3.5-35B-A3B, Qwen 3.5-122B-A10B e Qwen 3.5-27B. Si tratta di una declinazione più compatta rispetto al modello di punta della famiglia Qwen 3.5 lanciato in precedenza, ma progettata per offrire un rapporto significativamente migliore tra prestazioni e risorse utilizzate. Il modello più rappresentativo è Qwen 3.5-35B-A3B, basato su un’architettura Mixed-of-Experts (MoE) con 35 miliardi di parametri totali, dei quali solo circa 3 miliardi vengono effettivamente attivati durante l’inferenza.

Questo meccanismo di attivazione selettiva consente di ottenere un comportamento comparabile a modelli molto più grandi in termini di accuratezza e ragionamento, ma con un consumo computazionale drasticamente inferiore. In confronto ai precedenti modelli della stessa famiglia, come Qwen3-235B-A22B-2507 e la variante multimodale Qwen3-VL-235B-A22B, che attivavano 22 miliardi di parametri per richiesta, il nuovo 35B-A3B dimostra che è possibile raggiungere o superare tali prestazioni con un numero di parametri attivi sensibilmente ridotto. Non si tratta semplicemente di comprimere un modello più grande, ma di riprogettarne la dinamica interna in modo da concentrare il calcolo sulle porzioni più rilevanti della rete neurale.

La chiave di questa efficienza risiede in una struttura che combina due diversi meccanismi di attenzione. Da un lato, viene introdotta una nuova forma di attenzione lineare denominata Gated Delta Networks, progettata per ridurre la complessità computazionale e l’uso di memoria rispetto all’attenzione quadratica tradizionale. Dall’altro lato, viene mantenuta un’attenzione a gate più convenzionale, che contribuisce alla stabilità e alla qualità del ragionamento su sequenze complesse. L’integrazione di questi due approcci consente di aumentare la velocità di elaborazione e ridurre l’impronta in memoria, rendendo possibile l’esecuzione di modelli ad alte prestazioni anche su hardware non specializzato o in ambienti infrastrutturali meno costosi rispetto ai cluster GPU di fascia più alta.

Questa scelta architetturale si inserisce in un contesto di crescente attenzione verso la sostenibilità economica e operativa dei sistemi di intelligenza artificiale. L’efficienza non viene ottenuta sacrificando la profondità del ragionamento, ma attraverso un design che permette una “inferenza più densa” con le stesse risorse, ovvero una maggiore capacità di elaborazione semantica per unità di calcolo.

La variante Qwen 3.5-Flash rappresenta l’adattamento commerciale del modello 35B-A3B, ottimizzata per ambienti di lavoro agentici dove la latenza di risposta è un fattore critico. In scenari in cui un agente deve pianificare, eseguire e verificare più fasi operative in modo autonomo, la velocità di risposta diventa determinante per l’esperienza utente e per l’integrazione in pipeline aziendali. Qwen 3.5-Flash è progettato per fornire tempi di risposta rapidi pur mantenendo capacità di pianificazione multi-step.

Uno degli elementi tecnici più rilevanti di questa serie è la finestra di contesto predefinita di un milione di token. Una capacità di questo tipo riduce in modo significativo la dipendenza da pipeline complesse di Retrieval-Augmented Generation durante l’elaborazione di documenti molto lunghi o basi di codice estese. In pratica, il modello può mantenere coerenza su volumi di testo estremamente ampi senza dover continuamente recuperare frammenti esterni, migliorando stabilità e fluidità del ragionamento. Inoltre, il supporto ufficiale a strumenti integrati e chiamate di funzione permette l’integrazione diretta con API e database, rendendo il modello particolarmente adatto a sistemi di automazione e workflow reali.

Le varianti Qwen 3.5-122B-A10B e Qwen 3.5-27B si focalizzano anch’esse su compiti agentici che richiedono pianificazione e ragionamento articolato. Il modello 122B-A10B, pur disponendo di 122 miliardi di parametri totali, ne attiva soltanto 10 miliardi durante l’inferenza, mantenendo coerenza logica e stabilità nelle attività di lunga durata. Questa capacità è particolarmente importante per scenari in cui un agente deve mantenere uno stato interno coerente nel tempo, come l’analisi di progetti complessi o la gestione di flussi decisionali multi-step.

Sul piano dell’addestramento, Alibaba ha dichiarato di aver adottato un processo di post-training articolato in quattro fasi, che include un “avvio a freddo della catena di pensiero” finalizzato ad allenare processi di ragionamento prolungati. L’uso della catena di pensiero come tecnica esplicita consente di migliorare la qualità del reasoning intermedio, rendendo il modello più robusto nella risoluzione di problemi complessi. A questo si affianca un processo di apprendimento per rinforzo, volto a perfezionare ulteriormente le capacità logiche e decisionali. L’RL non è impiegato solo per ottimizzare risposte finali, ma per modellare la traiettoria del ragionamento, favorendo soluzioni coerenti e verificabili.

Il risultato complessivo è una serie di modelli che, pur attivando una frazione relativamente ridotta dei parametri disponibili, riescono a raggiungere prestazioni prossime a quelle di modelli densi su larga scala. L’innovazione non consiste quindi nell’aumentare indiscriminatamente la dimensione della rete neurale, ma nel progettare un’architettura che massimizzi l’efficienza del calcolo e la qualità del ragionamento.