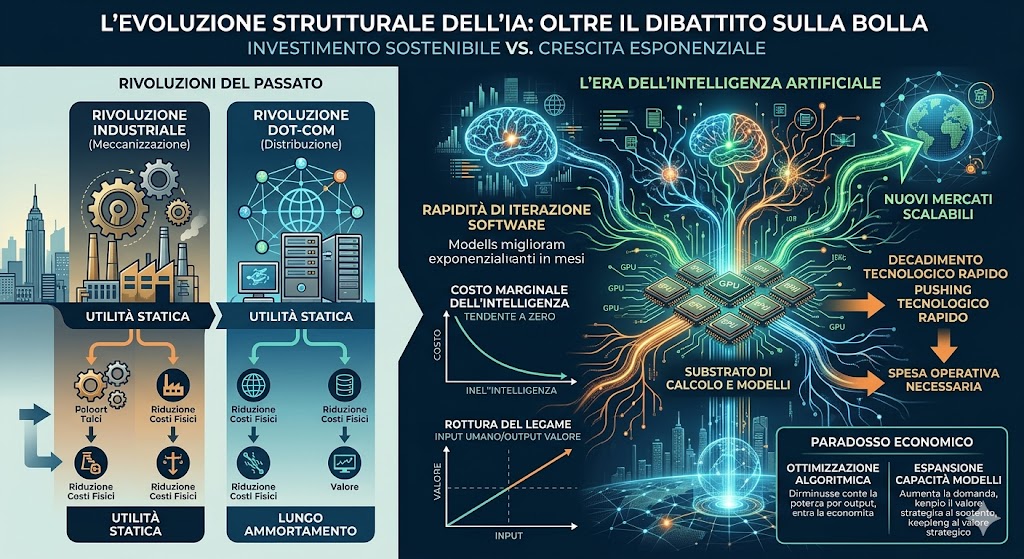

Il dibattito contemporaneo sulla sostenibilità degli investimenti nel settore dell’intelligenza artificiale si trova spesso intrappolato in un confronto tra chi intravede una bolla speculativa imminente e chi sostiene una crescita illimitata. Tuttavia, un’analisi tecnica e strutturale suggerisce che l’attuale evoluzione della tecnologia superi i confini delle analogie storiche tradizionali, come quelle riferite alla bolla delle dot-com o alla rivoluzione industriale. Mentre le precedenti ondate tecnologiche si sono concentrate sulla riduzione dei costi di distribuzione o di produzione fisica, l’intelligenza artificiale agisce direttamente sul costo marginale della generazione di intelligenza e di ragionamento, un fattore che non ha precedenti storici diretti e che rende i cicli di adozione e di ammortamento del capitale estremamente diversi dal passato.

Uno degli errori metodologici più comuni nell’applicare il “pensiero a bolla” all’IA risiede nella sottovalutazione della velocità di iterazione del software rispetto all’hardware. Nelle infrastrutture ferroviarie o nelle reti in fibra ottica degli anni Novanta, il capitale veniva immobilizzato in beni fisici la cui utilità rimaneva statica per decenni. Al contrario, l’investimento odierno in unità di elaborazione grafica e data center non è finalizzato a un prodotto immutabile, ma serve come substrato per modelli che migliorano le proprie capacità in modo esponenziale in archi temporali di pochi mesi. Questa dinamica crea una pressione competitiva che costringe le aziende a mantenere livelli di spesa elevatissimi non per speculazione, ma per necessità operativa, poiché il decadimento tecnologico di un modello obsoleto avviene con una rapidità mai vista prima nella storia dell’informatica.

Dal punto di vista della produttività, l’intelligenza artificiale rompe il legame tradizionale tra input umano e output di valore. Nelle rivoluzioni precedenti, l’automazione sostituiva compiti meccanici, ma il processo decisionale rimaneva una prerogativa umana costosa e non scalabile. I modelli linguistici di grandi dimensioni stanno invece dimostrando che il “ragionamento” può essere trasformato in una commodity. Quando il costo di una decisione logica o della sintesi di informazioni complesse tende allo zero, le metriche classiche per calcolare il ritorno sull’investimento (ROI) falliscono, perché non tengono conto della creazione di nuovi mercati che prima erano tecnicamente impossibili o economicamente inviabili. Non si tratta solo di rendere più efficienti i processi esistenti, ma di abilitare una scala di operazioni che l’intelletto umano, da solo, non potrebbe gestire.

Un ulteriore elemento di rottura riguarda la struttura stessa dei costi dei Large Language Models. A differenza del software tradizionale (SaaS), dove il costo marginale per servire un nuovo utente è quasi nullo, l’IA richiede una potenza di calcolo continua per ogni singola inferenza. Questo ha portato molti analisti a ipotizzare un collasso dei margini di profitto. Tuttavia, questa visione non considera l’ottimizzazione algoritmica che sta riducendo drasticamente il fabbisogno energetico per unità di output. La capacità dell’industria di migliorare l’efficienza dei modelli mentre contemporaneamente ne espande le capacità crea un paradosso economico in cui, nonostante l’aumento massiccio dell’offerta di “intelligenza artificiale”, la domanda continua a crescere più velocemente, mantenendo alto il valore strategico dell’infrastruttura sottostante.