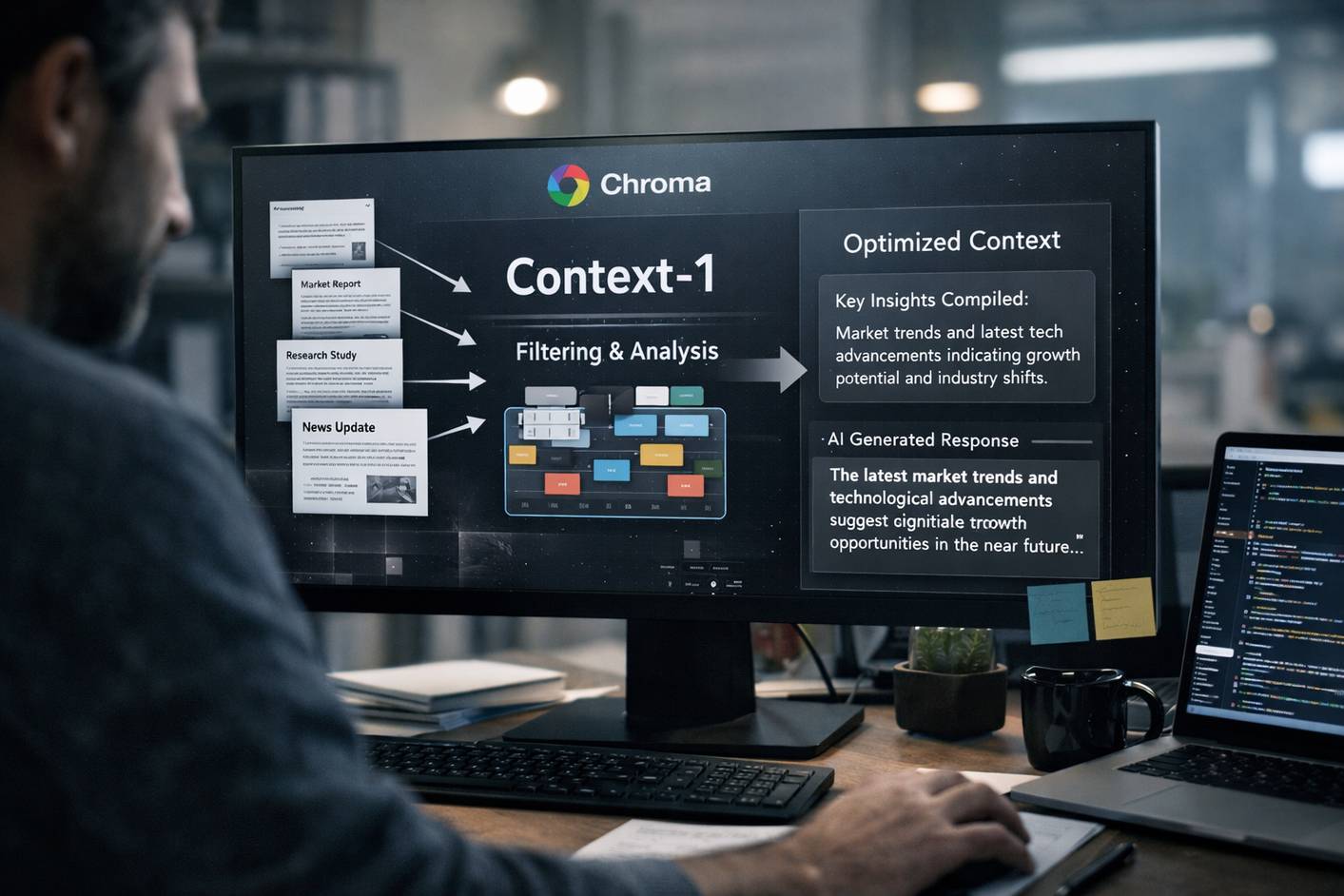

I sistemi di ricerca basati su modelli linguistici hanno un limite strutturale: le pipeline tradizionali non sono progettate per gestire query complesse che richiedono l’integrazione di molte fonti e la selezione di informazioni realmente rilevanti. C’è un nuovo agente di ricerca denominato Context-1, sviluppato da Chroma, che punta a risolvere questo problema attraverso una selezione mirata del contesto prima dell’elaborazione da parte del modello linguistico.

Secondo il report, l’approccio nasce dalla constatazione che le query moderne non sono più semplici interrogazioni, ma richieste composte che richiedono ragionamento multi-step, integrazione di fonti e filtraggio semantico. I sistemi di ricerca basati su LLM tendono infatti a recuperare grandi quantità di documenti, ma spesso non distinguono tra informazioni realmente utili e contenuti marginali. Questo produce un aumento dei costi computazionali e una riduzione della precisione nelle risposte.

Context-1 introduce un’architettura agent-based che separa la fase di recupero delle informazioni da quella di selezione del contesto. Invece di fornire al modello linguistico l’intero set di risultati, il sistema filtra dinamicamente solo i segmenti più rilevanti, costruendo un contesto sintetico ottimizzato per la generazione. L’obiettivo è ridurre la quantità di token inutili e migliorare la qualità del ragionamento del modello.

L’agente opera come un orchestratore che analizza la query, suddivide il problema in sotto-richieste e seleziona iterativamente le informazioni più pertinenti. Questo approccio consente di gestire interrogazioni complesse che richiedono più passaggi logici, superando i limiti delle pipeline retrieval-augmented tradizionali.

Uno degli obiettivi dichiarati del sistema è migliorare simultaneamente velocità e costo. Riducendo il contesto fornito al modello linguistico, diminuisce il numero di token elaborati e quindi il tempo di inferenza. Questa ottimizzazione è particolarmente importante per applicazioni enterprise, dove le query complesse possono generare costi elevati se il contesto non viene filtrato.

Il modello Context-1 si inserisce in una tendenza più ampia verso agenti di ricerca specializzati. Invece di utilizzare un singolo LLM per tutte le operazioni, l’architettura distribuisce il lavoro tra componenti dedicati al recupero, alla selezione e alla generazione. Questa separazione dei ruoli consente di migliorare l’efficienza e ridurre gli errori legati a contesti troppo ampi o incoerenti.

La selezione del contesto rappresenta uno degli aspetti più critici nelle applicazioni RAG. Se il contesto è troppo limitato, il modello manca informazioni essenziali; se è troppo ampio, aumenta il rumore e peggiora la qualità della risposta. Context-1 affronta questo problema introducendo un filtro dinamico che individua le parti più rilevanti dei documenti, creando un equilibrio tra completezza e precisione.

L’agente è progettato per affrontare query composte, in cui l’utente richiede informazioni che coinvolgono più dimensioni. In questi casi, il sistema analizza la richiesta, individua i sotto-temi e costruisce un contesto strutturato che il modello linguistico può utilizzare per il ragionamento. Questo approccio è particolarmente utile in ambiti come ricerca tecnica, analisi di mercato o interrogazioni scientifiche.

Context-1 rappresenta un passaggio verso sistemi di ricerca basati su orchestrazione. L’LLM non è più il componente principale, ma uno dei moduli della pipeline. L’agente di selezione del contesto diventa un elemento chiave per migliorare l’affidabilità delle risposte e ottimizzare l’uso delle risorse computazionali.