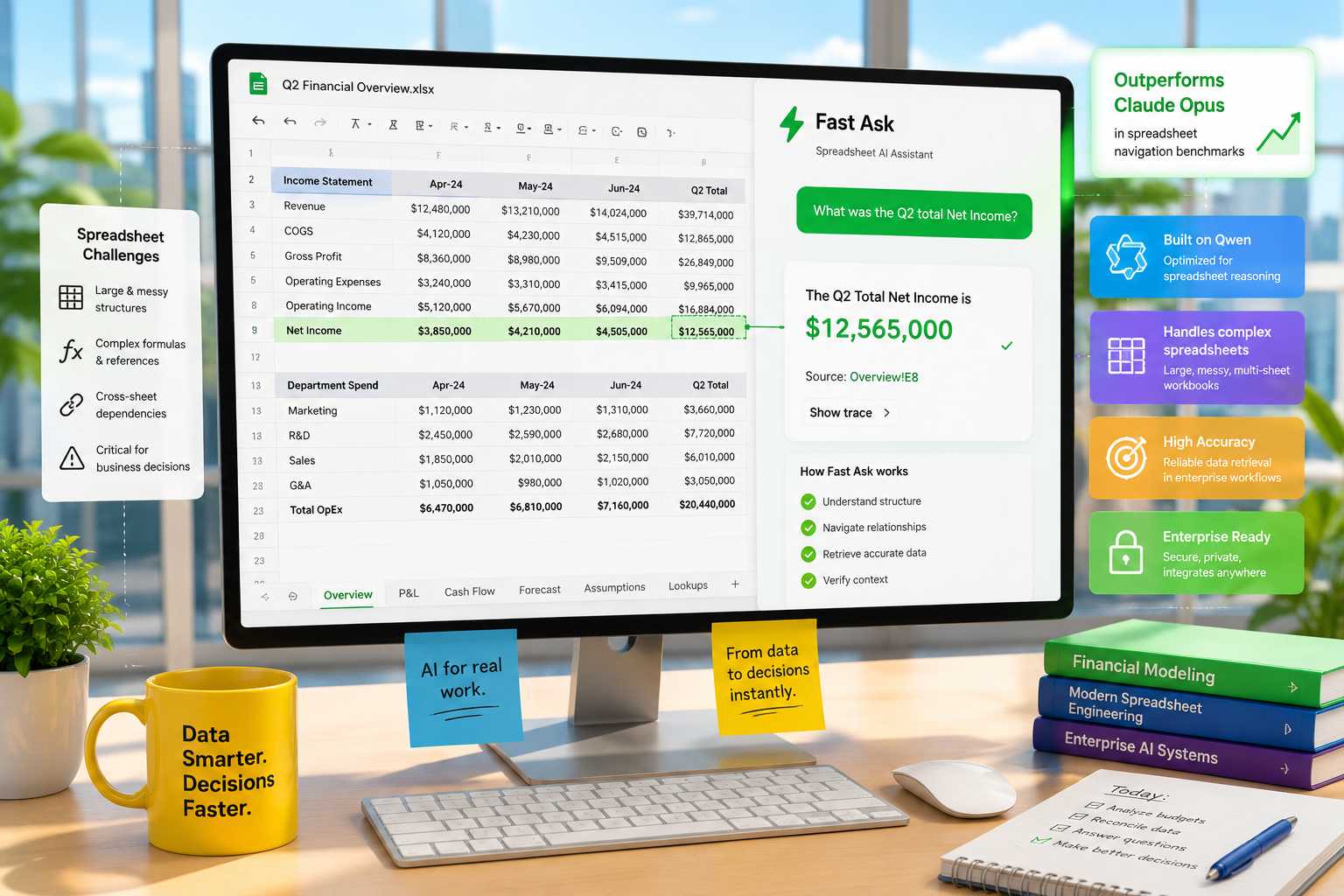

La gestione dei fogli di calcolo sta rapidamente diventando uno dei nuovi campi di competizione strategica dell’intelligenza artificiale enterprise. Dopo anni in cui i benchmark AI si sono concentrati soprattutto su coding, ragionamento matematico e conversazione generale, le aziende stanno iniziando a scoprire che uno dei problemi più complessi e costosi del lavoro operativo quotidiano riguarda in realtà la navigazione dei dati strutturati all’interno di spreadsheet enormi e disordinati. È precisamente questo il problema affrontato da Fast Ask, il nuovo modello sviluppato dalla fintech Ramp insieme alla piattaforma di infrastruttura AI Prime Intellect, progettato specificamente per comprendere, navigare e recuperare informazioni da fogli di calcolo complessi con prestazioni che superano persino Claude Opus in diversi scenari dedicati agli spreadsheet.

Il progetto nasce da un’esigenza estremamente concreta. Gran parte del lavoro amministrativo, finanziario e operativo nelle aziende moderne continua infatti a ruotare attorno ai fogli di calcolo. Nonostante l’enorme crescita dei database enterprise e delle piattaforme SaaS, spreadsheet Excel e Google Sheets restano il layer operativo reale di moltissimi processi aziendali: budgeting, riconciliazioni finanziarie, forecasting, procurement, auditing, reporting e gestione spese. Il problema è che i moderni LLM generalisti spesso faticano a orientarsi correttamente in tabelle molto grandi, con strutture irregolari, formule complesse, riferimenti incrociati e contesto distribuito su centinaia di colonne e migliaia di righe.

Fast Ask è stato sviluppato proprio per affrontare questo limite: il modello è costruito sopra la famiglia Qwen e ottimizzato specificamente per la navigazione semantica dei fogli di calcolo. Il punto chiave non è semplicemente la capacità di leggere dati tabellari, ma quella di comprendere relazioni operative interne allo spreadsheet e recuperare informazioni corrette anche in strutture altamente disorganizzate.

Dal punto di vista architetturale, questo rappresenta una differenza molto importante rispetto ai classici LLM conversazionali. I modelli linguistici generalisti sono ottimizzati soprattutto per testo sequenziale. Gli spreadsheet invece rappresentano un ambiente bidimensionale con forti dipendenze strutturali. Una singola informazione può dipendere contemporaneamente dalla posizione della cella, dalla colonna, dal foglio corrente, da formule dinamiche e da riferimenti distribuiti in altre sezioni del documento. Questo tipo di contesto è molto diverso dalla semplice elaborazione linguistica lineare.

Uno dei problemi principali degli LLM tradizionali applicati ai fogli di calcolo è infatti la perdita della struttura spaziale. Quando una tabella viene convertita in token testuali, gran parte delle relazioni implicite presenti nel layout originale tende a degradarsi. Fast Ask sembra essere stato progettato specificamente per preservare queste relazioni durante l’inferenza.

Il modello riesce a superare Claude Opus in benchmark dedicati alla navigazione spreadsheet e al recupero contestuale di dati. Questo elemento è particolarmente significativo perché Claude viene considerato uno dei modelli più efficaci nei workflow professionali documentali e nei task enterprise complessi. Superarlo in uno scenario operativo specifico suggerisce che il settore stia entrando in una nuova fase caratterizzata da modelli verticalizzati per workload aziendali altamente specializzati.

Il progetto Fast Ask evidenzia infatti una trasformazione più ampia dell’ecosistema AI enterprise. Per oltre due anni il mercato si è concentrato sulla costruzione di modelli generalisti sempre più grandi, capaci teoricamente di svolgere qualsiasi attività. Oggi però molte aziende stanno scoprendo che i workflow reali richiedono sistemi altamente ottimizzati per compiti specifici. In pratica, invece di cercare un unico modello universale, il mercato si sta orientando verso modelli specialistici progettati attorno a precise strutture dati operative.

Nel caso degli spreadsheet, la sfida non riguarda soltanto il recupero dell’informazione corretta, ma anche l’affidabilità operativa. Errori nei fogli di calcolo aziendali possono infatti produrre conseguenze economiche molto gravi. Una risposta errata generata da un LLM in un workflow finanziario può alterare report, previsioni o decisioni operative. Questo rende la precisione strutturale molto più importante rispetto alla semplice fluidità linguistica.

Ramp ha un interesse diretto molto forte in questo settore. La società opera infatti nel segmento fintech enterprise focalizzato su gestione spese, contabilità e automazione finanziaria. Gli spreadsheet rappresentano ancora oggi una parte enorme del lavoro amministrativo reale dei clienti enterprise. Costruire un modello AI specializzato nella loro comprensione significa quindi creare un’infrastruttura direttamente integrabile nei workflow finanziari aziendali.

La collaborazione con Prime Intellect aggiunge inoltre una componente infrastrutturale interessante. Prime Intellect è nota per il suo lavoro su training distribuito e infrastrutture AI decentralizzate. Questo suggerisce che Fast Ask potrebbe essere stato addestrato con approcci ottimizzati per efficienza computazionale e specializzazione verticale piuttosto che pura scala parametrica.

Un elemento particolarmente importante riguarda il concetto stesso di “navigazione spreadsheet”. I moderni fogli di calcolo enterprise non sono semplici tabelle statiche. Spesso funzionano come veri sistemi operativi informali dell’azienda, con logiche procedurali, dipendenze finanziarie, automazioni embedded e workflow semi-strutturati costruiti negli anni da differenti team. Comprendere realmente uno spreadsheet enterprise richiede quindi una forma di reasoning operativo contestuale molto diversa dalla semplice lettura tabellare.

Fast Ask sembra essere stato progettato proprio come modello di retrieval operativo. Invece di generare lunghe spiegazioni conversazionali, il sistema punta soprattutto alla localizzazione precisa dell’informazione corretta dentro ambienti tabellari complessi. Questo approccio è molto più vicino ai sistemi enterprise search avanzati che ai chatbot consumer tradizionali.