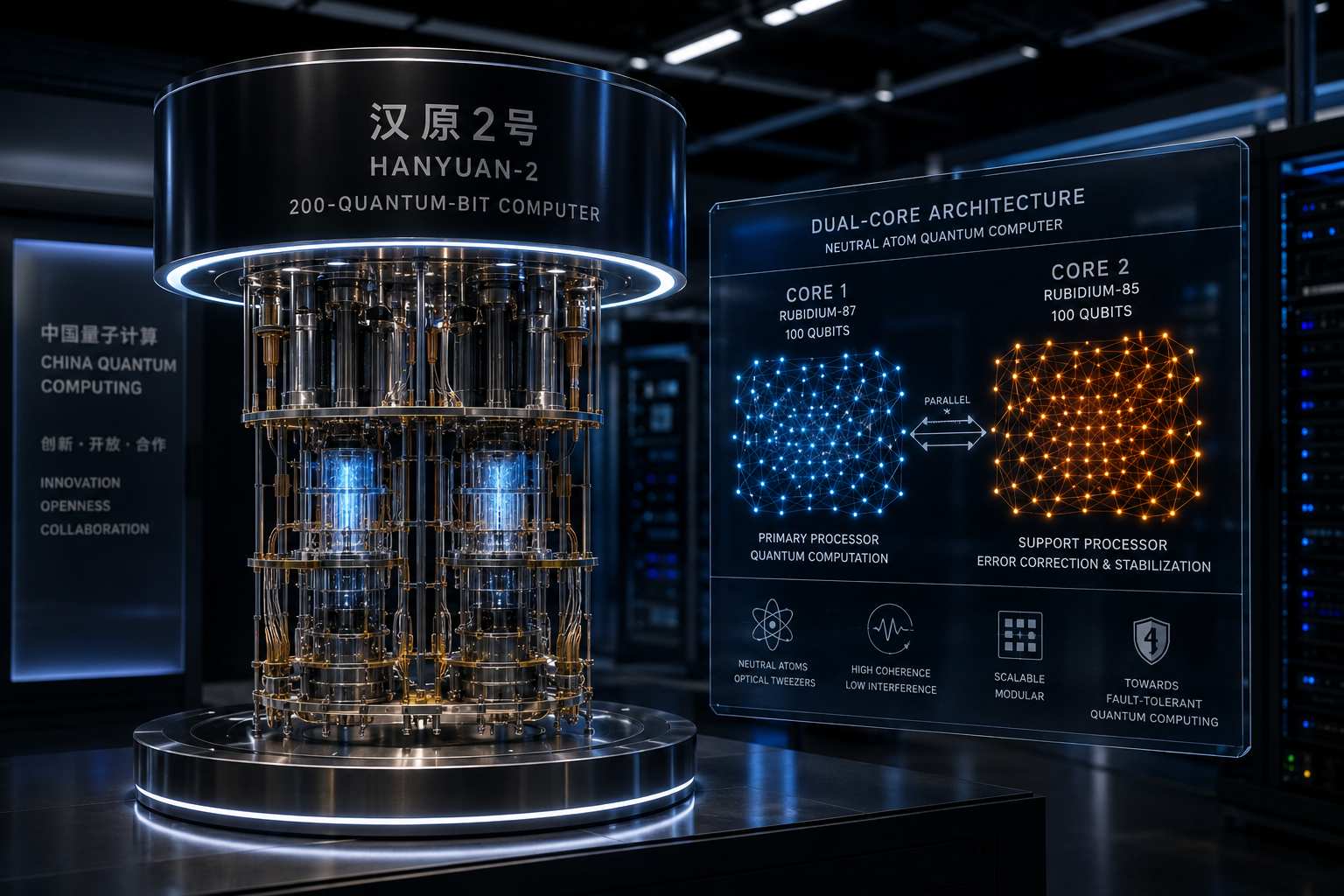

La Cina ha presentato un nuovo computer quantistico a 200 qubit basato su architettura dual core a atomi neutri, segnando uno dei tentativi più avanzati di superare i limiti di scalabilità che stanno emergendo nelle attuali piattaforme quantistiche. Il sistema, chiamato Hanyuan-2, rappresenta l’evoluzione del precedente Hanyuan-1, considerato il primo computer quantistico commerciale cinese basato su atomi neutri. La principale novità consiste nell’integrazione di due core quantistici indipendenti all’interno dello stesso sistema operativo, introducendo un modello di elaborazione parallela che gli sviluppatori descrivono come il passaggio dall’era “single core” a quella “dual core” del quantum computing.

Il nuovo sistema utilizza complessivamente 200 qubit ottenuti tramite due insiemi distinti di atomi neutri: 100 atomi di rubidio-87 e 100 atomi di rubidio-85. Le due matrici atomiche funzionano come processori quantistici separati ma coordinati, permettendo distribuzione del carico computazionale e gestione differenziata delle operazioni. Secondo quanto dichiarato dal team di sviluppo, uno dei core può essere utilizzato come processore principale per il calcolo, mentre il secondo può svolgere funzioni di supporto dedicate alla correzione degli errori e alla stabilizzazione del sistema durante l’elaborazione quantistica.

Il sistema appartiene alla categoria dei computer quantistici a atomi neutri, una delle architetture che negli ultimi anni sta attirando maggiore attenzione nella corsa globale al quantum computing. A differenza dei sistemi superconduttivi utilizzati da aziende come IBM e Google, oppure delle architetture trapped-ion adottate da IonQ e Quantinuum, i computer quantistici a atomi neutri utilizzano singoli atomi raffreddati e manipolati tramite pinzette ottiche laser.

Il principio di funzionamento è estremamente sofisticato. Gli atomi neutri vengono intrappolati nello spazio mediante fasci laser altamente focalizzati chiamati optical tweezers. Una volta raffreddati a temperature vicine allo zero assoluto, possono essere controllati individualmente e utilizzati come qubit quantistici. Gli stati quantistici vengono manipolati tramite impulsi laser e interazioni atomiche controllate, permettendo operazioni di sovrapposizione ed entanglement.

Le architetture a atomi neutri vengono considerate particolarmente promettenti perché offrono vantaggi importanti in termini di scalabilità. Gli atomi sono fisicamente identici tra loro, possono essere disposti in matrici molto dense e tendono a mantenere coerenza quantistica relativamente elevata rispetto ad altre tecnologie concorrenti. Questo rende teoricamente possibile costruire sistemi con migliaia o decine di migliaia di qubit senza alcune delle limitazioni fisiche tipiche delle architetture superconduttive.

Il problema principale del quantum computing moderno riguarda infatti la difficoltà di aumentare il numero di qubit mantenendo stabilità, precisione operativa e bassi livelli di errore. Più cresce il numero di qubit, più aumentano decoerenza, interferenze e rumore quantistico. La scelta cinese di introdurre un’architettura dual core sembra puntare proprio a mitigare questi problemi distribuendo il carico operativo tra processori separati.

Secondo gli sviluppatori, il modello dual core permetterebbe di ridurre alcune delle limitazioni tipiche delle strutture monolitiche single core, in particolare i problemi di interferenza tra qubit adiacenti e le difficoltà di espansione oltre determinate soglie dimensionali. In pratica, invece di costruire una singola matrice atomica sempre più grande e difficile da controllare, il sistema utilizza più unità quantistiche coordinate.

Questo approccio ricorda in parte l’evoluzione storica dei processori classici. Anche nel computing tradizionale l’industria è passata progressivamente da CPU single core a sistemi multi-core quando l’aumento delle frequenze operative ha iniziato a incontrare limiti termici e fisici. Nel quantum computing il problema è diverso ma concettualmente simile: la crescita lineare dei qubit in un’unica struttura introduce instabilità sempre più difficili da controllare.

La funzione di “core secondario” dedicato alla correzione errori è particolarmente interessante. La correzione quantistica degli errori rappresenta infatti uno dei problemi più critici dell’intero settore. I qubit quantistici sono estremamente fragili e qualsiasi interazione con l’ambiente esterno può alterarne lo stato. Per ottenere computer quantistici realmente utili servono sistemi capaci di rilevare e correggere errori in tempo reale senza distruggere l’informazione quantistica.

Attualmente nessuna piattaforma quantistica ha ancora raggiunto pienamente il cosiddetto “fault tolerant quantum computing”, cioè la capacità di eseguire lunghi calcoli complessi con tassi di errore sufficientemente bassi da renderli affidabili su larga scala. Per questo motivo molte architetture moderne stanno iniziando a integrare strutture dedicate alla gestione degli errori quantistici.

Nonostante il risultato tecnologico, il sistema cinese rimane ancora inferiore alle piattaforme occidentali più avanzate sul piano puramente numerico dei qubit. IBM ha già annunciato roadmap superiori ai 1000 qubit nei sistemi superconduttivi, mentre Atom Computing e altre aziende statunitensi hanno presentato piattaforme a atomi neutri con numeri teorici di qubit ancora più elevati.

Tuttavia il semplice conteggio dei qubit non rappresenta più un indicatore sufficiente della qualità di un computer quantistico. Negli ultimi anni il settore si sta progressivamente spostando verso metriche più complesse che considerano anche fedeltà delle operazioni, coerenza temporale, connettività tra qubit e capacità di eseguire circuiti profondi senza degrado eccessivo.

In questo contesto, l’architettura dual core potrebbe rappresentare un esperimento importante per affrontare problemi di orchestrazione e modularità quantistica. Molti ricercatori ritengono infatti che il futuro del quantum computing passerà probabilmente attraverso sistemi modulari composti da più processori quantistici interconnessi piuttosto che da singole matrici gigantesche.

La Cina sta investendo enormemente nel quantum computing come parte della competizione strategica globale sulle tecnologie avanzate. Il paese considera le tecnologie quantistiche un settore chiave sia dal punto di vista economico sia geopolitico, insieme a semiconduttori, AI e telecomunicazioni avanzate. Negli ultimi anni Pechino ha aumentato in modo significativo i finanziamenti pubblici per ricerca quantistica, comunicazioni quantistiche e crittografia post-quantum.

L’interesse strategico deriva soprattutto dal potenziale impatto futuro del quantum computing su cybersecurity, simulazioni molecolari, ottimizzazione industriale e crittografia. Un computer quantistico fault tolerant sufficientemente potente potrebbe teoricamente compromettere molti degli algoritmi crittografici attualmente utilizzati nelle infrastrutture digitali globali. Questo rende la corsa quantistica una questione di sicurezza nazionale oltre che industriale.

Le architetture a atomi neutri stanno assumendo un ruolo sempre più centrale proprio perché potrebbero offrire una strada più praticabile verso sistemi scalabili. Negli Stati Uniti aziende come QuEra, Atom Computing e Pasqal in Europa stanno investendo fortemente nello stesso approccio tecnologico. La competizione si sta quindi spostando non soltanto sul numero di qubit, ma sulla capacità di costruire architetture controllabili, modulari e realmente programmabili.

Il sistema Hanyuan-2 mostra anche quanto il quantum computing stia iniziando a uscire dalla pura ricerca accademica per avvicinarsi a piattaforme commerciali e operative. Hanyuan-1 era già stato presentato come sistema commerciale; Hanyuan-2 suggerisce quindi un tentativo di costruire roadmap evolutive simili a quelle dell’industria semiconduttori classica.

Esiste inoltre un forte collegamento tra AI e quantum computing. Molte aziende e governi stanno cercando di capire come combinare modelli AI avanzati con accelerazione quantistica per applicazioni future di simulazione, ottimizzazione e machine learning quantistico. Sebbene il quantum computing pratico sia ancora lontano da un impatto industriale massivo, la convergenza tra AI e quantum technologies viene ormai considerata una delle direttrici strategiche più importanti del prossimo decennio.