Anthropic ha annunciato la terza revisione della propria Politica di Scalabilità Responsabile, denominata RSP 3.0, introducendo modifiche sostanziali al quadro interno di governance dei rischi legati ai modelli di intelligenza artificiale avanzata. La Responsible Scaling Policy, introdotta per la prima volta nel 2023, rappresenta il pilastro normativo con cui l’azienda ha cercato di regolamentare volontariamente la crescita delle capacità dei propri sistemi, in particolare per mitigare scenari di rischio catastrofico associati a modelli di frontiera. Con RSP 3.0, Anthropic ha rimosso una delle disposizioni più stringenti previste nelle versioni precedenti, ossia la possibilità di interrompere l’addestramento o ritardare il rilascio di un modello qualora le sue capacità superassero le misure di controllo e sicurezza disponibili al momento.

La revisione nasce in un contesto di competizione sempre più intensa nel settore dell’intelligenza artificiale generativa e di pressione politica verso una minore autoregolamentazione industriale. Secondo quanto dichiarato dall’azienda, l’idea di bloccare volontariamente lo sviluppo in assenza di analoghe misure da parte di concorrenti meno prudenti potrebbe paradossalmente rendere il panorama globale più pericoloso, consentendo ad attori meno responsabili di guadagnare terreno tecnologico. Jared Kaplan, direttore scientifico di Anthropic, ha sottolineato che, dato il ritmo estremamente rapido del progresso dell’IA, una sospensione autoimposta dell’addestramento non sarebbe nell’interesse generale.

Nella versione originaria della RSP, il principio di fondo prevedeva che la crescita delle capacità dei modelli fosse subordinata alla disponibilità di misure di mitigazione adeguate. Se un sistema avesse mostrato potenzialità tali da eccedere i controlli interni, l’azienda avrebbe potuto sospenderne lo sviluppo o posticiparne il rilascio pubblico. Con RSP 3.0, questa clausola è stata eliminata, segnando un passaggio da un modello di auto-limitazione preventiva a uno orientato alla gestione progressiva e trasparente del rischio.

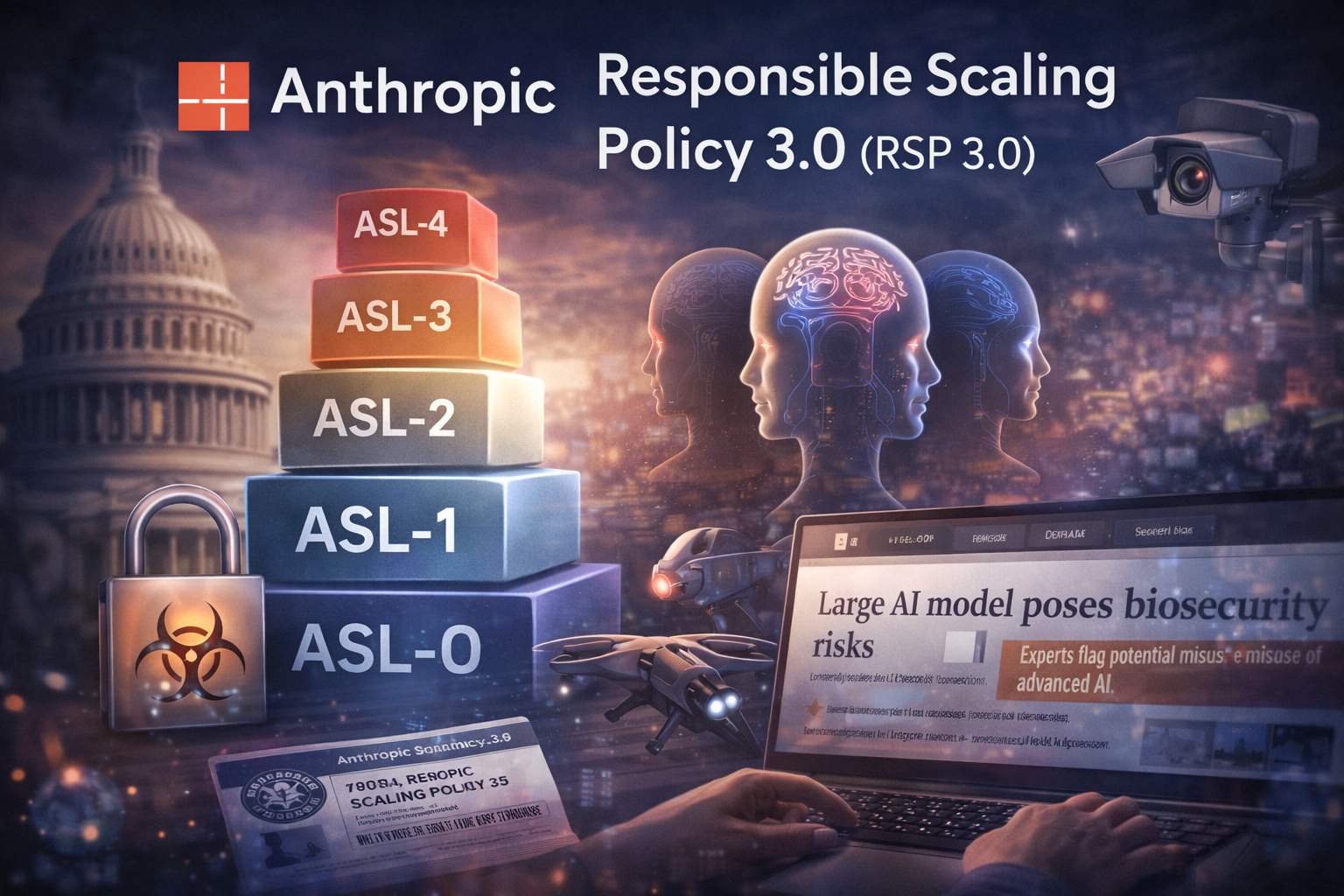

La nuova politica mantiene comunque l’architettura concettuale basata sui livelli di sicurezza denominati AI Safety Level, o ASL. Questo sistema classifica i modelli in base alla loro capacità potenziale e al tipo di rischio associato, prevedendo un rafforzamento graduale delle misure di protezione al crescere delle competenze del sistema. I livelli ASL-2 e ASL-3 sono definiti in termini relativamente concreti e corrispondono a modelli con capacità avanzate ma ancora gestibili con strumenti di monitoraggio, red teaming e controlli tecnici consolidati. Il livello ASL-4 e quelli superiori rappresentano invece una soglia qualitativa più critica, associata a sistemi che potrebbero possedere capacità pari o superiori a quelle umane in domini sensibili e che potrebbero contribuire in modo significativo allo sviluppo di armi biologiche, a cyber-attacchi sofisticati o ad altre forme di danno sistemico.

Anthropic ha riconosciuto che la gestione dei rischi associati ai livelli ASL-4 non può essere affrontata efficacemente da una singola azienda. In tali scenari, ha evidenziato la necessità di una cooperazione più strutturata con governi e organismi internazionali, soprattutto quando emergono rischi distruttivi come il possibile supporto alla produzione di armi biologiche. La posizione ufficiale dell’azienda è che le minacce a questo livello richiedano standard condivisi, capacità di intervento coordinato e un quadro regolatorio più ampio rispetto all’autoregolamentazione aziendale.

Al posto della clausola di sospensione dell’addestramento, RSP 3.0 introduce un rafforzamento della trasparenza e della rendicontazione pubblica. La nuova politica prevede che per tutti i modelli vengano divulgati, con cadenza regolare compresa tra tre e sei mesi, i modelli di minaccia considerati, le valutazioni delle capacità e i piani di mitigazione del rischio. Anthropic ha descritto questo impegno come il livello più elevato di responsabilità pubblica mai adottato finora in questo ambito. Parallelamente, l’azienda ha annunciato una Frontier Safety Roadmap, intesa come documento strategico che definisce obiettivi, criteri di valutazione e contromisure in relazione allo sviluppo di sistemi di frontiera.

La RSP viene presentata come un documento vivo, costantemente aggiornato per tenere il passo con l’evoluzione tecnologica. L’azienda ha ricordato il precedente ritardo nel rilascio del modello Claude nel 2022 per motivi di sicurezza, una decisione che il CEO Dario Amodei ha definito molto costosa dal punto di vista commerciale. Pochi mesi dopo, OpenAI avrebbe consolidato una posizione dominante nel mercato con il lancio di ChatGPT, evidenziando il costo competitivo di un approccio estremamente prudente. Questo precedente rappresenta uno dei fattori che spiegano la scelta di ribilanciare la politica tra cautela e sostenibilità commerciale.

La revisione della RSP 3.0 si colloca inoltre in un contesto di tensioni con il Dipartimento della Difesa degli Stati Uniti. Secondo le informazioni riportate, Dario Amodei avrebbe incontrato il Segretario della Difesa e sarebbe stato invitato a riconsiderare alcune linee guida di sicurezza in relazione a un contratto del valore di 200 milioni di dollari. Parallelamente, il Dipartimento avrebbe contattato aziende della difesa come Lockheed Martin e Boeing per valutare il grado di dipendenza dalla tecnologia di Anthropic, in un quadro interpretato come primo passo verso una possibile designazione di rischio per la catena di approvvigionamento. Nonostante queste pressioni, Anthropic ha ribadito la propria contrarietà all’uso diretto dell’IA per il controllo di sistemi d’arma e per la sorveglianza di massa dei cittadini statunitensi, sostenendo che i sistemi attuali non sono sufficientemente affidabili per operazioni con armi e che mancano standard legali chiari per l’uso su larga scala nella sorveglianza.

A rendere ancora più complesso il quadro interno, il 10 del mese Mrinank Sharma, capo ricercatore per la sicurezza, ha annunciato le proprie dimissioni esprimendo pubblicamente preoccupazioni circa la pressione crescente, sia interna alle organizzazioni sia nella società in generale, a sacrificare priorità etiche e di sicurezza in nome della competitività. Le sue dichiarazioni riflettono un clima di tensione tipico di un settore in cui innovazione tecnologica, responsabilità etica e interessi geopolitici si intrecciano in modo sempre più stretto.