L’intelligenza artificiale generativa ha subito una brusca accelerazione verso la multimodalità nativa, spostando il campo di battaglia dai semplici chatbot testuali a sistemi capaci di interagire in tempo reale attraverso la voce. Tuttavia, l’industria si è scontrata con un limite metodologico significativo: gli strumenti di misurazione delle prestazioni non sono progrediti con la stessa rapidità dei modelli stessi. I benchmark tradizionali si basano spesso su set di dati statici, audio sintetico e script predefiniti che non riflettono la complessità, le sfumature e l’imprevedibilità di una conversazione umana reale. Per colmare questo divario, Scale AI ha presentato Voice Showdown, una piattaforma di valutazione basata sulla preferenza umana che introduce un rigore empirico senza precedenti nell’analisi delle interazioni vocali.

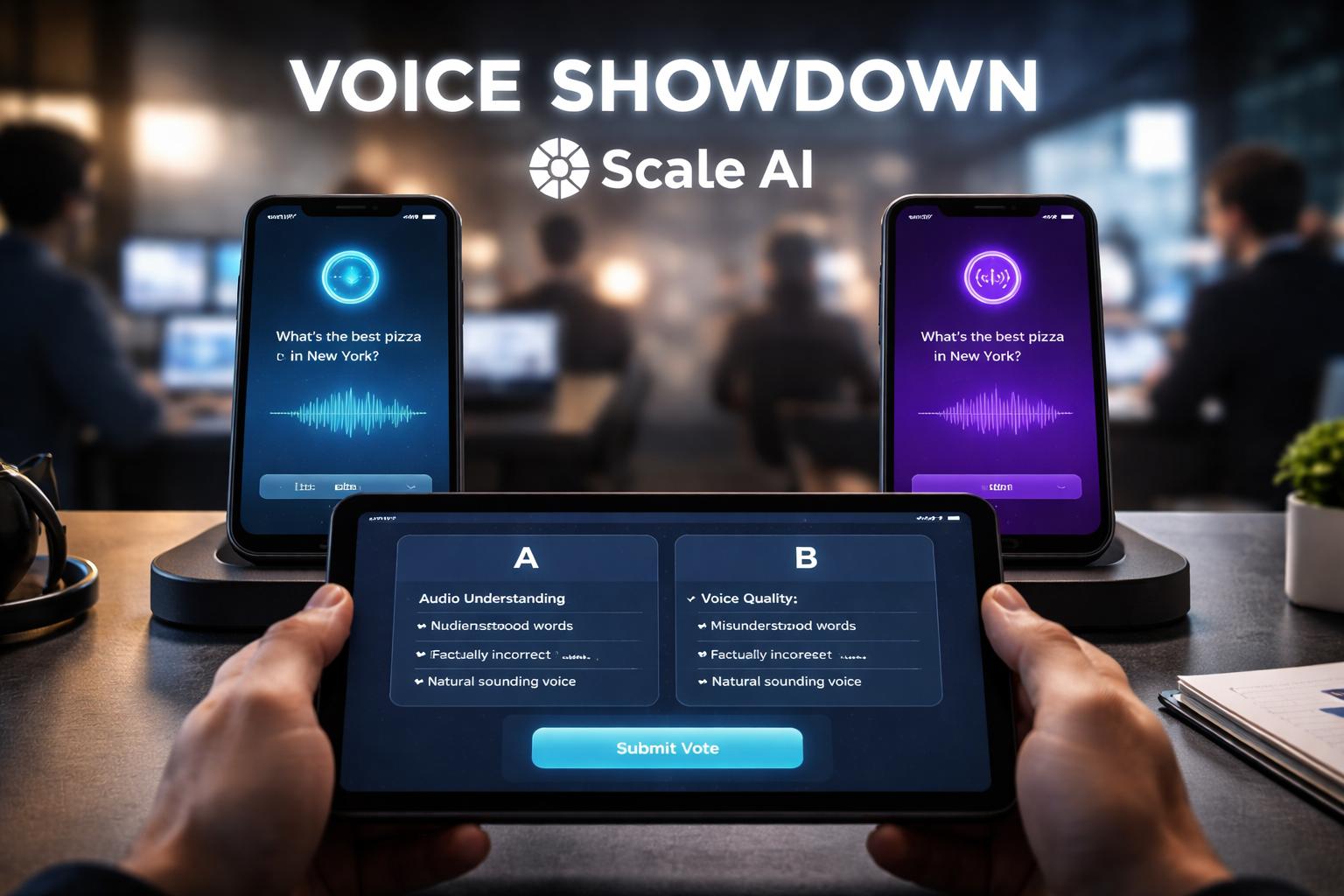

Voice Showdown si distingue dai test di laboratorio per la sua natura “in-the-wild”. Invece di sottoporre i modelli a campioni audio puliti e registrati professionalmente, il sistema attinge a migliaia di conversazioni spontanee generate da utenti reali in oltre sessanta lingue. Questo approccio permette di testare la robustezza dei modelli di fronte a variabili critiche come il rumore di fondo, gli accenti regionali, le esitazioni verbali e le frasi interrotte. Il meccanismo di valutazione è integrato in ChatLab, l’infrastruttura di Scale AI che permette agli utenti di interagire gratuitamente con i modelli di frontiera più avanzati. Durante una sessione, il sistema introduce occasionalmente un test “cieco” in cui la stessa richiesta vocale viene elaborata simultaneamente da due modelli anonimi. L’utente sceglie la risposta preferita, fornendo un segnale di qualità che nessun algoritmo automatizzato è attualmente in grado di replicare con la stessa accuratezza.

I primi dati emersi da Voice Showdown rivelano una gerarchia competitiva che sfida alcune percezioni comuni del mercato. Nelle valutazioni di tipo “Dictate”, dove l’input vocale riceve una risposta testuale, i modelli Gemini 3 Pro e Gemini 3 Flash di Google hanno mostrato una dominanza statistica, posizionandosi ai vertici della classifica Elo. GPT-4o di OpenAI mantiene una solida posizione, ma il distacco si assottiglia significativamente quando si passa alla modalità “Speech-to-Speech” (S2S), dove il modello risponde direttamente con la voce. In questo contesto, l’analisi ha evidenziato come fattori puramente estetici, quali il timbro della voce o l’intonazione, possano influenzare la percezione dell’utente tanto quanto la qualità del contenuto generato.

Un dato tecnico particolarmente rilevante riguarda la fragilità multilingue. Nonostante le dichiarazioni di supporto per decine di idiomi, molti modelli d’élite mostrano tassi di errore sorprendenti quando si allontanano dall’inglese. È stato osservato che modelli come GPT Realtime 1.5 tendono a rispondere in inglese a prompt non inglesi in circa il 20% dei casi, un fenomeno di “deriva linguistica” che compromette l’utilità pratica per gli utenti globali. Al contrario, modelli meno noti ma tecnicamente ottimizzati, come Qwen 3 Omni di Alibaba, hanno dimostrato una capacità superiore nell’identificare correttamente dialetti locali e lingue meno diffuse, superando spesso i concorrenti più celebri in termini di pura comprensione acustica.

Un altro aspetto critico analizzato da Voice Showdown è la tenuta dei modelli sulla lunga distanza. La maggior parte dei benchmark convenzionali si limita a testare una singola interazione (single-turn). L’analisi di Scale AI rivela invece che la qualità della risposta tende a degradare drasticamente con l’aumentare dei turni di conversazione. Se al primo scambio i fallimenti sono dovuti principalmente a errori di comprensione audio, verso l’undicesimo turno la causa principale di insoddisfazione diventa la perdita di coerenza del contenuto. Questo indica che, sebbene i modelli stiano diventando eccellenti nell’ascolto immediato, la gestione della memoria contestuale e della logica narrativa all’interno di un flusso vocale prolungato rimane una sfida tecnica aperta per l’intero settore.

Il valore strategico di Voice Showdown risiede nella sua capacità di isolare le variabili di fallimento attraverso i feedback degli utenti, che categorizzano ogni interazione problematica in tre assi: comprensione audio, qualità del contenuto e resa vocale. Questo livello di granularità permette agli sviluppatori di capire se un modello “perde” perché non ha capito le parole, perché ha fornito un’informazione errata o semplicemente perché il suono della sua voce è risultato sgradevole o artificiale. La prossima frontiera dichiarata da Scale AI è l’implementazione della valutazione “Full Duplex”, ovvero la capacità di gestire conversazioni bidirezionali simultanee dove l’utente può interrompere il modello in tempo reale. Questo rappresenterà il test definitivo per la latenza e la fluidità, portando l’intelligenza artificiale vocale un passo più vicino alla naturalezza della comunicazione umana.