L’ascesa dei modelli generativi nel campo della programmazione ha introdotto una dicotomia operativa senza precedenti, dove all’incremento esponenziale della velocità di scrittura si contrappone un deterioramento della qualità strutturale e della sicurezza del software. Per rispondere a questa criticità, nella Silicon Valley sta emergendo un nuovo paradigma tecnologico basato sulla verifica del codice tramite sistemi di intelligenza artificiale specializzati in logica matematica. Il nucleo di questa innovazione, guidato da realtà come Axiom Math, risiede nel trasferimento delle capacità di dimostrazione formale — tradizionalmente utilizzate per risolvere complessi teoremi matematici — alla validazione del software. Questo approccio si distacca dai correttori sintattici convenzionali per adottare una metodologia di controllo rigorosa, capace di mappare la coerenza logica di un algoritmo con la stessa precisione richiesta per la validazione di una congettura matematica.

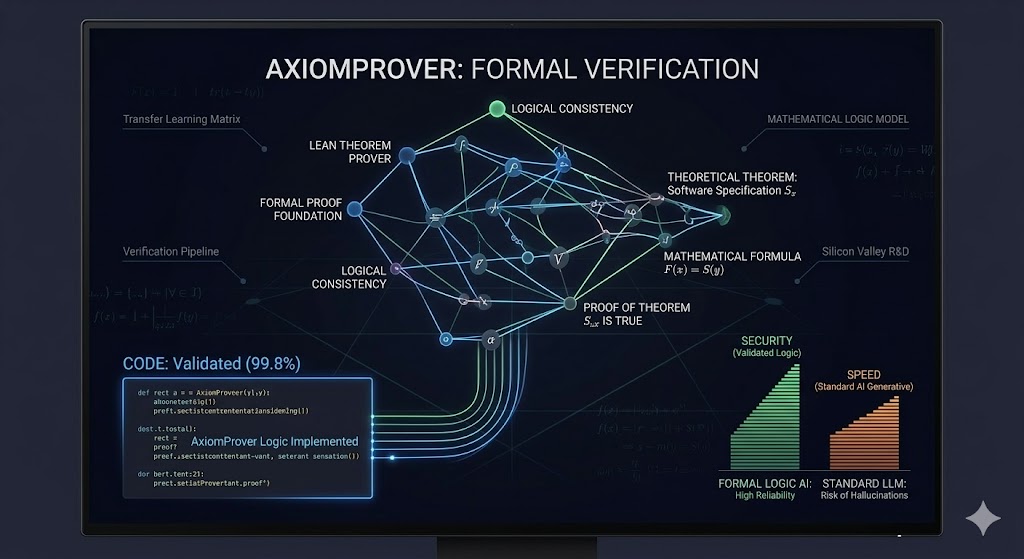

Il pilastro tecnico di questo sistema è rappresentato dall’utilizzo di Lean, un linguaggio di programmazione e assistente alla dimostrazione progettato originariamente per la verifica dei teoremi. Lean permette di costruire una prova logica che una determinata sequenza di codice soddisfi esattamente le specifiche per cui è stata scritta, eliminando l’ambiguità tipica dei linguaggi naturali. Attraverso l’implementazione della tecnologia AxiomProver, il sistema applica il cosiddetto apprendimento per trasferimento: l’intelligenza artificiale viene prima addestrata a risolvere e dimostrare problemi matematici di alto livello e, una volta acquisita la padronanza della struttura logica necessaria, applica queste competenze per setacciare il codice sorgente alla ricerca di bug, vulnerabilità o inefficienze strutturali. Questo processo trasforma la revisione del codice da un’attività euristica e soggettiva a una disciplina scientifica verificabile.

L’efficacia di questo metodo è stata confermata da punteggi elevati nei test di benchmark di settore, evidenziando come l’IA specializzata nella logica possa superare i limiti dei modelli di linguaggio generali, i quali spesso tendono a produrre allucinazioni o codice sintatticamente corretto ma logicamente fallace. Tuttavia, il passaggio dalla matematica pura all’ingegneria del software presenta sfide tecniche non banali. Mentre in ambito matematico esiste una distinzione netta tra vero e falso, nel software la definizione di codice corretto può variare drasticamente in base al contesto operativo, al carico di utenti e alle interdipendenze con altri sistemi. Per questa ragione, la ricerca attuale si sta concentrando sulla creazione di modelli capaci di gestire la complessità dei servizi su larga scala, dove la correttezza non è solo una questione di logica booleana ma di resilienza sistemica.

In un futuro in cui la generazione automatica di software diventerà la norma, la creazione di un’infrastruttura di controllo in cui l’intelligenza artificiale verifica se stessa appare come l’unica soluzione scalabile per mantenere l’integrità dei sistemi digitali. Il mercato sta premiando questa visione con ingenti capitali, riconoscendo che la vera frontiera dello sviluppo tecnologico non è più la semplice capacità di creare nuovi contenuti, ma la possibilità di garantire che tali contenuti siano affidabili, sicuri e privi di errori logici. L’integrazione di motori di dimostrazione formale nel ciclo di vita del software promette di ridurre drasticamente il debito tecnico e di accelerare l’innovazione, garantendo al contempo che la velocità di esecuzione non vada mai a discapito della robustezza del prodotto finale.