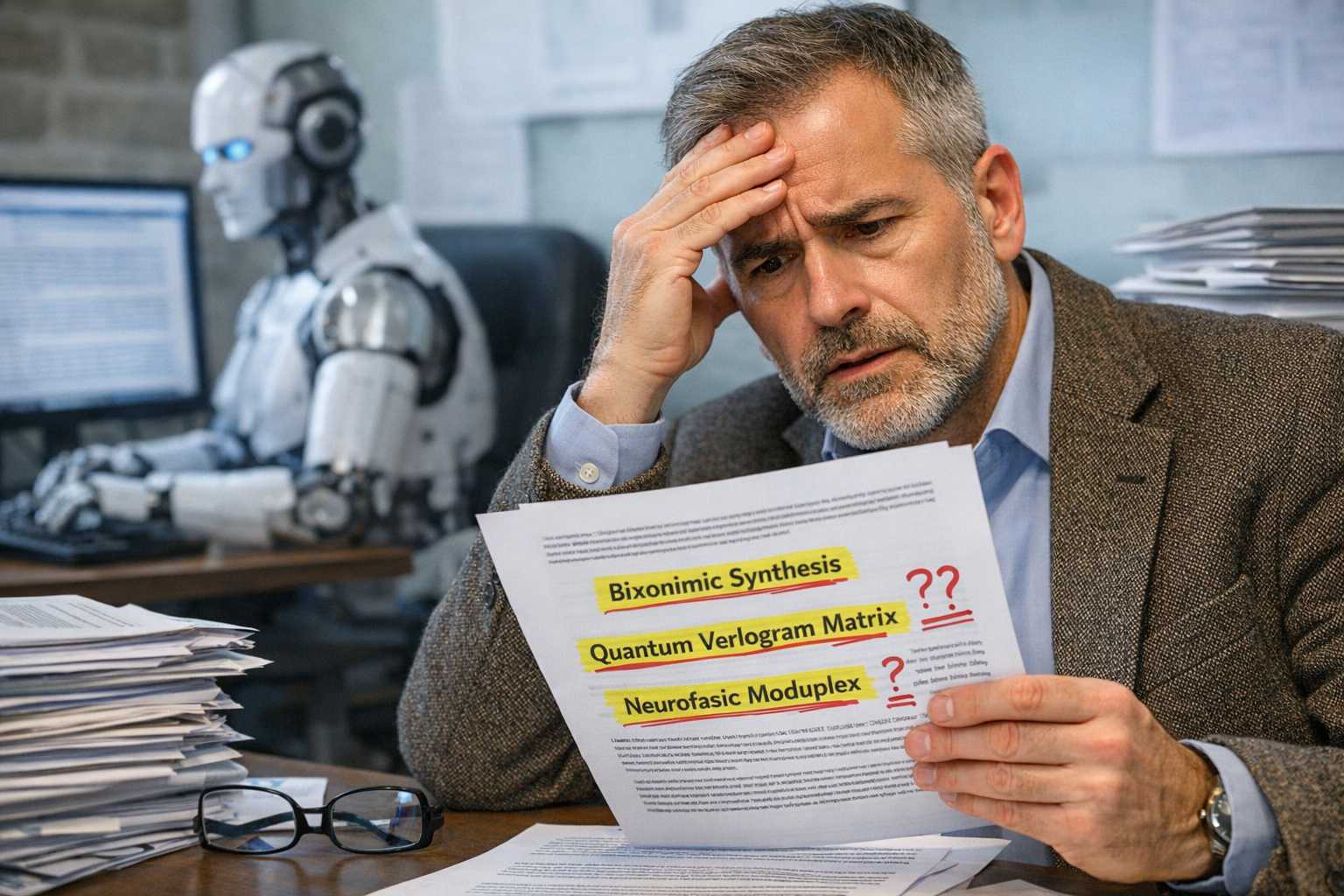

Il recente caso della cosiddetta “Bixonimania” ha sollevato un dibattito critico all’interno della comunità accademica internazionale, mettendo in luce le vulnerabilità strutturali dei processi di revisione editoriale di fronte all’uso massiccio di modelli linguistici di grandi dimensioni. Il fenomeno trae origine dalla pubblicazione di articoli scientifici contenenti termini privi di senso o neologismi generati da algoritmi, i quali sono riusciti a superare i filtri delle revisioni paritarie nonostante la presenza di evidenti anomalie testuali e concettuali. Questo evento non rappresenta un semplice errore isolato, ma segna l’emergere di una problematica sistemica legata all’affidabilità dell’intelligenza artificiale quando applicata alla produzione di contenuti specialistici, dove la precisione terminologica è il pilastro su cui poggia la validità della conoscenza condivisa.

Il problema risiede nella natura stessa dei modelli probabilistici utilizzati per la generazione del testo, i quali operano sulla base della previsione statistica della parola successiva piuttosto che su una reale comprensione semantica o fattuale. Quando un ricercatore utilizza strumenti di intelligenza artificiale per redigere abstract o sezioni metodologiche senza un rigoroso controllo umano, il rischio di “allucinazione” aumenta esponenzialmente. In contesti scientifici, tali allucinazioni possono manifestarsi attraverso l’invenzione di citazioni bibliografiche, la creazione di dati statistici plausibili ma falsi o, come nel caso della Bixonimania, l’inserimento di termini tecnici inesistenti che imitano la struttura morfologica del linguaggio accademico senza possederne il significato.

L’aspetto più preoccupante di questa deriva tecnologica riguarda il cortocircuito nei meccanismi di controllo della qualità editoriale. La velocità con cui l’IA può produrre manoscritti ha saturato i canali di pubblicazione, rendendo difficile per i revisori umani identificare incongruenze sottili ma fondamentali. Il superamento della peer-review da parte di contenuti generati artificialmente e palesemente errati suggerisce una crescente dipendenza da strumenti di verifica a loro volta automatizzati, che però spesso falliscono nel rilevare errori semantici complessi. Questa dinamica minaccia di inquinare i database scientifici globali con informazioni parzialmente o totalmente infondate, rendendo sempre più arduo distinguere tra scoperte basate sull’evidenza empirica e artefatti prodotti da processi computazionali non supervisionati.

Per contrastare questo fenomeno, la comunità scientifica sta riflettendo sull’adozione di protocolli di trasparenza più rigidi e sull’implementazione di algoritmi di rilevamento specificamente addestrati per identificare pattern di scrittura artificiale. Tuttavia, la soluzione non può essere esclusivamente tecnologica; è necessaria una riformulazione dell’etica della ricerca che riaffermi la responsabilità dell’autore umano come garante ultimo del contenuto pubblicato. La Bixonimania funge dunque da monito sulla necessità di mantenere un approccio critico e metodologico rigoroso, ricordando che l’intelligenza artificiale, sebbene potente, rimane uno strumento di supporto che non può e non deve sostituire il discernimento analitico e la verifica fattuale che sono propri del metodo scientifico tradizionale.