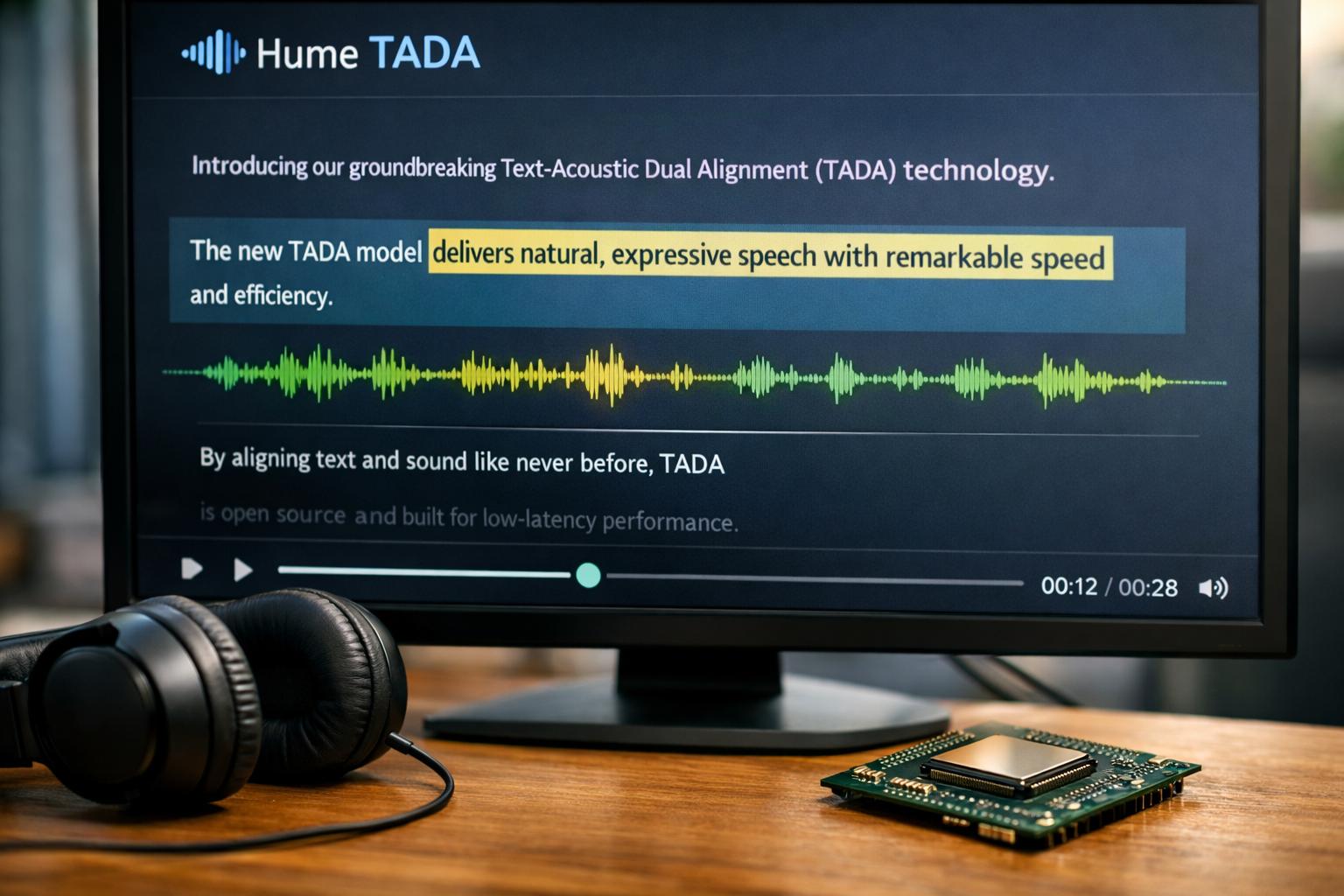

Le aziende che sviluppano tecnologie vocali stanno cercando di risolvere una sfida fondamentale: generare parlato naturale e affidabile mantenendo al tempo stesso tempi di risposta estremamente rapidi e un consumo computazionale ridotto. Una nuova proposta in questa direzione arriva da Hume AI, società specializzata nello sviluppo di tecnologie vocali basate su intelligenza artificiale, che ha annunciato una nuova architettura di sintesi vocale chiamata TADA (Text-Acoustic Dual Alignment) e ha reso disponibili il modello e il codice sorgente in modalità open source sulle piattaforme HuggingFace e GitHub.

La tecnologia TADA è stata progettata per affrontare uno dei limiti strutturali dei sistemi di sintesi vocale moderni integrati nei modelli linguistici di grandi dimensioni. Molti sistemi di text-to-speech (TTS) utilizzati oggi nelle architetture basate su LLM presentano una difficoltà fondamentale legata alla differenza di densità informativa tra testo e segnale vocale. In termini computazionali, il parlato è molto più ricco di informazioni rispetto al testo. Un secondo di audio parlato può essere rappresentato da circa 12,5 a 25 frame acustici, mentre lo stesso contenuto espresso in forma testuale richiede generalmente solo due o tre token linguistici. Questo squilibrio genera una struttura interna nei modelli in cui il numero di token audio elaborati è molto più elevato rispetto ai token di testo.

Questa differenza di densità informativa crea diversi problemi tecnici nelle architetture tradizionali. Poiché i modelli devono gestire una quantità molto maggiore di token audio, diventa necessario utilizzare finestre di contesto più ampie, con un conseguente aumento significativo dell’utilizzo di memoria. Inoltre, la velocità di inferenza può diminuire sensibilmente, poiché il sistema deve generare una sequenza molto più lunga di unità acustiche rispetto alle unità testuali. In alcune situazioni questo squilibrio può portare a problemi di qualità nella generazione del parlato, come omissioni di parole, errori di sincronizzazione tra testo e voce o fenomeni simili alle allucinazioni dei modelli linguistici.

Nel corso degli anni sono stati proposti diversi approcci per affrontare questo problema. Alcuni sistemi cercano di ridurre il numero di frame acustici rappresentando l’audio con una codifica più compressa. Altri introducono token semantici intermedi che fungono da ponte tra testo e audio. Tuttavia, queste strategie comportano spesso compromessi significativi. La compressione eccessiva del segnale vocale può ridurre l’espressività e la naturalezza del parlato, mentre l’introduzione di livelli intermedi di rappresentazione aumenta la complessità dell’architettura del modello.

La proposta di Hume AI con TADA introduce un approccio differente, basato su un principio di allineamento diretto tra token di testo e rappresentazioni acustiche. Il cuore della tecnologia consiste in una struttura che associa a ogni token testuale una rappresentazione acustica unica, permettendo a testo e parlato di essere elaborati all’interno del modello linguistico come un flusso completamente sincronizzato. In questo schema architetturale, il modello non genera una lunga sequenza separata di frame audio, ma produce simultaneamente informazioni linguistiche e acustiche in un’unica fase di elaborazione.

Il funzionamento del sistema può essere descritto come una pipeline a più livelli. In una prima fase il modello linguistico elabora il testo e genera uno stato interno che rappresenta il contenuto semantico della frase. A questo stato viene associato un vettore acustico che rappresenta le caratteristiche sonore del parlato corrispondente. Successivamente, queste caratteristiche vengono trasformate in un segnale audio reale attraverso un processo di sintesi vocale che converte le rappresentazioni acustiche in onde sonore.

In questa architettura, ogni ciclo di elaborazione del modello linguistico produce simultaneamente un token di testo e un frame audio corrispondente. Questa sincronizzazione strutturale rende molto più difficile per il modello saltare parti del contenuto o generare parole non previste dal testo originale, riducendo il rischio di errori nella generazione del parlato.

Uno degli aspetti più rilevanti della tecnologia TADA riguarda le prestazioni in termini di velocità di elaborazione. Nei sistemi TTS tradizionali basati su LLM, la generazione del parlato richiede l’elaborazione di un numero elevato di token audio al secondo, generalmente compreso tra circa 12,5 e 75 unità. Con l’architettura TADA questo numero viene drasticamente ridotto a circa due o tre token al secondo, grazie all’allineamento diretto tra testo e rappresentazione acustica. La riduzione del numero di token da elaborare comporta un abbassamento significativo del carico computazionale e della latenza del sistema.

Secondo i dati forniti dal team di ricerca, il sistema ha raggiunto un fattore in tempo reale pari a 0,09, indicando una velocità di generazione del parlato più di cinque volte superiore rispetto a molti sistemi TTS basati su modelli linguistici di grandi dimensioni. Questa caratteristica rende TADA particolarmente interessante per applicazioni in cui la latenza rappresenta un fattore critico, come assistenti vocali, interfacce conversazionali o sistemi di traduzione simultanea.

Un ulteriore vantaggio dell’architettura riguarda l’efficienza nell’utilizzo del contesto del modello. Nei sistemi TTS convenzionali, una finestra di contesto di circa 2048 token consente generalmente di generare circa 70 secondi di parlato continuo. Grazie alla riduzione del numero di token acustici necessari, TADA può generare fino a circa 700 secondi di parlato, equivalenti a oltre undici minuti di audio, utilizzando la stessa dimensione della finestra di contesto. Questo miglioramento rende la tecnologia particolarmente adatta a scenari come la lettura automatica di testi lunghi, la narrazione di audiolibri o conversazioni vocali multi-turno di lunga durata.

Il modello è stato inoltre progettato per essere relativamente leggero dal punto di vista computazionale. I ricercatori sottolineano che la struttura può funzionare anche su dispositivi con risorse limitate, come smartphone o sistemi edge. La possibilità di eseguire la sintesi vocale direttamente sul dispositivo rappresenta un vantaggio significativo per diverse applicazioni. In primo luogo riduce la latenza, poiché non è necessario inviare i dati a un server cloud per la generazione del parlato. In secondo luogo migliora la protezione della privacy degli utenti, poiché i dati vocali non devono essere trasmessi a infrastrutture remote.

Durante le valutazioni sperimentali, i ricercatori hanno analizzato oltre mille campioni audio provenienti dal dataset di test LibriTTSR, un corpus ampiamente utilizzato nella ricerca sulla sintesi vocale. Secondo i risultati riportati, il sistema non ha mostrato casi di allucinazioni uditive durante i test, suggerendo che l’architettura di allineamento diretto tra testo e audio contribuisce a migliorare l’affidabilità della generazione vocale.

Sebbene i risultati promettenti, il team di sviluppo ha riconosciuto che la tecnologia presenta ancora alcune sfide tecniche. Uno dei fenomeni osservati è il cosiddetto speaker drift, una variazione graduale delle caratteristiche della voce sintetizzata durante la generazione di discorsi molto lunghi. In pratica, la voce dell’oratore può cambiare leggermente nel tempo, creando una lieve incoerenza timbrica. Inoltre, i ricercatori hanno rilevato che in alcuni casi la qualità del testo generato può degradarsi quando il modello produce simultaneamente contenuti linguistici e audio.

Nonostante queste limitazioni, la proposta di Hume AI rappresenta un passo importante verso sistemi vocali più efficienti e integrati nei modelli linguistici. La capacità di sincronizzare direttamente testo e audio all’interno della stessa architettura computazionale potrebbe contribuire a semplificare le pipeline di sintesi vocale e a migliorare le prestazioni dei sistemi conversazionali.