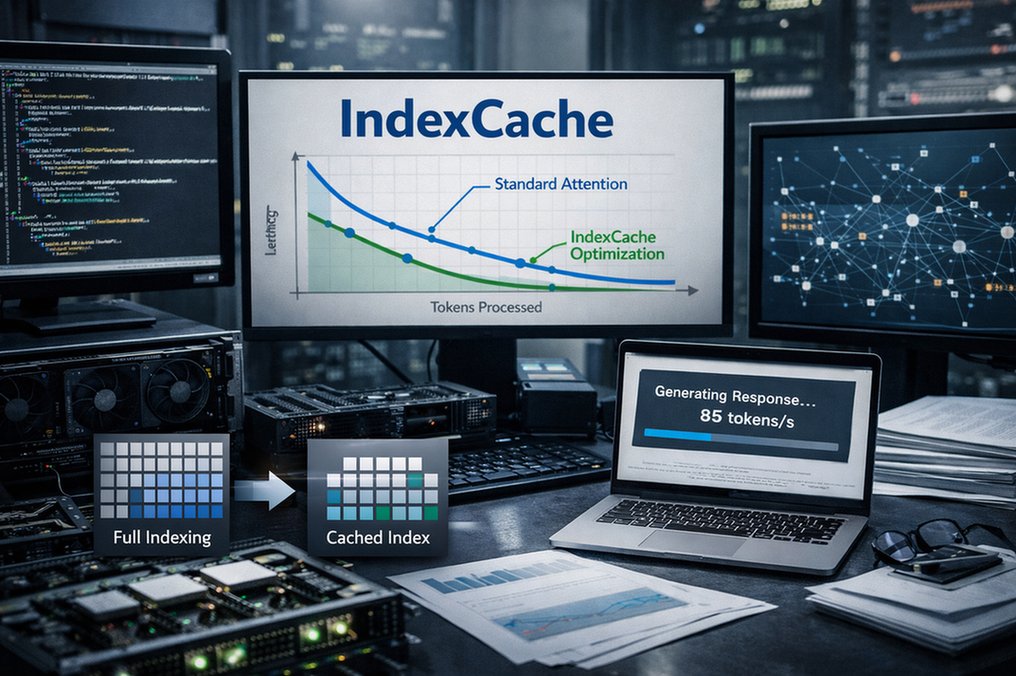

La crescita dei modelli linguistici di grandi dimensioni ha reso sempre più evidente uno dei principali limiti operativi dell’intelligenza artificiale moderna: l’elevato costo computazionale necessario per gestire contesti lunghi. L’aumento del numero di token analizzati comporta un incremento significativo dei tempi di inferenza e delle risorse hardware richieste, rendendo difficile l’adozione su larga scala di applicazioni basate su documenti estesi, workflow agentici e sistemi di ragionamento complesso. In questo scenario si inserisce IndexCache, una tecnica di ottimizzazione della sparse attention che introduce un approccio innovativo per ridurre il carico computazionale e accelerare l’elaborazione senza compromettere la qualità delle risposte.

IndexCache è stato sviluppato da ricercatori della Tsinghua University e di Z.ai con l’obiettivo di eliminare calcoli ridondanti nei modelli di attenzione sparsa. Nei test condotti su contesti molto lunghi, la tecnica ha raggiunto fino a 1,82 volte la velocità di inferenza rispetto alle implementazioni standard e un incremento fino a 1,48 volte nel throughput di generazione, dimostrando un miglioramento significativo nella gestione dei modelli con finestre di contesto estese.

Per comprendere il funzionamento di IndexCache è necessario analizzare il meccanismo di self-attention utilizzato dai modelli Transformer. Questo processo calcola la relazione tra ogni token e tutti quelli precedenti per generare il successivo, ma la complessità computazionale cresce quadraticamente con la lunghezza della sequenza. Nei contesti molto lunghi, questa caratteristica diventa un collo di bottiglia, rallentando l’inferenza e aumentando i costi operativi. La sparse attention rappresenta una soluzione parziale, perché limita i calcoli selezionando solo i token più rilevanti, ma anche in questo caso il modulo di indicizzazione deve essere eseguito a ogni layer del modello, mantenendo una complessità elevata.

La principale innovazione di IndexCache consiste nell’osservazione che i layer consecutivi dei modelli di attenzione sparsa selezionano spesso gli stessi token rilevanti. Le analisi empiriche hanno mostrato che la sovrapposizione tra i token selezionati nei layer adiacenti può variare tra il 70% e il 100%, evidenziando una significativa ridondanza computazionale. IndexCache sfrutta questa proprietà suddividendo i layer in due categorie: alcuni layer completi continuano a calcolare gli indici, mentre gli altri riutilizzano i risultati già memorizzati, evitando di ripetere le stesse operazioni.

Questo approccio introduce una forma di caching degli indici che riduce drasticamente il numero di calcoli necessari. Durante l’inferenza, quando il modello raggiunge un layer completo, calcola e memorizza gli indici dei token più rilevanti; nei layer successivi, invece, utilizza direttamente i valori salvati senza eseguire nuovi calcoli. Il risultato è una riduzione significativa del carico computazionale, con benefici soprattutto nella fase iniziale di elaborazione del prompt, nota come prefill, che rappresenta una delle operazioni più costose nei modelli a contesto lungo.

Le prestazioni sperimentali evidenziano l’impatto pratico della tecnica. In test effettuati su un modello da 30 miliardi di parametri con contesto di 200.000 token, la latenza della fase di prefill è stata ridotta da 19,5 secondi a 10,7 secondi, corrispondente a un’accelerazione di circa 1,82 volte. Nella fase di generazione della risposta, il throughput è aumentato da 58 a 86 token al secondo, con un miglioramento di circa 1,48 volte. Inoltre, quando il sistema è utilizzato in condizioni di saturazione, il throughput complessivo può crescere fino al 51%.

Un aspetto rilevante è che queste ottimizzazioni non compromettono la qualità del modello. I test mostrano che la rimozione fino al 75% dei moduli di indicizzazione produce una degradazione minima delle prestazioni e, in alcuni benchmark di ragionamento complesso, il modello ottimizzato ottiene risultati leggermente migliori rispetto alla versione originale. Questo suggerisce che la ridondanza eliminata da IndexCache non contribuisce in modo significativo alla qualità dell’output, ma rappresenta principalmente un overhead computazionale.

La tecnica può essere implementata con due approcci distinti. Il primo, definito training-free, utilizza un algoritmo di selezione dei layer basato su un set di calibrazione e non richiede il riaddestramento del modello. Il secondo, training-aware, introduce una fase di addestramento che ottimizza la condivisione degli indici tra i layer, migliorando ulteriormente l’efficienza. Questa flessibilità consente di applicare IndexCache sia a modelli già esistenti sia a nuovi modelli progettati per sfruttare nativamente l’ottimizzazione.

I benefici si traducono in una riduzione dei costi e in una migliore esperienza utente. Le applicazioni che utilizzano contesti lunghi, come sistemi RAG, analisi documentale e pipeline agentiche, possono ottenere riduzioni dei costi di deployment e miglioramenti della latenza percepita, rendendo più sostenibile l’utilizzo di modelli di grandi dimensioni in ambienti produttivi.