Mettere alla prova modelli generativi con una lingua locale come il padovano non è soltanto un esercizio curioso: è un test tecnico che evidenzia come questi sistemi apprendano, generalizzino e producano linguaggio in condizioni di forte ambiguità e scarsità di dati.

Il punto di partenza è una constatazione fondamentale: i modelli linguistici contemporanei non apprendono le lingue nel senso umano del termine, ma costruiscono rappresentazioni probabilistiche basate su grandi quantità di esempi. Quando vengono esposti a una lingua standardizzata, dotata di grammatica codificata e abbondante presenza nei dati di addestramento, riescono a produrre risultati coerenti e relativamente affidabili. Quando invece si confrontano con una varietà linguistica come il padovano, caratterizzata da forte variabilità locale, assenza di standard ortografico e presenza limitata nei corpora digitali, il comportamento del modello diventa un indicatore diretto delle sue capacità di generalizzazione.

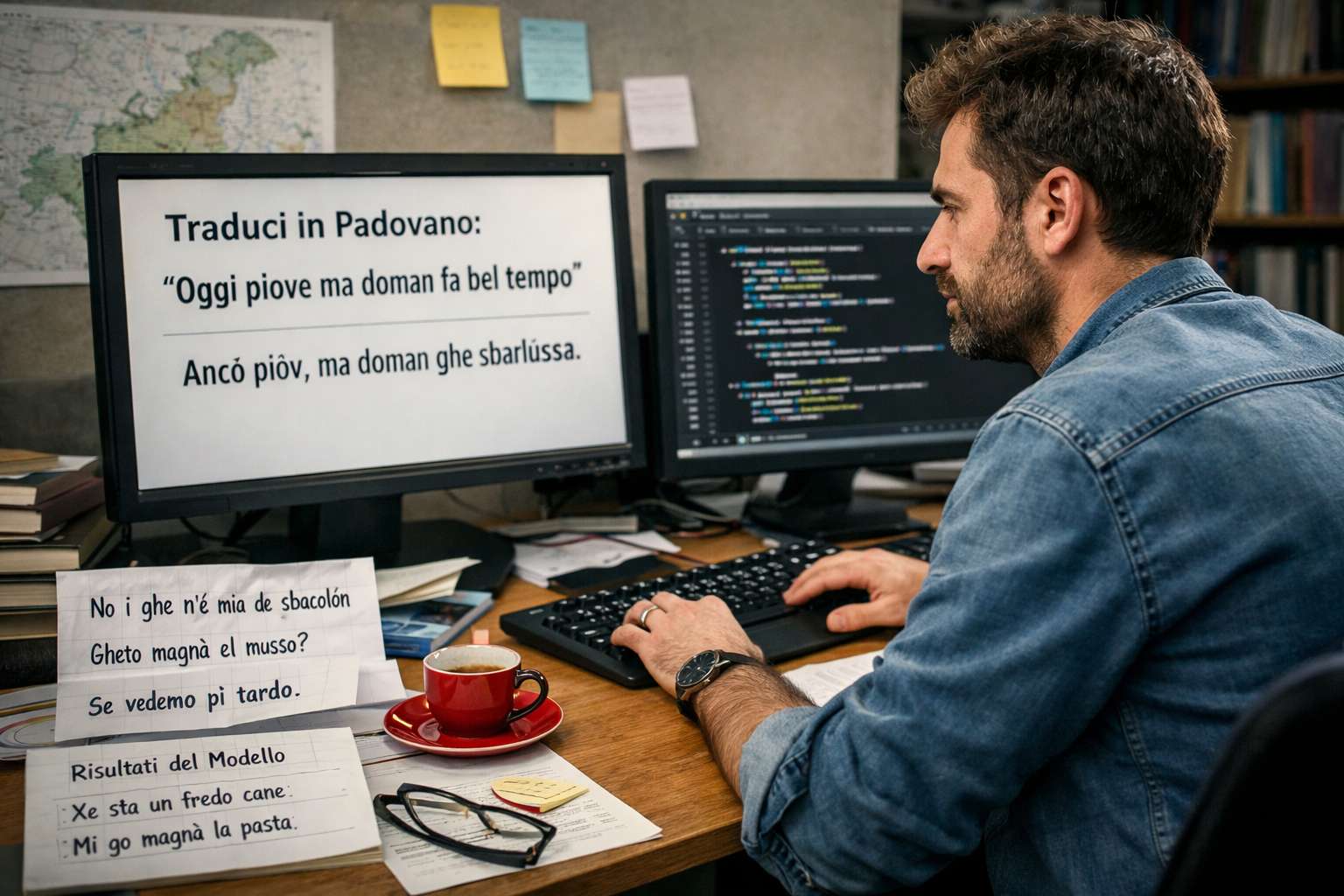

L’esperimento riportato mostra come diversi sistemi siano comunque in grado di generare frasi plausibili in padovano, partendo da richieste di traduzione relativamente semplici. Questo risultato non è banale, perché implica che il modello riesce a ricostruire pattern linguistici anche in assenza di una codifica formale stabile. La frase prodotta, pur con varianti possibili, mantiene una struttura coerente e comprensibile, suggerendo che il sistema ha interiorizzato relazioni tra italiano standard e varianti dialettali attraverso esempi indiretti.

Tuttavia, proprio questa capacità evidenzia un limite profondo. Il padovano, come molte lingue locali, non possiede una grammatica univoca e presenta differenze significative anche tra aree geografiche vicine. Di conseguenza, non esiste una singola risposta “corretta”, ma una molteplicità di varianti tutte potenzialmente valide. In questo contesto, il modello non può fare altro che produrre una media statistica delle forme linguistiche osservate, generando una versione plausibile ma non necessariamente rappresentativa di una specifica comunità linguistica.

Questo comportamento richiama direttamente uno dei temi centrali del dibattito teorico sull’intelligenza artificiale: la distinzione tra sintassi e semantica. Esperimenti concettuali come la stanza cinese mostrano come un sistema possa manipolare simboli in modo coerente senza comprenderne realmente il significato. Nel caso dei modelli linguistici, la capacità di produrre padovano non implica una comprensione culturale o contestuale della lingua, ma soltanto la capacità di replicarne le strutture superficiali.

Un ulteriore elemento di interesse emerge dal confronto con lingue ancora più rare o in via di estinzione, come il cimbro, citato nello stesso articolo. In questi casi, la qualità dei risultati dipende in modo critico dalla disponibilità e dalla qualità degli esempi utilizzati per l’addestramento. Questo aspetto evidenzia una proprietà fondamentale dei sistemi di apprendimento automatico: non esiste una vera capacità di astrazione indipendente dai dati, ma una dipendenza diretta dalla distribuzione delle informazioni disponibili.

Ciò si traduce in una tensione tra generalizzazione e specificità. I modelli linguistici devono essere sufficientemente generali da gestire molte lingue e contesti diversi, ma questa generalità comporta una perdita di precisione quando si affrontano domini altamente specifici o poco rappresentati. Il risultato è un equilibrio instabile, in cui la produzione linguistica appare corretta a livello superficiale ma può contenere imprecisioni sottili o scelte arbitrarie.

Questo fenomeno è strettamente legato anche al problema delle cosiddette “allucinazioni” nei modelli AI, ovvero la tendenza a generare contenuti plausibili ma non verificati o non corretti. Nel contesto dei dialetti, l’allucinazione non si manifesta necessariamente come errore evidente, ma come costruzione di forme linguistiche che non appartengono a nessuna variante reale, pur risultando credibili.

L’esperimento sul padovano assume quindi un valore paradigmatico. Non serve soltanto a testare una curiosità linguistica, ma diventa uno strumento per osservare in modo concreto come funzionano i modelli generativi. Mostra che l’intelligenza artificiale è già in grado di abbattere molte barriere linguistiche e che, in prospettiva, potrà facilitare la comunicazione tra lingue diverse con sempre maggiore efficacia. Allo stesso tempo, evidenzia che questa capacità non equivale a una comprensione profonda, ma resta ancorata a meccanismi statistici.

Applicazioni di questo tipo potrebbero avere un impatto significativo anche sulla conservazione delle lingue minoritarie. La possibilità di addestrare modelli su dataset limitati, integrando contributi umani e tecniche di apprendimento adattivo, potrebbe consentire di documentare e preservare patrimoni linguistici altrimenti destinati a scomparire. Tuttavia, questo richiede un approccio progettuale attento, che tenga conto delle specificità culturali e delle variazioni locali, evitando di appiattire la ricchezza linguistica in una rappresentazione uniforme.