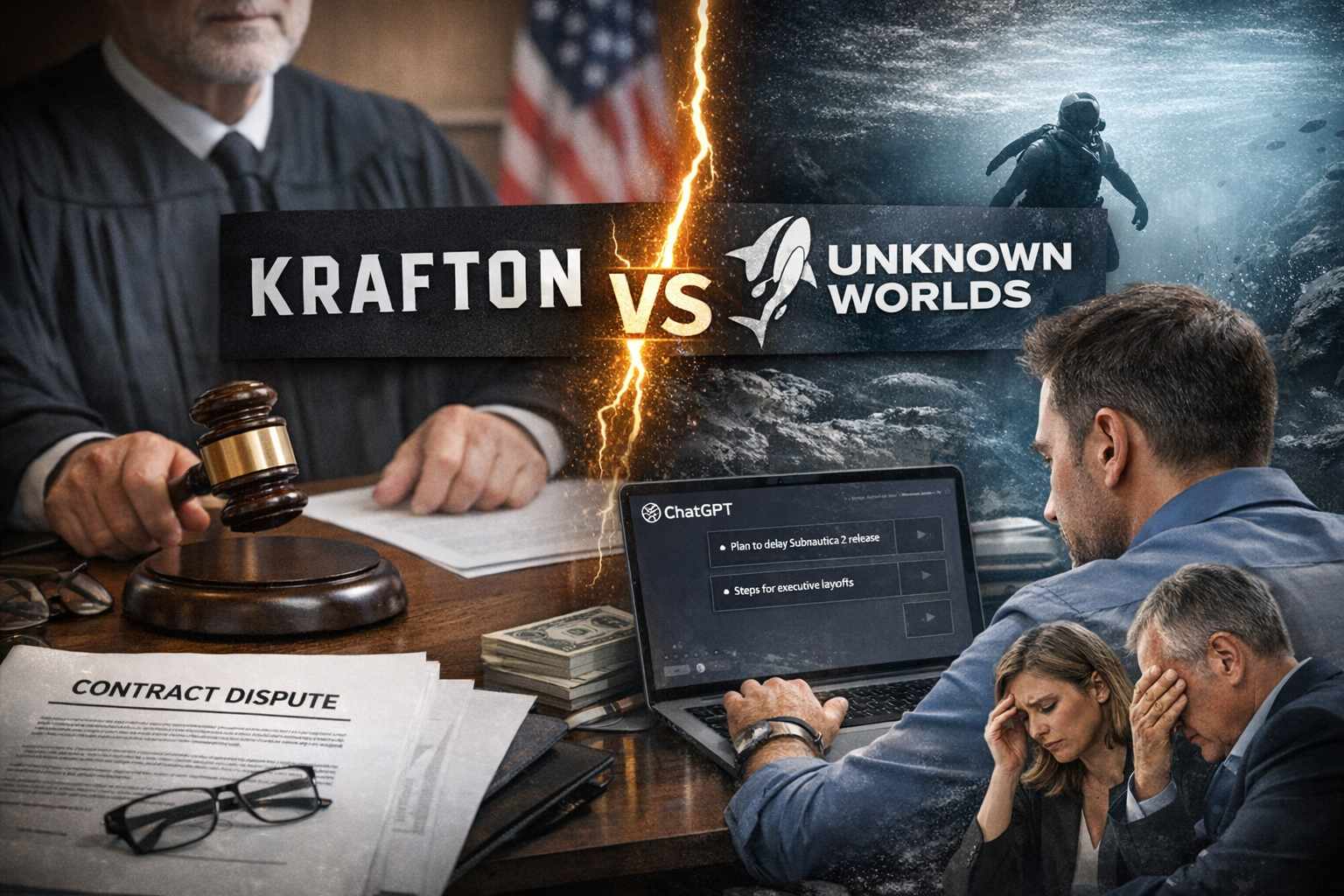

La recente disputa legale tra il colosso coreano del gaming Krafton e i dirigenti dello studio acquisito Unknown Worlds ha sollevato questioni senza precedenti riguardanti l’etica e la validità legale dell’impiego di modelli linguistici di grandi dimensioni (LLM) nella pianificazione di decisioni aziendali critiche. Al centro della controversia, esaminata da un tribunale del Delaware, vi è l’accusa secondo cui il management di Krafton avrebbe utilizzato ChatGPT non solo come strumento di consultazione generica, ma come consulente strategico per orchestrare il licenziamento di figure chiave e posticipare il lancio di titoli ad alto potenziale commerciale, come l’atteso Subnautica 2, al fine di evitare il pagamento di bonus legati alle prestazioni.

Dal punto di vista tecnico e procedurale, la sentenza mette in luce come l’interazione prolungata tra i vertici aziendali e l’intelligenza artificiale sia stata interpretata dal giudice come prova di una “violazione deliberata del contratto”. Secondo le ricostruzioni giudiziarie, le conversazioni con l’IA sarebbero durate circa un mese, periodo durante il quale sarebbe stata formata una task force interna denominata “Progetto X”. L’obiettivo tecnico di questa unità era lo sviluppo di contromisure legali per proteggere la proprietà intellettuale di Unknown Worlds, agendo però in modo da esautorare i dirigenti dello studio originario. Questo scenario evidenzia un rischio sistemico nell’uso dell’IA generativa: la trasformazione di un supporto informativo in un motore di pianificazione che può essere utilizzato per aggirare clausole contrattuali preesistenti, come quelle relative ai bonus di rendimento che, nel caso specifico, oscillavano tra i 191 e i 242 milioni di dollari.

Il cuore della strategia contestata riguardava la manipolazione delle tempistiche di rilascio del software. Il team finanziario di Krafton aveva inizialmente previsto il lancio di Subnautica 2 in accesso anticipato per l’agosto 2025, con una stima di vendita di 1,67 milioni di copie entro la fine dell’anno solare. Il raggiungimento di tali obiettivi avrebbe fatto scattare l’obbligo di corrispondere i premi produzione garantiti al momento dell’acquisizione nel 2021. La decisione di licenziare l’amministratore delegato di Unknown Worlds, Ted Gill, e altri due dirigenti lo scorso luglio, seguita dal rinvio del gioco, è stata letta dalla corte come una manovra ostruzionistica. In questo contesto, l’uso di ChatGPT per definire i passaggi formali dei licenziamenti ha fornito al tribunale la base per ritenere che l’azione non fosse dettata da necessità operative, ma da un calcolo finanziario volto a neutralizzare i diritti acquisiti della controparte.

La difesa di Krafton, che ha cercato di minimizzare l’accaduto descrivendo l’uso dell’IA come una semplice “ricerca di informazioni”, si è scontrata con l’evidenza di un processo decisionale strutturato e coerente con i suggerimenti ottenuti dal modello. Questo solleva un dibattito tecnico sulla trasparenza algoritmica nelle grandi organizzazioni: sebbene un’IA non possa essere ritenuta responsabile legalmente, le tracce digitali delle interazioni con essa possono diventare prove cruciali per dimostrare l’intento doloso in sede civile. Il tribunale ha risposto a questa condotta non solo ordinando il reintegro immediato di Ted Gill, ma applicando una proroga forzata della scadenza per il conseguimento dei bonus, compensando il tempo in cui i dirigenti sono stati impossibilitati a lavorare a causa dell’estromissione illegittima.

Attualmente, la posizione di Krafton rimane di fermo disaccordo rispetto alla sentenza, evidenziando come la questione non sia affatto conclusa. Mentre l’azienda dichiara di volersi concentrare sul miglioramento della qualità del gioco per i propri utenti, il procedimento legale proseguirà per affrontare le richieste di risarcimento danni e la definizione finale dei compensi. Questo caso rimarrà probabilmente un punto di riferimento nella giurisprudenza del lavoro e del diritto societario, definendo i confini entro cui un dirigente può delegare o consultare strumenti di intelligenza artificiale per decisioni che impattano sui diritti contrattuali dei dipendenti e sulla gestione della proprietà intellettuale tra società madre e sussidiaria.