La nuova tecnica di structured prompting presentata da Meta è stata progettata per migliorare in modo significativo le prestazioni degli LLM in compiti complessi come il code review, la verifica di patch e l’analisi semantica del codice senza esecuzione. L’approccio nasce per risolvere un problema concreto: molte attività di analisi su larga scala richiedono sandbox di esecuzione costose, mentre l’uso del ragionamento puro dei modelli spesso introduce errori, supposizioni non supportate e fenomeni di hallucination.

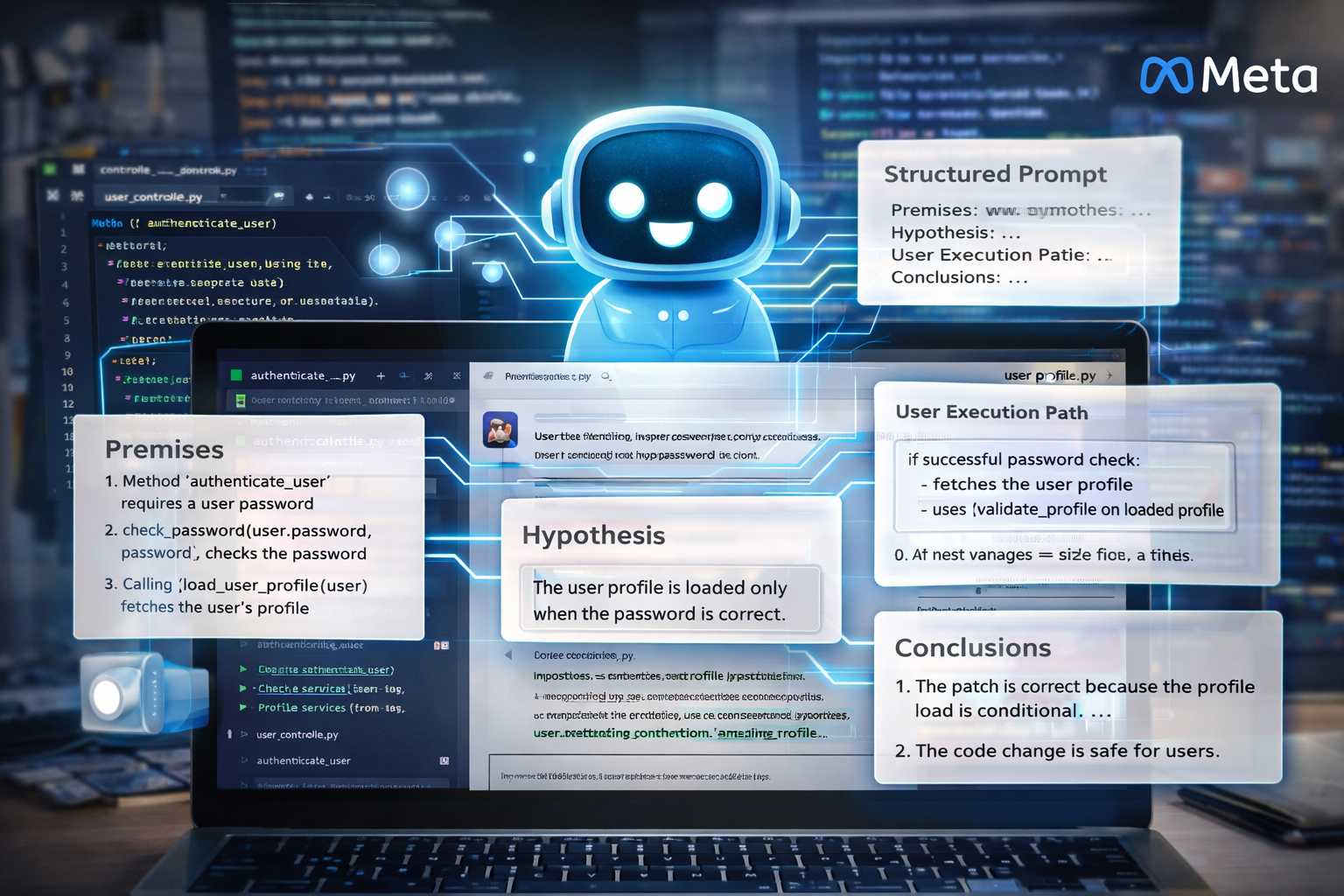

Il metodo introdotto da Meta, definito “semi-formal reasoning”, rappresenta una forma strutturata di prompting che obbliga il modello a costruire una sorta di certificato logico prima di fornire una risposta. In pratica, l’agente deve esplicitare le premesse, tracciare percorsi di esecuzione concreti e derivare conclusioni formali. Questo vincolo riduce la possibilità che il modello salti passaggi logici o produca inferenze non supportate, trasformando il processo di ragionamento in una sequenza verificabile.

La proposta di Meta si colloca tra il chain-of-thought libero e il ragionamento formale. Mentre il chain-of-thought consente al modello di “pensare ad alta voce” senza vincoli rigidi, il semi-formal reasoning introduce una struttura obbligatoria che impone la dichiarazione esplicita delle ipotesi e delle deduzioni. Questo approccio agisce come una forma di controllo interno del processo inferenziale, riducendo le ambiguità e migliorando la coerenza delle risposte, soprattutto nei contesti in cui il modello deve analizzare codice distribuito su più file o comprendere dipendenze complesse.

Le valutazioni sperimentali hanno mostrato miglioramenti rilevanti. In particolare, nei test di verifica dell’equivalenza delle patch, l’accuratezza è passata dal 78% all’88% su esempi curati, raggiungendo il 93% su patch generate da agenti in scenari reali. Anche nelle attività di code question answering l’accuratezza ha raggiunto circa l’87%, dimostrando una maggiore affidabilità nell’analisi semantica senza esecuzione del codice.

Uno degli aspetti più interessanti della tecnica riguarda la capacità degli LLM di operare su repository complessi senza eseguire il codice. Questa modalità, definita agentic code reasoning, richiede al modello di navigare file multipli, comprendere le dipendenze e costruire una rappresentazione semantica del comportamento del software. Il structured prompting fornisce la struttura necessaria per guidare il modello in questo processo, evitando deduzioni arbitrarie e favorendo un’analisi sistematica.

La tecnica non richiede modifiche al modello né fine-tuning. Si tratta di un intervento puramente a livello di prompt, il che significa che può essere applicata a modelli esistenti senza costi computazionali aggiuntivi. Questo è particolarmente rilevante in contesti enterprise, dove l’adozione di nuove tecniche deve bilanciare miglioramento delle prestazioni e costi operativi. La possibilità di migliorare significativamente il ragionamento semplicemente strutturando l’input rappresenta quindi un vantaggio strategico.

Il structured prompting introduce inoltre un cambiamento concettuale nel modo di utilizzare gli LLM. Invece di affidarsi alla generazione probabilistica token per token, il modello viene guidato verso una sequenza di inferenze controllate. Questo approccio ricorda, per analogia, i sistemi di prova formale, dove ogni passaggio deve essere giustificato. L’obiettivo non è rendere il modello formalmente verificabile, ma ridurre l’incertezza del ragionamento e aumentare la tracciabilità delle decisioni.

Un ulteriore elemento di interesse è l’impatto sulla progettazione degli agenti autonomi. Le attività di code review, bug detection e patch verification richiedono la capacità di ragionare su contesti estesi e di mantenere coerenza logica tra diversi passaggi. Il structured prompting fornisce una struttura che facilita questo tipo di ragionamento, rendendo più affidabile l’uso degli LLM in pipeline automatizzate di sviluppo software.