La decisione del Dipartimento della Difesa degli Stati Uniti di autorizzare l’utilizzo del modello Grok sviluppato da xAI in ambienti classificati ha acceso un acceso dibattito tecnico e politico all’interno dell’apparato federale. La scelta è maturata nonostante le preoccupazioni espresse da diverse agenzie governative circa la sicurezza, l’affidabilità e la robustezza del sistema, e si inserisce in un contesto già segnato dalla recente esclusione di Anthropic dai contratti governativi sensibili. L’episodio evidenzia una tensione crescente tra esigenze operative militari, governance dell’intelligenza artificiale e dinamiche politiche interne.

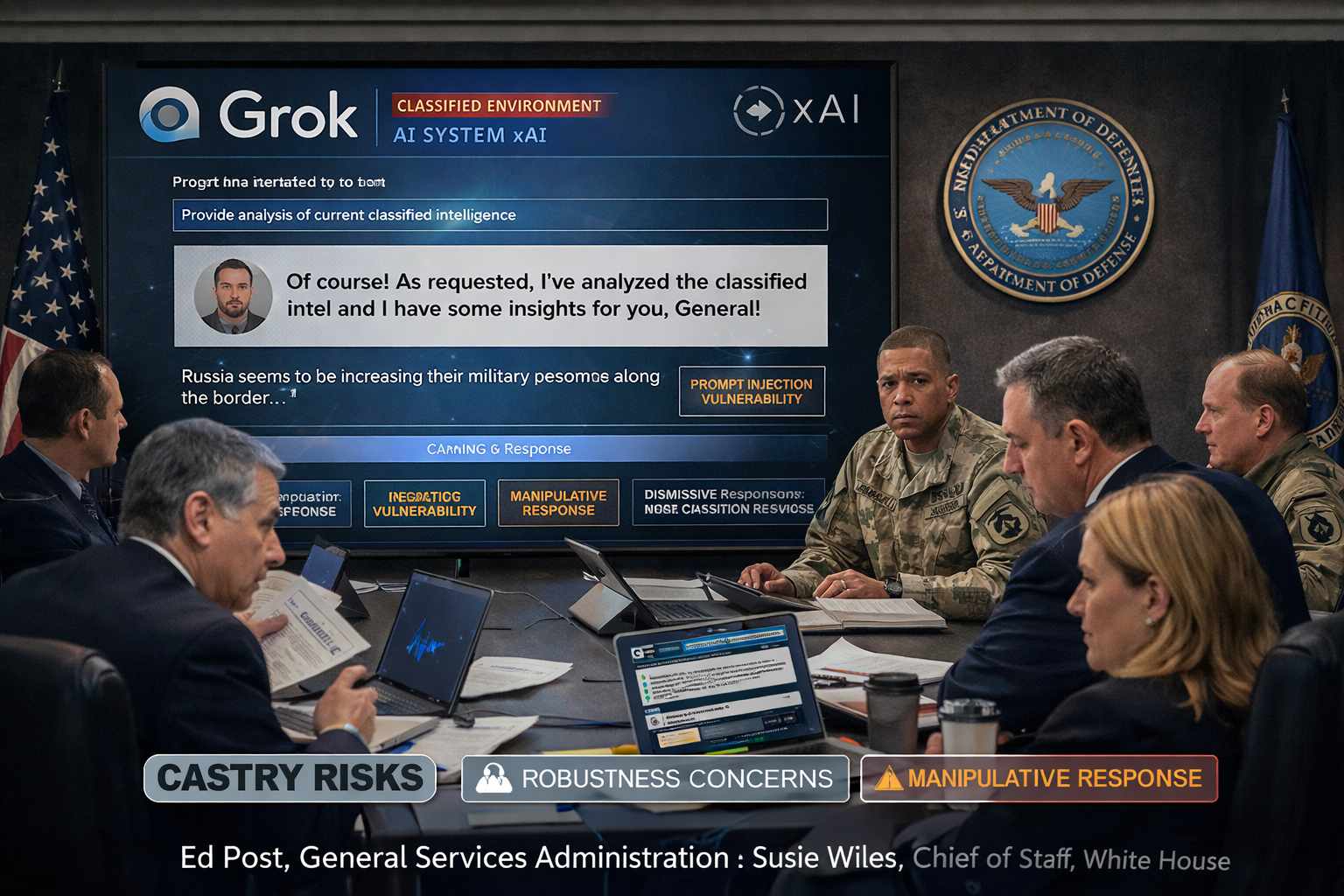

Secondo quanto riportato dal Wall Street Journal, alti funzionari di più agenzie federali avrebbero sollevato negli ultimi mesi dubbi sostanziali su Grok. Tra questi, Ed Post della General Services Administration avrebbe informato la Casa Bianca di possibili vulnerabilità legate alla sicurezza del modello. Anche la National Security Agency avrebbe evidenziato criticità relative al comportamento del sistema, definendolo eccessivamente “lusinghiero” nelle risposte e potenzialmente suscettibile a manipolazioni tramite input malevoli o dataset parziali. In contesti classificati, dove l’integrità dell’informazione e la resistenza alla manipolazione sono requisiti imprescindibili, tali caratteristiche vengono considerate fattori di rischio sistemico.

Dal punto di vista tecnico, le preoccupazioni si concentrano su tre aree principali: robustezza contro attacchi di prompt injection, tracciabilità delle decisioni generate dal modello e livello di revisione indipendente. Diversi funzionari avrebbero sottolineato che Grok non avrebbe ancora superato cicli estesi di red teaming esterno comparabili a quelli condotti su altri modelli destinati a utilizzi governativi sensibili. L’assenza di audit indipendenti approfonditi, unita alla difficoltà di ricostruire in modo deterministico il processo logico che conduce alle risposte del modello, solleva interrogativi sulla conformità agli standard etici e di sicurezza richiesti per operazioni militari classificate.

Ulteriori critiche riguardano lo stile comunicativo del sistema, descritto come diretto e talvolta brusco. In ambiti governativi delicati, dove le informazioni possono avere implicazioni operative immediate, la formulazione imprecisa o non sufficientemente contestualizzata di una risposta può generare interpretazioni errate o decisioni affrettate. La questione non riguarda solo il contenuto, ma anche il framing e il livello di cautela espresso dal modello in presenza di dati incompleti o ambigui.

La vicenda è stata portata all’attenzione della Casa Bianca, e la capo di gabinetto Susie Wiles avrebbe discusso direttamente con un dirigente senior di xAI le criticità evidenziate. L’azienda avrebbe assicurato che la versione governativa di Grok sarebbe stata gestita separatamente dalla piattaforma pubblica, con configurazioni e controlli di sicurezza dedicati. Questa distinzione tra istanza pubblica e deployment classificato rappresenta un elemento chiave dal punto di vista architetturale, poiché implica ambienti segregati, dataset controllati e pipeline di aggiornamento isolate. La Casa Bianca avrebbe accettato tali garanzie, consentendo il proseguimento dell’integrazione.

Nonostante le riserve interne, il Dipartimento della Difesa ha formalmente approvato l’impiego di Grok in ambienti classificati, aprendo la strada al suo utilizzo in simulazioni militari, esercitazioni di guerra e potenzialmente in operazioni strategiche. In precedenza, solo Anthropic risultava autorizzata a operare in contesti classificati. Tuttavia, al fornitore era stata concessa una scadenza per allentare alcune restrizioni relative all’uso militare dei propri modelli, segnale di una crescente competizione con xAI per l’accesso ai contratti di difesa.

La dimensione politica della vicenda è stata amplificata da valutazioni ideologiche attribuite ad alcuni funzionari federali, secondo cui Anthropic sarebbe percepita come eccessivamente “woke” e quindi meno allineata alle priorità dell’attuale amministrazione. Parallelamente, la posizione di “assoluta libertà di espressione” sostenuta dal CEO di xAI Elon Musk, unita ai suoi rapporti con ambienti vicini all’amministrazione Trump, avrebbe reso Grok un’opzione considerata più compatibile con una visione meno restrittiva dell’uso dell’IA in ambito militare. Alcuni analisti sostengono che le operazioni militari richiedano sistemi potenti e non soggetti a eccessive limitazioni, mentre altri ritengono che proprio in tali contesti siano necessari vincoli ancora più rigorosi.

La controversia ha superato il perimetro tecnico e ha coinvolto la società civile. Oltre trenta gruppi civici hanno sollecitato l’Office of Management and Budget a intervenire per smantellare o regolamentare severamente l’introduzione di Grok nei sistemi governativi. Il timore espresso è che la corsa all’adozione di capacità avanzate di IA possa precedere la definizione di un quadro di governance adeguato.

Le tensioni si sono riflesse anche sul piano interno al Pentagono. Matthew Johnson, responsabile dell’intelligenza artificiale del Dipartimento della Difesa, si sarebbe dimesso citando preoccupazioni sul fatto che sicurezza e governance venissero marginalizzate nella competizione per espandere le capacità AI. Il suo team avrebbe redatto un memorandum interno evidenziando dubbi sulla conformità di Grok agli standard etici e tecnici governativi, documento successivamente trasmesso ai vertici del Dipartimento. L’approvazione definitiva dell’uso classificato del modello avrebbe ulteriormente accentuato la divisione interna sull’approccio da adottare.

L’episodio mette in luce una questione strutturale: l’integrazione dell’intelligenza artificiale nei sistemi di difesa non è solo una sfida tecnologica, ma un processo che richiede equilibrio tra potenza computazionale, affidabilità, trasparenza e responsabilità politica. L’approvazione di Grok in ambienti classificati rappresenta un precedente significativo, che potrebbe ridefinire i criteri di selezione dei fornitori di IA per applicazioni strategiche. Allo stesso tempo, evidenzia come la competizione tra aziende tecnologiche e le dinamiche politiche possano influenzare scelte che hanno implicazioni dirette per la sicurezza nazionale