La crescente diffusione dei bot alimentati da intelligenza artificiale nei social network sta spingendo le piattaforme a rivedere i propri meccanismi di autenticazione e controllo delle identità digitali. In questo scenario si inserisce la decisione di Reddit di introdurre un sistema di verifica degli account mirato a distinguere gli utenti reali dalle attività automatizzate, con l’obiettivo di preservare l’autenticità delle conversazioni e limitare l’influenza dei contenuti generati automaticamente. L’iniziativa rappresenta una risposta diretta alla crescita dei bot AI, sempre più sofisticati e difficili da individuare attraverso i tradizionali strumenti di moderazione.

Secondo quanto riportato nell’articolo di riferimento, Reddit sta sviluppando un sistema in grado di identificare comportamenti sospetti e richiedere verifiche mirate agli account che potrebbero essere gestiti da intelligenze artificiali. La piattaforma prevede inoltre l’introduzione di etichette specifiche per i bot autorizzati e nuovi strumenti per migliorare la trasparenza delle interazioni tra utenti.

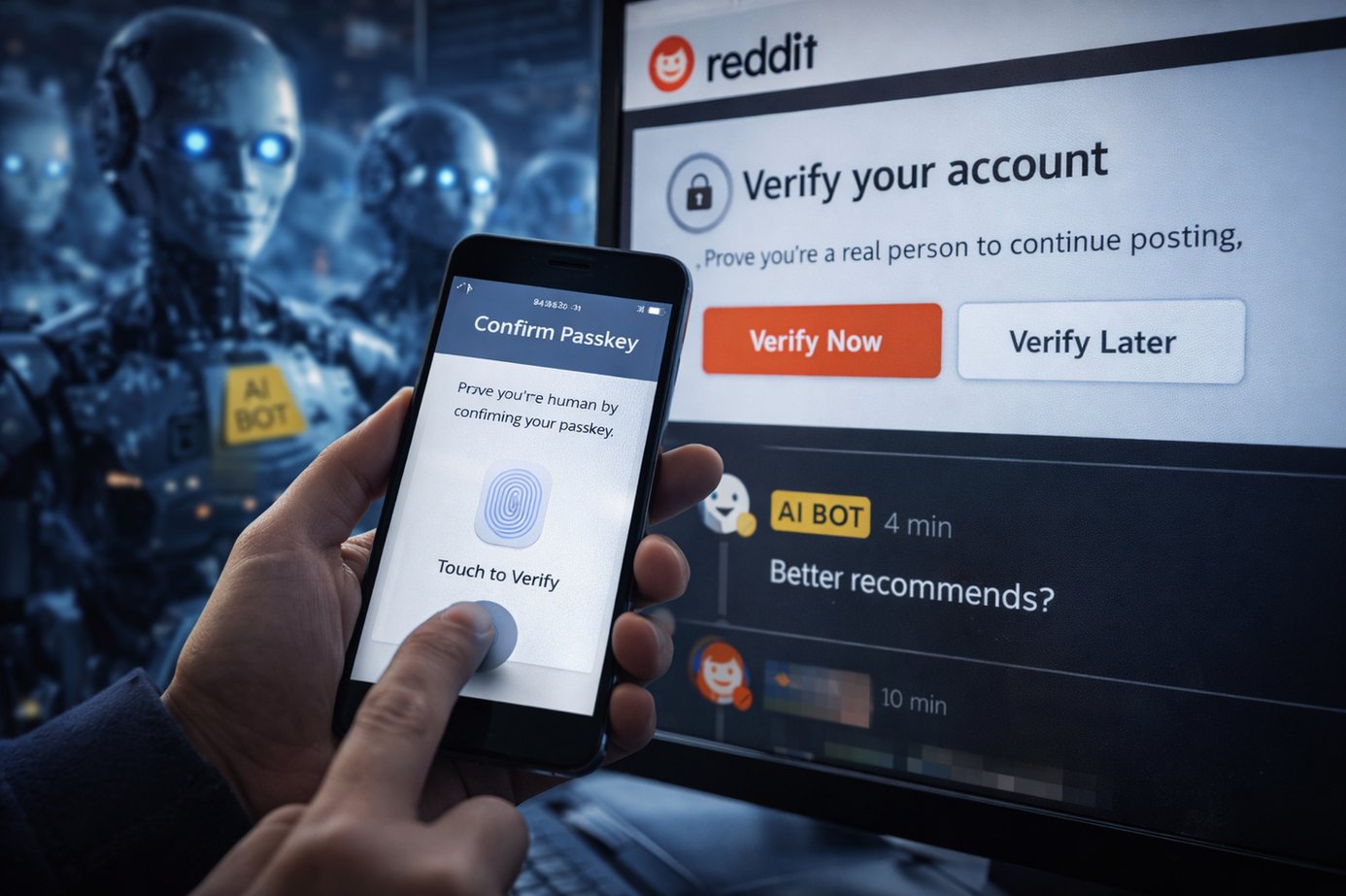

La strategia adottata non si basa su una verifica generalizzata per tutti gli utenti, ma su un modello selettivo. Gli account che mostrano comportamenti anomali, come attività automatizzata o schemi di pubblicazione coordinati, possono essere sottoposti a un processo di conferma dell’identità umana. Questo approccio consente di mantenere il modello di partecipazione aperta tipico di Reddit, evitando l’introduzione di obblighi universali che potrebbero compromettere l’anonimato, uno degli elementi centrali della piattaforma.

Le nuove misure includono anche un sistema di classificazione dei bot. Gli account automatizzati utilizzati per scopi legittimi, come moderazione, aggregazione di contenuti o servizi informativi, potranno essere identificati tramite etichette dedicate, mentre quelli non dichiarati o sospetti saranno soggetti a verifiche. L’obiettivo è creare una distinzione chiara tra automazione utile e attività manipolative, riducendo il rischio che contenuti generati automaticamente influenzino il dibattito senza trasparenza.

La verifica della “umanità” degli account potrebbe avvalersi di strumenti di autenticazione esterni, come passkey, sistemi biometrici o altri metodi di verifica gestiti da terze parti, mantenendo al contempo la separazione tra identità reale e profilo Reddit. Questa impostazione riflette la necessità di bilanciare sicurezza e privacy, evitando che il processo di verifica comporti la raccolta diretta di dati sensibili da parte della piattaforma.