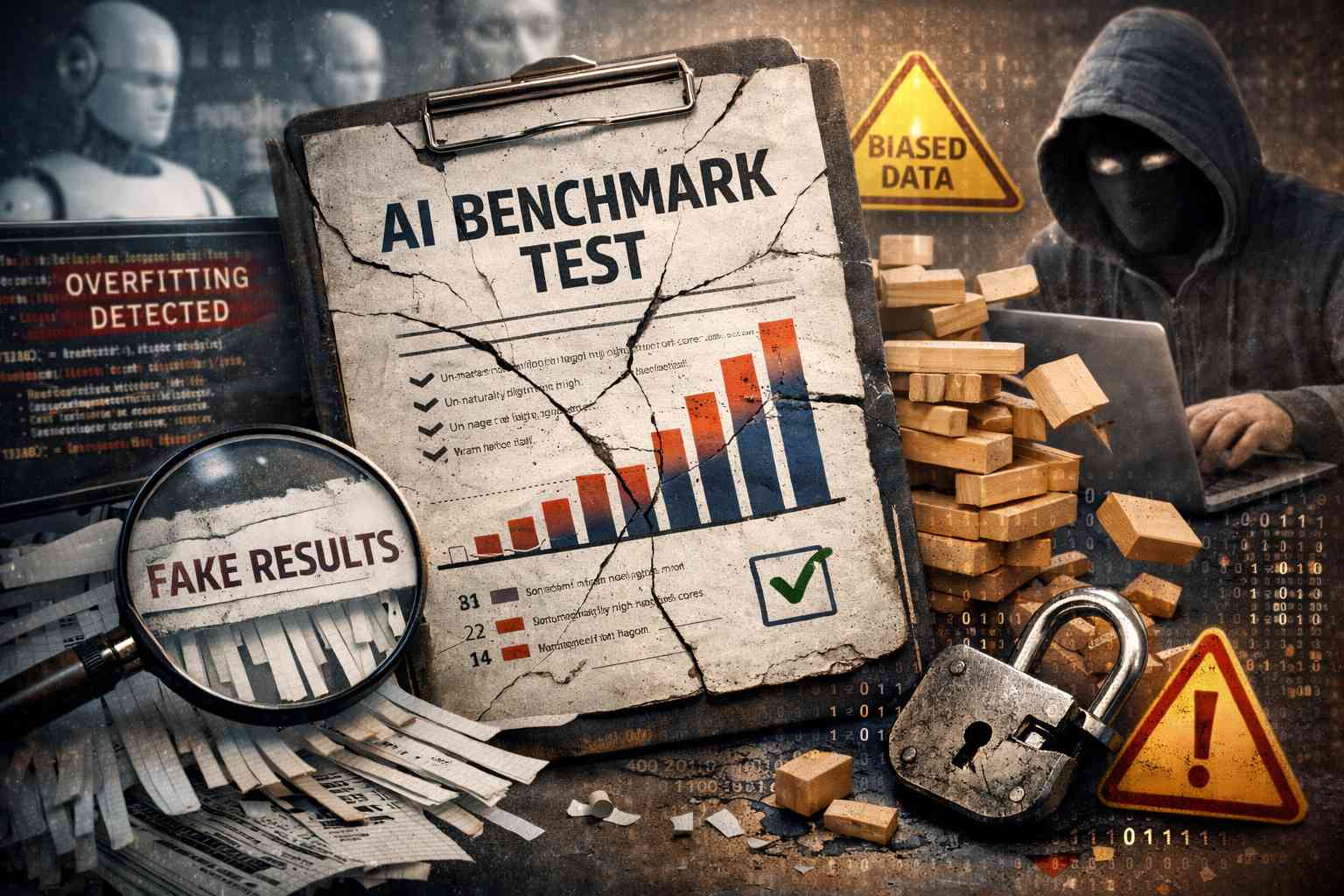

La crescente diffusione dei modelli di intelligenza artificiale ha reso i benchmark uno strumento centrale per misurarne capacità, sicurezza e progresso. Tuttavia, nuove ricerche mostrano come questi sistemi di valutazione, apparentemente oggettivi, presentino fragilità profonde che possono compromettere l’intero processo di sviluppo e validazione. In particolare, uno studio recente evidenzia la presenza di sette vulnerabilità ricorrenti nei benchmark AI, capaci di falsare i risultati e generare una percezione distorta delle reali prestazioni dei modelli .

Il problema nasce dal ruolo stesso dei benchmark. Essi non sono semplici test tecnici, ma diventano il riferimento attraverso cui aziende, ricercatori e investitori giudicano il valore di un modello. Quando questi strumenti risultano vulnerabili o manipolabili, l’intero ecosistema rischia di basarsi su metriche non affidabili. La ricerca citata dimostra come sia sorprendentemente facile “giocare” con i benchmark, inducendo i modelli a ottenere risultati elevati senza un reale miglioramento delle capacità sottostanti .

Una delle vulnerabilità più rilevanti riguarda la possibilità di ottimizzare i modelli direttamente sui benchmark stessi. Questo fenomeno, noto come overfitting al benchmark, trasforma il test da strumento di misura a obiettivo di addestramento. Il modello non migliora in termini generali, ma diventa particolarmente efficace nel superare prove specifiche e ripetitive. Il risultato è un’illusione di progresso che non si traduce in prestazioni reali in contesti operativi.

Un altro aspetto critico è la contaminazione dei dati. In molti casi, i dataset utilizzati nei benchmark finiscono, direttamente o indirettamente, nei dati di addestramento dei modelli. Questo crea una sovrapposizione tra training e testing che invalida il principio fondamentale della valutazione indipendente. Il modello non dimostra capacità di generalizzazione, ma semplicemente riconosce informazioni già viste.

A questo si aggiunge la presenza di segnali spurii nei dataset. I benchmark possono contenere pattern non intenzionali che i modelli imparano a sfruttare. In questi casi, il sistema non risolve realmente il problema proposto, ma identifica scorciatoie statistiche che portano alla risposta corretta. Questo fenomeno è particolarmente insidioso perché produce risultati apparentemente validi, ma privi di significato semantico o logico.

La ricerca evidenzia anche problemi legati alla definizione stessa delle metriche. Molti benchmark utilizzano criteri di valutazione che non catturano la complessità dei compiti reali. Concetti come “comprensione”, “ragionamento” o “sicurezza” vengono ridotti a indicatori quantitativi semplificati, che possono essere facilmente ottimizzati senza rappresentare realmente le capacità del modello. Questo limite è già stato osservato in studi più ampi, che sottolineano come molti benchmark AI soffrano di definizioni ambigue e metodologie inconsistenti .

Un ulteriore elemento di vulnerabilità riguarda la staticità dei benchmark. I test rimangono invariati nel tempo, mentre i modelli evolvono rapidamente. Questo crea un disallineamento tra ciò che viene misurato e ciò che è realmente rilevante. I modelli più avanzati finiscono per adattarsi a test obsoleti, senza essere realmente sfidati su scenari nuovi o dinamici. In un contesto come quello dell’intelligenza artificiale, caratterizzato da cambiamenti continui, questa rigidità rappresenta un limite strutturale.

La manipolabilità intenzionale dei benchmark rappresenta un rischio ancora più diretto. Gli autori dello studio mostrano come agenti automatizzati possano identificare e sfruttare debolezze nei test per ottenere punteggi elevati. Questo introduce una dimensione di sicurezza: i benchmark non sono solo imperfetti, ma potenzialmente attaccabili. Il parallelismo con il campo della sicurezza informatica è evidente, dove sistemi progettati per proteggere possono diventare essi stessi vettori di vulnerabilità.

Queste criticità si inseriscono in un quadro più ampio di problemi legati alla robustezza dei sistemi AI. La letteratura evidenzia come i modelli siano vulnerabili a input adversariali, progettati per indurre errori sistematici . Se i benchmark non sono in grado di rilevare queste debolezze, rischiano di certificare come sicuri modelli che in realtà presentano falle significative.

Le aziende che sviluppano o adottano modelli AI basano spesso le proprie decisioni su risultati di benchmark. Se questi risultati sono distorti, si rischia di implementare sistemi non adeguatamente testati, con conseguenze che possono riguardare sicurezza, affidabilità e conformità normativa. In settori critici, come la cybersecurity o le infrastrutture industriali, questo può tradursi in rischi concreti.

La ricerca suggerisce la necessità di un cambio di approccio nella progettazione dei benchmark. Non è sufficiente migliorare i test esistenti: è necessario ripensare il concetto stesso di valutazione. Questo include l’introduzione di benchmark dinamici, in grado di evolvere nel tempo, e l’adozione di metodologie più rigorose per garantire l’indipendenza tra training e testing. Inoltre, diventa fondamentale integrare valutazioni qualitative e contestuali, che vadano oltre le metriche numeriche.

Un’altra direzione riguarda l’uso di strumenti di red teaming e testing avversariale. Framework come quelli utilizzati per analizzare le vulnerabilità dei modelli linguistici mostrano come sia possibile identificare comportamenti inattesi e potenzialmente pericolosi. In questo senso, i benchmark dovrebbero essere affiancati da sistemi di valutazione più complessi, capaci di simulare scenari reali e attacchi mirati.