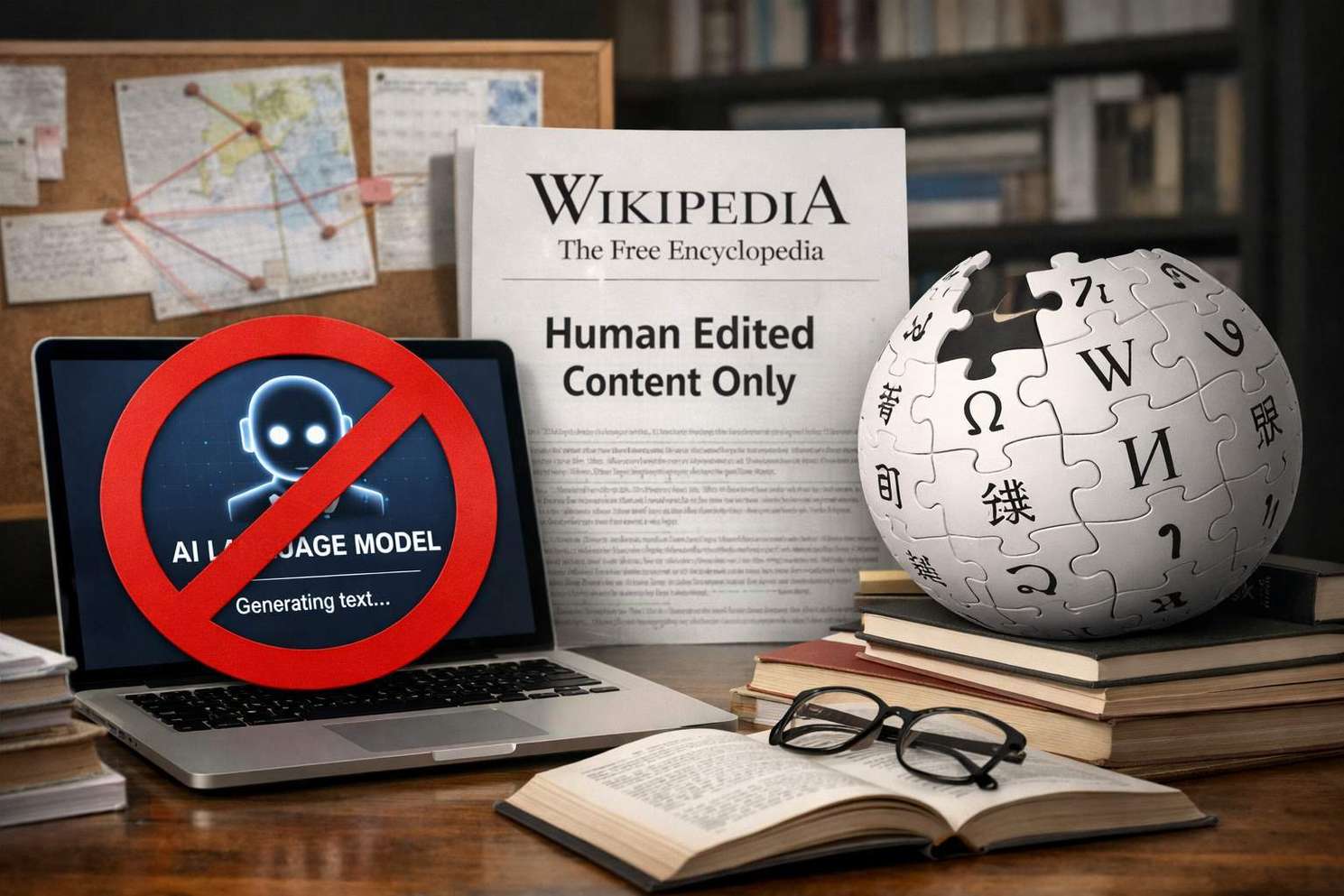

La crescita dell’intelligenza artificiale generativa sta modificando profondamente il modo in cui vengono prodotti contenuti informativi online, ma proprio questa trasformazione ha spinto Wikipedia a introdurre una delle decisioni più significative della sua storia recente: il divieto di utilizzare testi generati automaticamente per scrivere o riscrivere le voci dell’enciclopedia. La scelta nasce dall’esigenza di preservare il modello collaborativo umano su cui si fonda la piattaforma e di proteggere l’affidabilità delle informazioni, considerata sempre più sotto pressione in un ecosistema digitale dominato da contenuti generati automaticamente.

La comunità degli editor ha approvato una linea guida che limita in modo esplicito l’uso dell’intelligenza artificiale nella produzione del testo enciclopedico, introducendo regole più restrittive rispetto al passato e rafforzando il controllo umano sul processo editoriale.

La decisione si inserisce in un contesto in cui la diffusione dei modelli linguistici ha portato a un aumento significativo di contenuti generati automaticamente, spesso caratterizzati da problemi di accuratezza, citazioni inesistenti o interpretazioni non supportate da fonti verificabili. Le linee guida di Wikipedia si basano infatti su tre pilastri storici – verificabilità, neutralità e affidabilità delle fonti – che risultano difficili da garantire quando il testo viene prodotto da sistemi generativi. In particolare, i modelli AI possono generare affermazioni plausibili ma non supportate da riferimenti reali, un fenomeno noto come “hallucination”, incompatibile con la metodologia enciclopedica della piattaforma.

La nuova impostazione non rappresenta un rifiuto totale dell’intelligenza artificiale, ma piuttosto una ridefinizione del suo ruolo. L’AI viene ammessa come strumento di supporto, ad esempio per traduzioni o revisioni minori, purché il contenuto non introduca nuove informazioni e sia comunque sottoposto a controllo umano. Questo approccio riflette la volontà di mantenere la centralità dell’editor umano come garante della qualità, evitando che la produzione automatica comprometta l’affidabilità complessiva del progetto. Anche la comunità ha sottolineato la necessità di distinguere tra assistenza tecnica e generazione diretta di contenuti, consentendo solo la prima e vietando la seconda.

Il dibattito interno a Wikipedia è maturato nel corso degli ultimi anni, durante i quali sono stati segnalati sempre più articoli con caratteristiche tipiche dei modelli linguistici, come citazioni non pertinenti, strutture linguistiche standardizzate o incongruenze stilistiche. In risposta a questo fenomeno, la comunità ha già introdotto strumenti per identificare e rimuovere contenuti sospetti, fino ad arrivare alla definizione di regole più stringenti sull’utilizzo dell’intelligenza artificiale.

La scelta assume particolare rilevanza se si considera il ruolo centrale di Wikipedia nell’ecosistema informativo globale. Molti sistemi di intelligenza artificiale utilizzano infatti contenuti enciclopedici come base per l’addestramento o come riferimento per la validazione delle informazioni, rendendo la qualità dei dati presenti sulla piattaforma ancora più critica. Preservare la natura umana e collaborativa dell’enciclopedia diventa quindi anche una strategia per evitare un circolo vizioso in cui contenuti generati automaticamente alimentano altri sistemi AI, amplificando eventuali errori.