Il settore dei grandi modelli linguistici (LLM) sta assistendo a una nuova fase di rottura tecnologica con l’annuncio del sistema MiMo-V2-Pro di Xiaomi. Questa nuova iterazione non si limita a un semplice incremento dei parametri, ma introduce affinamenti strutturali che posizionano l’efficienza computazionale al centro della sfida verso i modelli di frontiera come GPT-5.2 di OpenAI e Claude 4.6 Opus di Anthropic. La strategia di Xiaomi si focalizza sul superamento dei colli di bottiglia tradizionali legati alla gestione dei contesti lunghi e alla latenza di inferenza, utilizzando un approccio ibrido che ottimizza l’allocazione delle risorse hardware senza sacrificare la profondità del ragionamento logico.

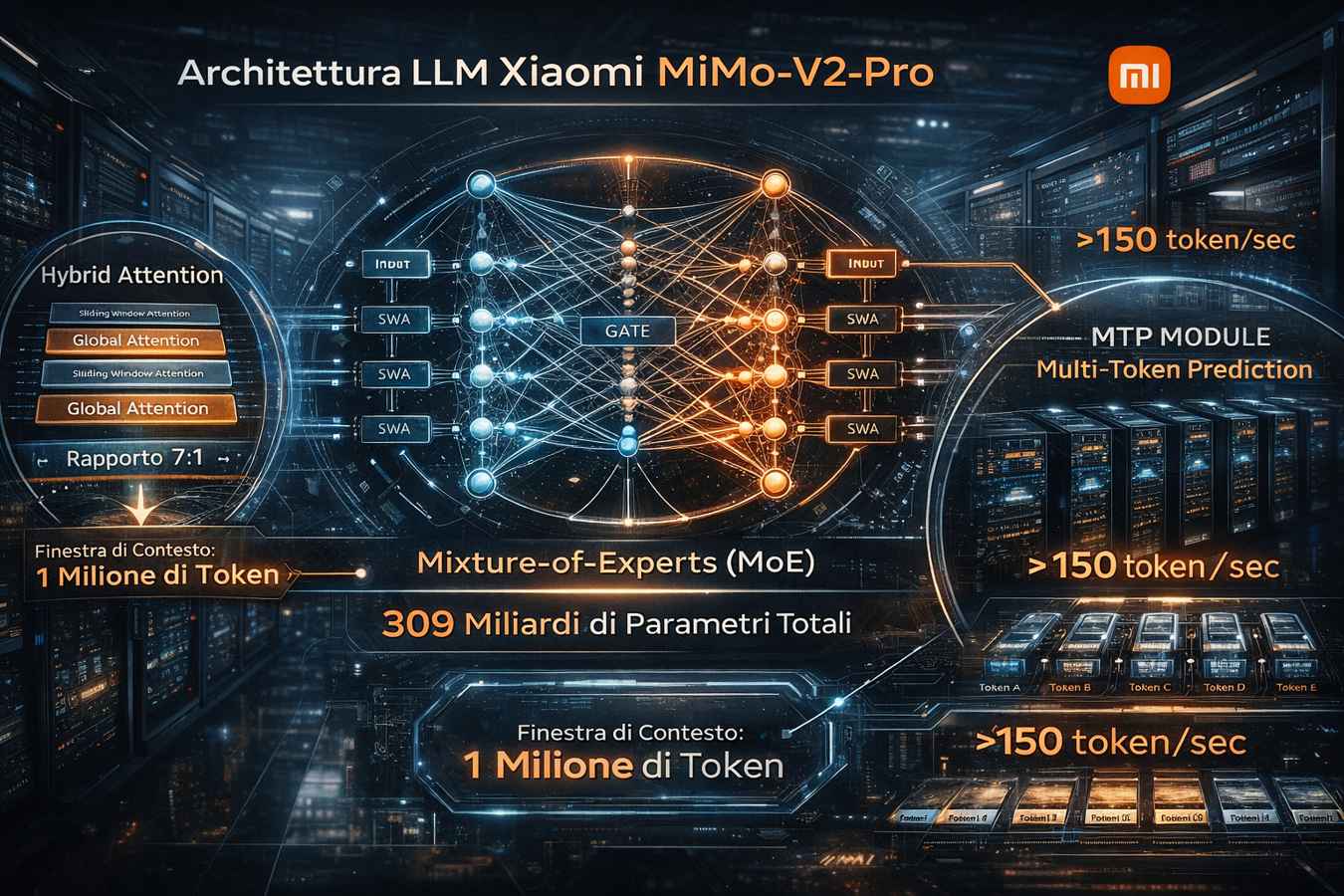

Il cuore tecnologico del MiMo-V2-Pro risiede nella sua raffinata architettura Mixture-of-Experts (MoE), che gestisce un totale di circa 309 miliardi di parametri, di cui solo una frazione, stimata intorno ai 15-20 miliardi, viene attivata per ogni singolo token. L’innovazione più significativa rispetto alla precedente versione “Flash” riguarda il meccanismo di attenzione. Il modello implementa un sistema di Hybrid Attention che alterna strati di Sliding Window Attention (SWA) a strati di Global Attention con un rapporto di 7:1. Questa configurazione permette al modello di mantenere una finestra di contesto estremamente vasta, fino a un milione di token, riducendo drasticamente il carico sulla memoria KV-cache. Mentre la Sliding Window si occupa di elaborare le relazioni locali con una finestra dinamica, lo strato globale agisce come un integratore di memoria a lungo termine, permettendo al sistema di non perdere il filo logico anche in documenti di proporzioni enciclopediche.

Un altro pilastro fondamentale delle prestazioni del MiMo-V2-Pro è l’integrazione del Multi-Token Prediction (MTP). A differenza dei decoder tradizionali che generano un token alla volta in modo sequenziale, questa architettura utilizza moduli leggeri e densi per prevedere simultaneamente più token futuri. In fase di inferenza, questi moduli operano come modelli “draft” interni per una decodifica speculativa accelerata, portando la velocità di generazione a superare i 150 token al secondo su configurazioni hardware ottimizzate. Questo incremento prestazionale è supportato da un protocollo di addestramento denominato Multi-Teacher Online Policy Distillation (MOPD). Attraverso questo metodo, il modello apprende non solo da dati statici, ma tramite un processo di distillazione continua da modelli “insegnanti” specializzati in domini verticali come il coding avanzato e la risoluzione di problemi matematici complessi.

Le implicazioni di questa architettura si riflettono direttamente nei benchmark di settore. Nei test di ragionamento agentico e nello sviluppo software, come SWE-Bench e ClawEval, il MiMo-V2-Pro ha dimostrato una capacità di esecuzione che rivaleggia con i sistemi proprietari più costosi, riducendo però i costi operativi di oltre il 90%. La riduzione del tasso di allucinazione, sceso drasticamente rispetto alle versioni precedenti, suggerisce che il sistema di attenzione ibrida riesca a filtrare meglio il rumore informativo all’interno di contesti massivi. L’approccio di Xiaomi delinea quindi un futuro in cui la potenza dei modelli di classe “frontier” non dipenderà più solo dalla scala bruta dei parametri, ma dalla capacità di orchestrare in modo intelligente micro-moduli specializzati e tecniche di compressione dell’attenzione, rendendo l’intelligenza artificiale di alto livello accessibile su una scala commerciale e infrastrutturale senza precedenti.