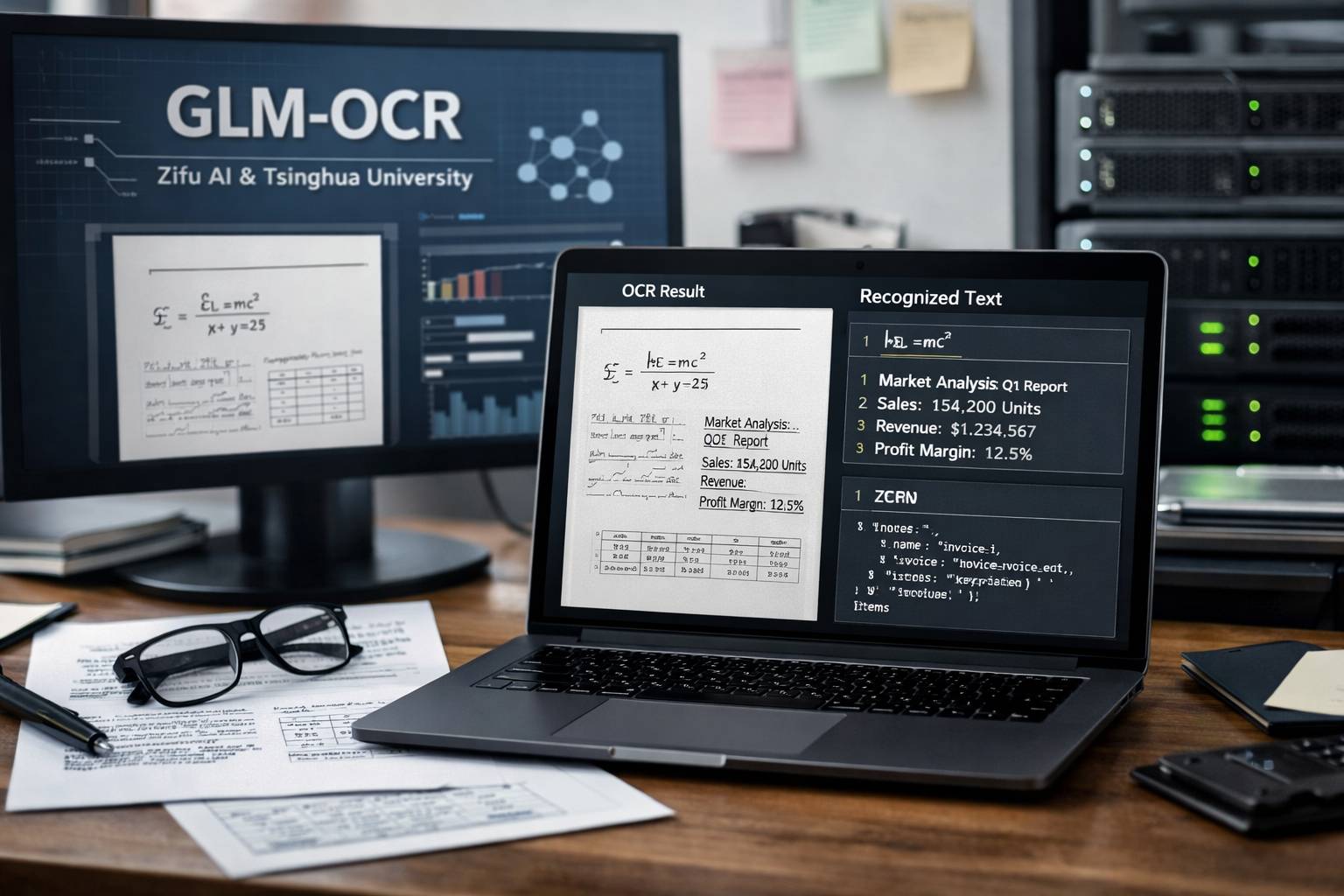

La sfida principale nell’integrazione dei modelli di linguaggio visivo (VLM) all’interno di flussi di lavoro aziendali e dispositivi con risorse limitate risiede nel bilanciamento tra l’accuratezza del riconoscimento e l’onere computazionale. Mentre i modelli multimodali di grandi dimensioni eccellono nella comprensione semantica, la loro latenza operativa ne preclude spesso l’uso in scenari di elaborazione in tempo reale. Per rispondere a questa esigenza, i ricercatori di Zifu AI e dell’Università di Tsinghua hanno sviluppato GLM-OCR, un modello leggero da 900 milioni di parametri che ottimizza la pipeline di riconoscimento ottico dei caratteri attraverso un approccio strutturale innovativo. L’architettura si basa su una sinergia tra un codificatore visivo CogViT da 0,4 miliardi di parametri, un decodificatore linguistico GLM da 0,5 miliardi e un modulo di collegamento cross-modale progettato per trasferire le informazioni visive nello spazio latente del linguaggio con il minimo dispendio energetico.

Il nucleo dell’innovazione tecnica di GLM-OCR risiede nell’implementazione della previsione multi-token (Multi-Token Prediction – MTP), una metodologia che scardina l’approccio autoregressivo tradizionale dei Large Language Models. Invece di generare un singolo token per ogni passaggio computazionale, GLM-OCR è addestrato per prevedere sequenze di dieci token simultaneamente, una scelta strategica dettata dalla natura deterministica dell’OCR, dove il testo segue schemi strutturali prevedibili. Questo meccanismo permette al sistema di generare mediamente 5,2 token per ogni iterazione durante la fase di inferenza, traducendosi in un incremento della velocità di elaborazione di circa il 50%. Grazie a una gestione oculata della condivisione dei parametri, questo aumento prestazionale viene ottenuto senza un incremento proporzionale dell’occupazione di memoria, rendendo il modello ideale per l’implementazione su server con GPU limitate o dispositivi edge.

Oltre all’efficienza nella generazione, GLM-OCR introduce una pipeline di elaborazione a due fasi che abbandona la scansione lineare da sinistra a destra in favore di una comprensione contestuale del layout. Nella fase iniziale, il modello sfrutta PP-DocLayout-V3 per identificare e mappare le regioni significative del documento, distinguendo tra blocchi di testo, tabelle, formule matematiche e immagini. Successivamente, il sistema attiva una fase di riconoscimento parallelo per regione, elaborando simultaneamente i diversi segmenti individuati. Questo metodo non solo accelera i tempi di risposta, ma garantisce una precisione superiore nel ripristino della struttura di documenti complessi, come quelli contenenti più colonne o tabelle annidate. La capacità di output strutturato in formati Markdown o JSON facilita inoltre l’integrazione immediata dei dati estratti in database aziendali o sistemi di gestione della conoscenza.

Le prestazioni di GLM-OCR sono state validate attraverso rigorosi benchmark pubblici, dove il modello ha dimostrato una superiorità marcata nel riconoscimento di formule (UniMERNet) e nell’estrazione di informazioni chiave (KIE), ottenendo punteggi di rilievo anche in contesti di testi scritti a mano. Sebbene mantenga un margine di miglioramento nel riconoscimento di tabelle estremamente dense rispetto a modelli specializzati come MinerU 2.5, la sua versatilità lo rende una soluzione completa per la trascrizione e la strutturazione documentale. Essendo pienamente compatibile con i principali framework di ottimizzazione come vLLM e LLaMA-Factory, GLM-OCR si propone non solo come un avanzamento teorico, ma come uno strumento pronto per la produzione, capace di processare quasi due pagine PDF al secondo con costi operativi estremamente ridotti nel modello Model as a Service.