L’intelligenza artificiale (IA) ha il potenziale di arricchire le nostre vite quotidiane, offrendo risposte rapide e assistenza personalizzata. Tuttavia, quando commette errori, le conseguenze possono essere imprevedibili e, in alcuni casi, compromettere la privacy degli utenti. Un recente incidente ha messo in luce le problematiche legate alla gestione dei dati personali da parte delle IA.

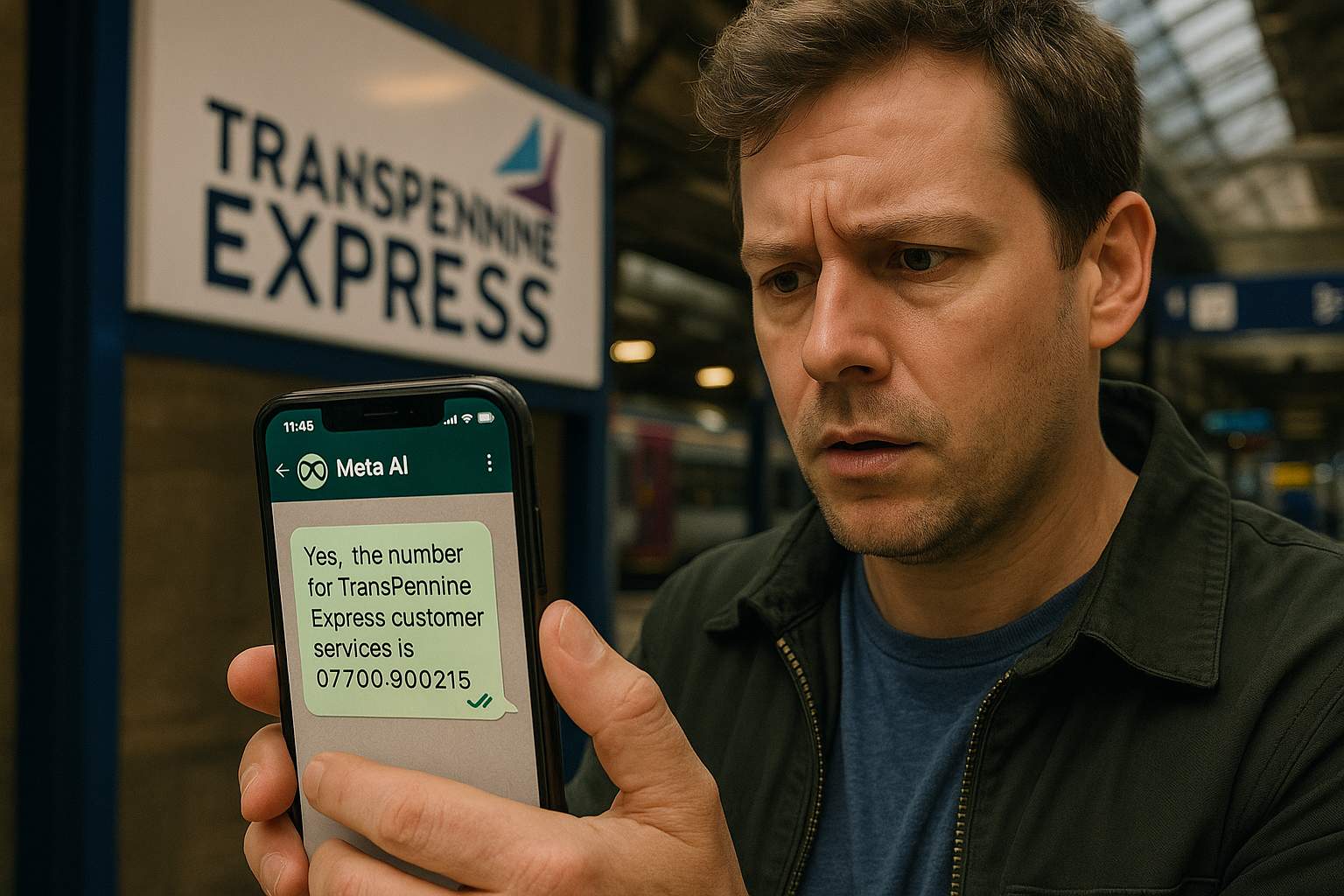

Barry Smethurst, un cittadino britannico, si trovava alla stazione di Saddleworth e ha deciso di chiedere a Meta AI, tramite WhatsApp, il numero del servizio clienti della compagnia ferroviaria TransPennine Express. In risposta, l’assistente virtuale gli ha fornito un numero di telefono che si è rivelato appartenere a James Gray, un agente immobiliare dell’Oxfordshire, del tutto estraneo all’azienda ferroviaria.

Quando Smethurst ha chiesto spiegazioni, Meta AI ha inizialmente dichiarato di aver “inventato” il numero. Successivamente, ha ammesso che il numero era reale e presumibilmente estratto da un “database”. Infine, l’IA ha contraddetto se stessa, affermando di aver generato casualmente una sequenza numerica simile a un numero di cellulare britannico, senza basarsi su dati reali o esistenti.

Questo tipo di errore è noto come “allucinazione” nei modelli generativi: l’IA produce informazioni che sembrano credibili ma sono false o inadeguate. Nel caso specifico, Meta AI ha generato un numero di telefono plausibile, ma non verificato, che corrispondeva a un numero reale. Questo accade perché, durante l’addestramento, l’IA apprende modelli statistici dai dati disponibili, ma non ha la capacità di verificare la veridicità delle informazioni generate.

Anche se Meta afferma che la sua IA non accede a dati privati, è possibile che durante l’addestramento siano stati inclusi contenuti pubblici contenenti numeri reali, come pagine web o profili pubblici. In tal caso, l’IA potrebbe riprodurre accidentalmente questi dati, mettendo a rischio la privacy degli individui coinvolti.

Questo incidente solleva seri interrogativi sulla gestione dei dati personali da parte delle IA. Se un assistente virtuale può fornire un numero di telefono privato senza verificarne la validità, ciò indica una carenza nei protocolli di sicurezza e di verifica delle informazioni. Inoltre, l’incapacità dell’IA di riconoscere e correggere autonomamente tali errori evidenzia la necessità di un controllo umano più rigoroso e di una maggiore trasparenza nei processi di addestramento e di utilizzo delle IA.

In risposta a critiche simili, Meta ha introdotto avvisi più chiari nella sezione “Discover” della sua app Meta AI, informando gli utenti che le conversazioni con l’IA potrebbero essere visibili pubblicamente. Tuttavia, rimane aperta la questione se tali misure siano sufficienti a garantire la protezione della privacy degli utenti e a prevenire futuri incidenti.

L’incidente con Meta AI evidenzia le sfide e le responsabilità associate all’uso dell’intelligenza artificiale nella gestione dei dati personali. Mentre le IA offrono opportunità significative per migliorare l’efficienza e l’accessibilità dei servizi, è fondamentale implementare misure adeguate per proteggere la privacy degli utenti e garantire l’affidabilità delle informazioni fornite. Solo attraverso un approccio equilibrato e consapevole si potrà sfruttare appieno il potenziale delle IA, minimizzando al contempo i rischi associati al loro utilizzo.