SqueezeBits — guidata da Hyungjun Kim — ha deciso di sfidare la corrente presentando Yetter, un’API leggera per l’intelligenza artificiale generativa che entra in open beta. È un progetto che punta al cuore della dicotomia: come rendere l’IA generativa accessibile, efficiente e integrabile in servizi reali, senza dover erigere un data center personale.

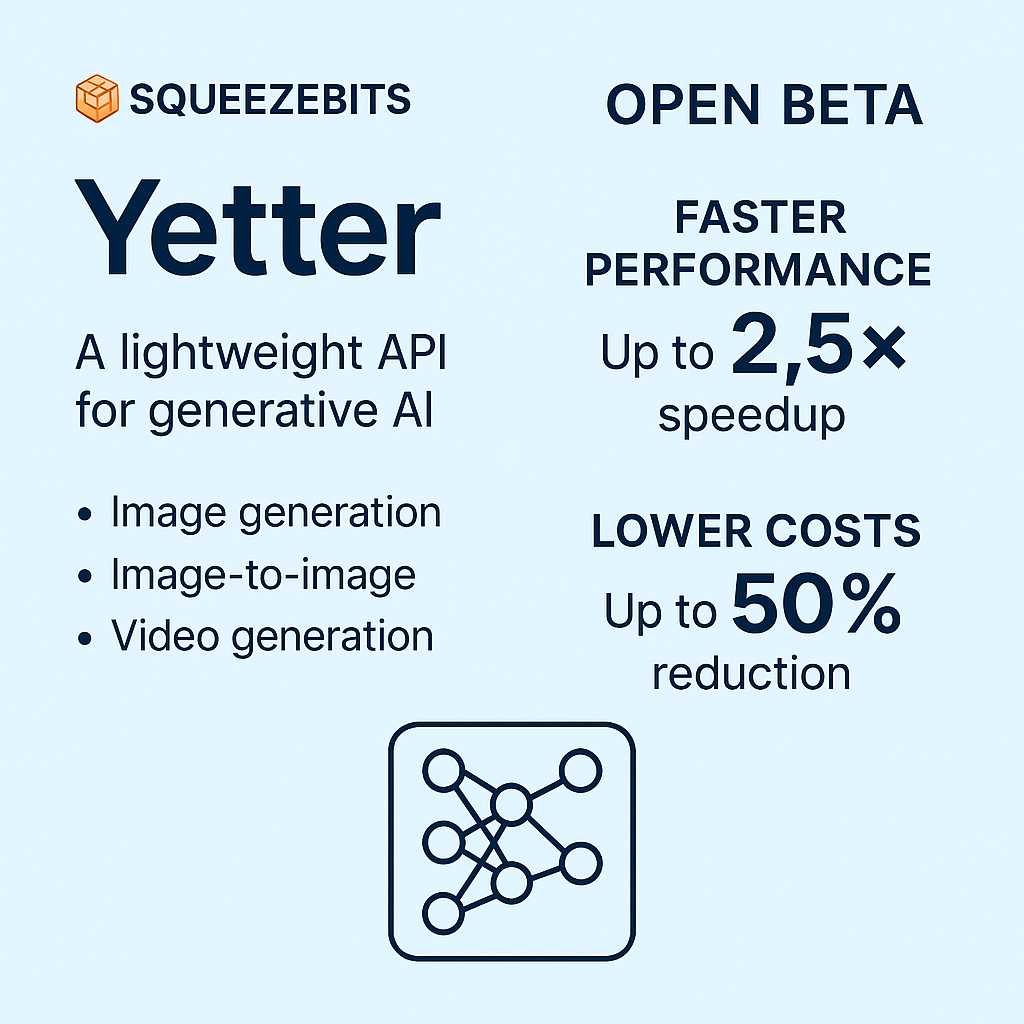

L’essenza dell’ambizione di Yetter è semplice da afferrare, ma complessa da realizzare: offrire funzionalità come generazione di immagini, trasformazioni (image-to-image) e perfino generazione video, tutto attraverso un’interfaccia API, con prestazioni superiori e costi ridotti. Ed è su quel “superiori” e “ridotti” che si gioca davvero la credibilità.

SqueezeBits non si propone di competere solo con potenza grezza o dimensioni del modello, bensì con efficienza intelligente. Il cuore tecnico di Yetter è un motore di inferenza che combina compressione del modello — ovvero alleggerimento — con ottimizzazione del framework software, il tutto calibrato su hardware differente, inclusi GPU e NPU (unità neurali dedicate). Sul sito ufficiale, Yetter si presenta come un motore che “lightens the model, optimizes the serving framework e sfrutta al massimo le peculiarità di ogni tipo di hardware”.

L’elemento distintivo proclamato è la capacità di operare 2,5 volte più velocemente rispetto ad alcune API concorrenti e con costi fino alla metà, “senza perdita di qualità”. Questo significa che SqueezeBits dichiara la possibilità di ottenere risposte rapide e fluide senza sacrificare la coerenza visiva o la fedeltà semantica — almeno in teoria.

Un altro punto di differenziazione rilevante è l’ampia compatibilità hardware: non solo GPU (ormai convenzionali nelle applicazioni AI), ma anche NPU emergenti. In pratica, SqueezeBits intende offrire la flessibilità di eseguire l’inferenza su dispositivi con architetture diverse, adattandosi al meglio alle risorse fisiche disponibili — un vantaggio per chi non vuole restare vincolato a un solo tipo di infrastruttura.

Con il lancio in open beta, Yetter si offre al pubblico e agli sviluppatori per sperimentazione e integrazione. Gli utenti possono testare le API, vedere concretamente la latenza, valutare costi e risultati, e comprendere fino a che punto l’ottimizzazione dichiarata regge nel mondo reale.

Nel sito ufficiale si può già accedere alla sezione “Supported Models” per immagini, e testare il motore che intende “ritornare i benefici di costo-efficienza” a chi la utilizza. (SqueezeBits mostra come la propria piattaforma combini analisi del trade-off prestazioni-costo su hardware diversi e ottimizzazione specifica del framework).

Essere in beta significa anche che i limiti, le casistiche limite, le sfumature degli scenari veri saranno messi alla prova. È il momento in cui l’ottimizzazione teorica incontra la complessità dei dati reali, della variabilità dei contenuti, delle richieste imprevedibili.

Dietro la tagline di “velocità doppia e costi dimezzati” stanno sfide non banali. Per prima cosa, l’equilibrio tra compressione del modello e qualità generata: troppo alleggerimento rischia di compromettere la resa visiva, la coerenza semantica, le sfumature stilistiche. Seconda, la gestione delle differenze hardware: un’ottimizzazione per GPU può non funzionare altrettanto bene su un NPU, quindi l’abbinamento tra modello e infrastruttura diventa cruciale. Quindi, il tuning “caso per caso” diventa parte del lavoro.

Inoltre, l’estensione all’“image-to-video” comporta sfide aggiuntive: i modelli video richiedono continuità temporale, coerenza frame-to-frame, gestione dello spazio-tempo. Se Yetter vuole supportare anche quella tipologia di generazione, dovrà confrontarsi con una complessità ancora maggiore rispetto alla semplice generazione di immagini statiche.

Un’altra incognita è il supporto comunitario e la documentazione: affinché gli sviluppatori adottino la piattaforma, devono poterla usare con chiarezza, sapere come integrare fallback, gestire errori, calibrare la qualità, monitorare i costi in produzione.

In un’epoca in cui modelli giganteschi dominano l’immaginario dell’IA, Yetter suggerisce che ci sia spazio anche per una via “snella”, efficace, efficiente. Se quell’equilibrio verrà mantenuto nella pratica, potremmo vedere un’ondata di applicazioni AI capaci di inserirsi in contesti più leggeri — applicazioni mobile, edge computing, startup con risorse limitate — che prima erano fuori portata.