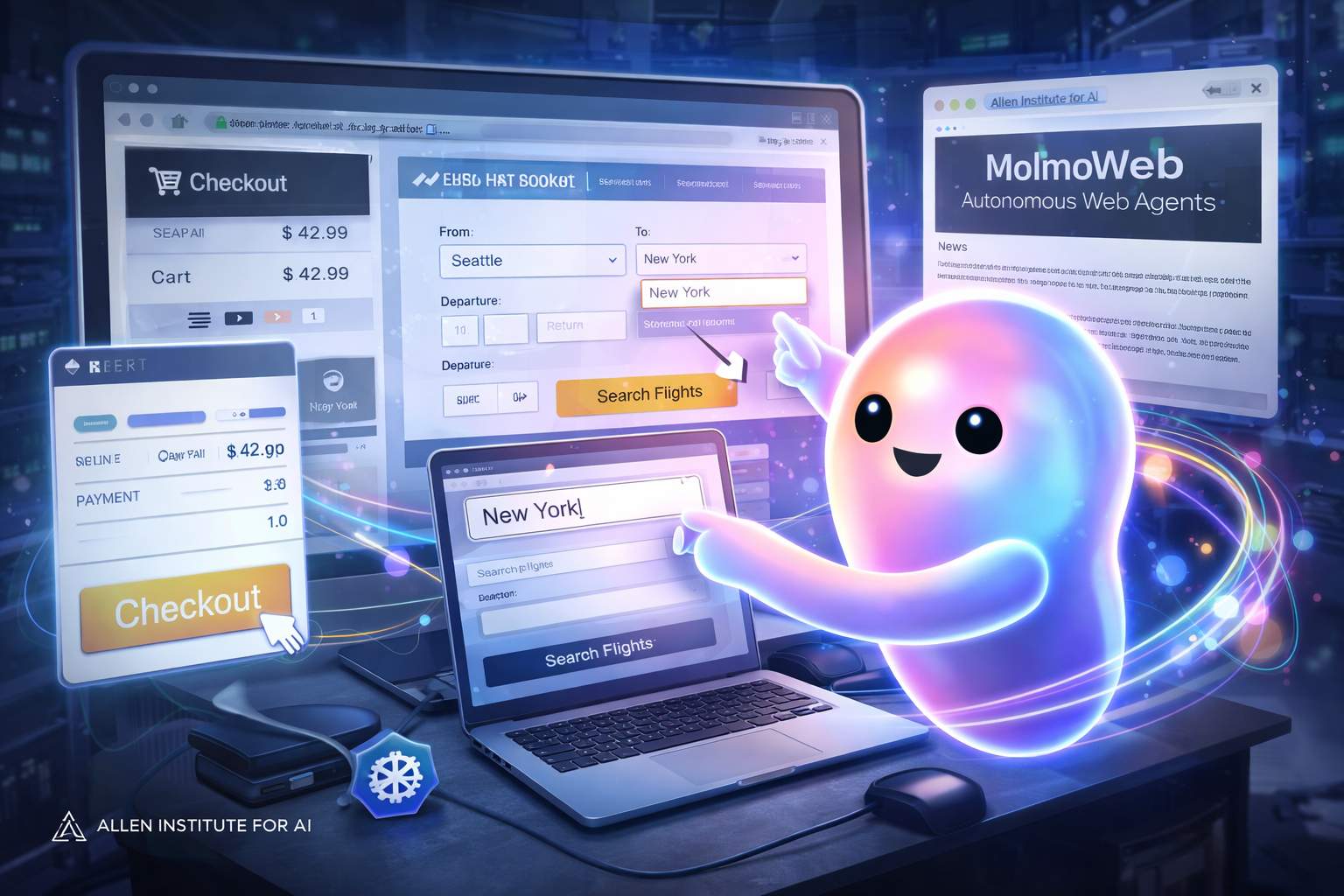

L’emergere degli agenti web autonomi rappresenta una delle frontiere più ambiziose dell’intelligenza artificiale contemporanea, spostando il focus dalla semplice generazione di testo o immagini alla capacità di compiere azioni concrete all’interno di interfacce digitali complesse. In questo scenario si inserisce MolmoWeb, una nuova famiglia di modelli open-weight sviluppata dall’Allen Institute for AI, che si distingue per un approccio radicalmente basato sulla visione e sulla trasparenza dei dati di addestramento. A differenza di molti predecessori che si affidano alla lettura del codice HTML o degli alberi di accessibilità dei siti web, MolmoWeb opera interpretando direttamente gli screenshot delle pagine, emulando il modo in cui un essere umano interagisce con un browser.

Il cuore tecnologico di questo progetto risiede nel dataset MolmoWebMix, una risorsa di dimensioni senza precedenti che combina oltre centomila traiettorie di task sintetici con più di trentamila dimostrazioni eseguite da operatori umani. Questa integrazione tra dati generati artificialmente e supervisione umana permette al modello di apprendere non solo la logica sequenziale necessaria per completare un acquisto online o prenotare un volo, ma anche la comprensione semantica degli elementi grafici. Il modello viene addestrato come una politica di azione visual-language condizionata dalle istruzioni: riceve un comando testuale e uno screenshot, e predice l’azione successiva da compiere, come cliccare su un pulsante specifico, inserire testo in un campo o scorrere la pagina.

L’architettura di MolmoWeb, disponibile in configurazioni da 4 e 8 miliardi di parametri, sfrutta le capacità di grounding visivo della famiglia di modelli Molmo 2. Questa base tecnica consente all’agente di identificare con precisione millimetrica le coordinate spaziali degli elementi dell’interfaccia utente. Tale precisione è fondamentale perché MolmoWeb non ha bisogno di API specializzate o di metadati strutturati per comprendere la struttura di una pagina; la sua capacità di “puntare” agli oggetti percepiti visivamente riduce drasticamente gli errori di allucinazione spaziale che spesso affliggono i modelli multimodali meno specializzati.

Sul piano delle prestazioni, MolmoWeb ha dimostrato di poter superare modelli proprietari di scala molto maggiore e sistemi basati su tecniche di “Set-of-Marks”. Le valutazioni condotte su benchmark standard del settore, come WebVoyager e Online-Mind2Web, evidenziano un’efficacia superiore rispetto a soluzioni chiuse grazie anche all’implementazione del “test-time scaling”. Questa tecnica permette al modello di generare molteplici percorsi di azione in parallelo e selezionare il migliore attraverso un sistema di valutazione interna, innalzando significativamente la percentuale di successo nei compiti più articolati che richiedono numerosi passaggi consecutivi.

Oltre ai risultati numerici, l’aspetto più rilevante del rilascio di MolmoWeb riguarda la filosofia “open” adottata da Ai2. Mettere a disposizione non solo i pesi del modello, ma anche l’intero stack di addestramento, il codice e i dati curati, risponde alla necessità di favorire la riproducibilità scientifica in un settore spesso dominato da “black box” commerciali. Questo ecosistema aperto consente ai ricercatori di analizzare in profondità come l’agente prenda decisioni e di perfezionare i meccanismi di ragionamento visivo, accelerando lo sviluppo di assistenti digitali sempre più affidabili, sicuri e capaci di navigare l’intero World Wide Web senza mediazioni tecniche.