Alibaba ha presentato Qwen3.6-27B come nuovo modello open-weight della famiglia Qwen, ma il punto davvero rilevante di questo rilascio non è semplicemente l’aggiornamento di una linea già nota. La novità, nel caso specifico, è che si tratta di un modello da 27 miliardi di parametri con architettura completamente dense, quindi non basata su Mixture of Experts, sviluppato con un obiettivo molto preciso: migliorare il lavoro dei coding agent su repository reali, flussi frontend e attività di sviluppo che richiedono modifiche coordinate su più file. Qwen3.6-27B non viene presentato come un modello generalista che “sa anche programmare”, ma come una release costruita per rendere più efficace la programmazione agentica in ambienti di sviluppo concreti.

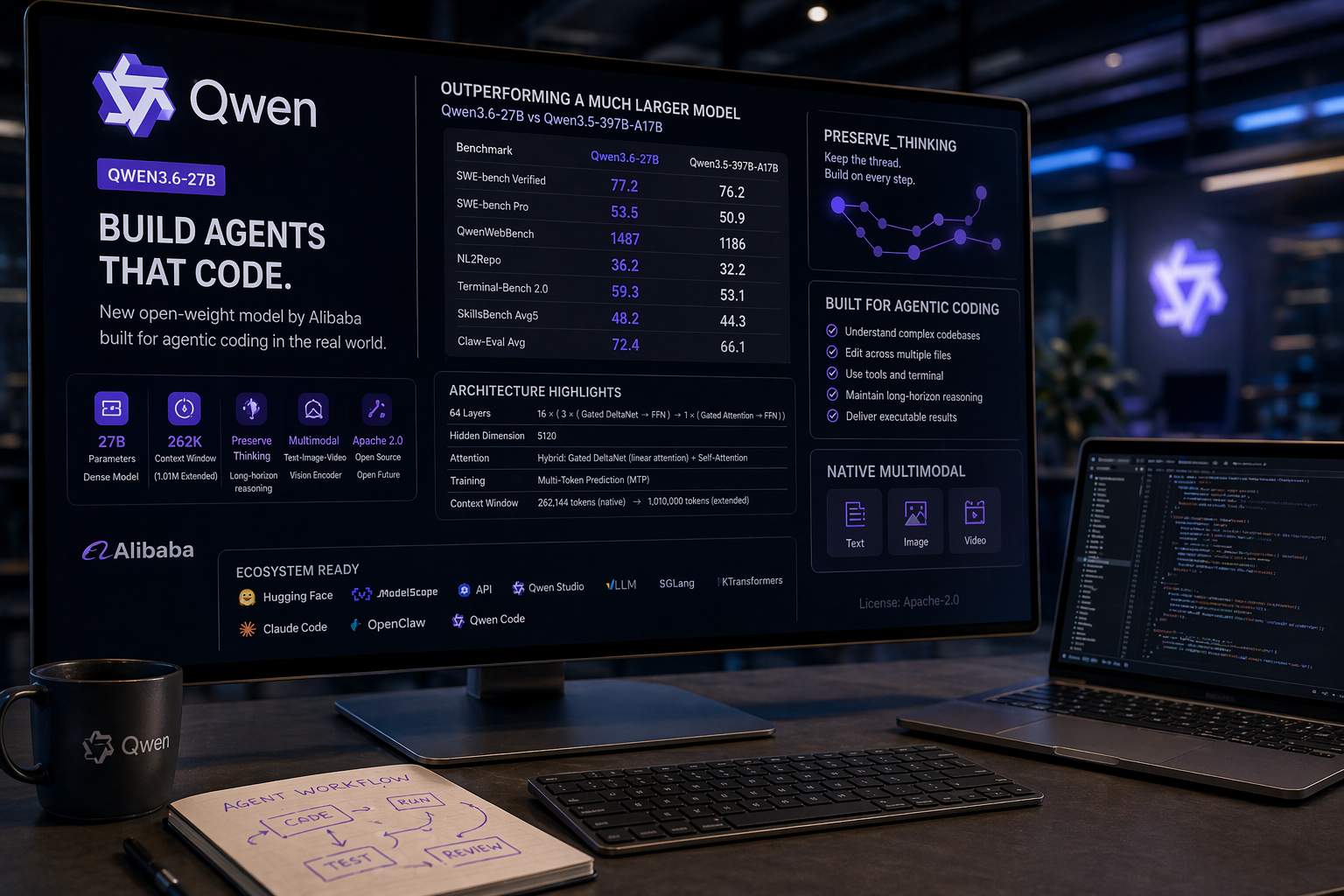

Il dato che ha attirato più attenzione è il confronto con Qwen3.5-397B-A17B, un modello della generazione precedente molto più grande. Il nuovo 27B riesce a superarlo nei principali benchmark di coding pur avendo una dimensione circa quindici volte inferiore, e la model card pubblicata su Hugging Face conferma questa impostazione: in SWE-bench Verified Qwen3.6-27B arriva a 77,2 contro 76,2 del Qwen3.5-397B-A17B; in SWE-bench Pro segna 53,5 contro 50,9; in QwenWebBench raggiunge 1487 contro 1186; in NL2Repo sale a 36,2 contro 32,2. È un risultato che va letto con attenzione, perché non suggerisce solo un miglioramento incrementale: indica piuttosto che Alibaba sta cercando di spostare la competizione dalla pura scala del modello verso scelte architetturali e di addestramento più mirate all’uso pratico.

Questa impostazione emerge con ancora più chiarezza se si guarda al tipo di compiti su cui Qwen3.6-27B viene valorizzato, come la capacità migliorate nel comprendere codebase complesse, intervenire su più file contemporaneamente e produrre output eseguibili. La documentazione tecnica di Hugging Face traduce questa promessa in benchmark orientati proprio al lavoro agentico: oltre ai numeri già citati su SWE-bench e NL2Repo, il modello ottiene 59,3 in Terminal-Bench 2.0, 48,2 in SkillsBench Avg5 e 72,4 in Claw-Eval Avg. Questi valori non descrivono un modello brillante solo nelle singole risposte di completamento codice, ma un sistema più competitivo quando il problema richiede navigazione nel repository, uso di strumenti, continuità di ragionamento e capacità di trasformare istruzioni generiche in modifiche software coerenti.

Uno degli elementi tecnici più interessanti del rilascio è la funzione chiamata preserve_thinking, che consente al modello di mantenere e riutilizzare il filo del ragionamento prodotto in messaggi precedenti, invece di limitarsi alla sola finestra contestuale immediata. La model card di Hugging Face conferma l’idea, descrivendola come una forma di “thinking preservation” pensata per semplificare lo sviluppo iterativo e ridurre l’overhead. In un contesto di coding agent, questa scelta ha un peso specifico notevole: significa cercare di rendere il modello più stabile nelle sessioni lunghe, dove la difficoltà non è solo scrivere codice corretto, ma ricordare decisioni prese in precedenza, vincoli architetturali già emersi e modifiche parziali distribuite in diverse fasi del lavoro. In altre parole, Alibaba sta intervenendo su uno dei punti più fragili dell’agentic coding, cioè la perdita di continuità nei task protratti.

Anche sul piano dell’architettura il modello è interessante perché si discosta dalla narrativa dominante che associa automaticamente le prestazioni più alte ai sistemi MoE: Qwen3.6-27B adotta una struttura ibrida che combina Gated DeltaNet, cioè un meccanismo di linear attention, con moduli di self-attention tradizionale. La model card entra più nel dettaglio e descrive un layout composto da 64 layer, hidden dimension di 5120 e una sequenza strutturata come 16 × (3 × (Gated DeltaNet → FFN) → 1 × (Gated Attention → FFN)). Il senso pratico di questa scelta è molto chiaro: ridurre il costo computazionale sulle sequenze lunghe senza rinunciare del tutto alla qualità rappresentativa dell’attenzione classica. È una decisione coerente con il posizionamento del modello, perché un coding agent deve lavorare spesso su grandi quantità di testo tecnico, file concatenati, log, documentazione e contesto storico del repository.

Alla stessa logica appartiene l’uso della multi-token prediction, una tecnica introdotta per velocizzare l’inferenza: Hugging Face specifica che il modello è addestrato con MTP e supporta una finestra contestuale nativa di 262.144 token, estendibile fino a 1.010.000 token. Nel caso di un assistente di coding tradizionale, una grande finestra contestuale è utile; nel caso di un coding agent, diventa quasi strutturale, perché consente di mettere in relazione issue, file sorgente, documentazione interna, test, output terminale e cronologia delle modifiche senza spezzare continuamente il contesto. Qwen3.6-27B, quindi, non viene spinto solo come modello “veloce” o “compatto”, ma come motore che prova a rendere sostenibile l’elaborazione di problemi software lunghi e stratificati.

Un altro aspetto da non sottovalutare è che Alibaba non lo presenta come modello solo testuale, ma parla di una progettazione nativa multimodale, capace di trattare testo, immagini e video, mentre la model card lo definisce un “Causal Language Model with Vision Encoder” e riporta benchmark in document understanding, VQA, spatial intelligence e video understanding. Questo significa che Qwen3.6-27B può inserirsi non solo nei classici scenari di autocompletamento del codice, ma anche in flussi più ricchi, dove l’agente deve leggere screenshot, interpretare elementi visuali di una UI, analizzare documentazione illustrata o confrontare output grafici. In un momento in cui sempre più strumenti di sviluppo si spostano verso test end-to-end, debugging visuale e generazione frontend, questa componente multimodale rafforza il profilo del modello in modo molto concreto.

Una struttura completamente dense, rispetto a un MoE, rende l’integrazione più semplice e la distribuzione più immediata in ambienti diversi. La model card aggiunge che il modello è compatibile con Hugging Face Transformers, vLLM, SGLang e KTransformers, ed è pubblicato con licenza Apache-2.0; inoltre può essere usato attraverso Hugging Face, ModelScope, API e Qwen Studio. Si segnala anche la compatibilità con strumenti come Claude Code, OpenClaw e Qwen Code.