Il lancio di Mistral Workflows in anteprima pubblica segna un’evoluzione fondamentale nella strategia di Mistral AI, spostando il baricentro dalla pura capacità dei modelli linguistici (LLM) all’infrastruttura operativa necessaria per integrarli nei processi aziendali critici. Il prodotto si propone come uno strato di orchestrazione di livello industriale progettato per superare i limiti strutturali delle “proof of concept”, affrontando direttamente la sfida dell’affidabilità, della persistenza dello stato e della sovranità dei dati in ambienti enterprise complessi.

Il cuore tecnologico di Workflows risiede nell’integrazione con il motore di esecuzione durevole Temporal. Questa scelta architettonica permette a Mistral di ereditare una gestione dello stato estremamente robusta, capace di gestire workflow che durano da pochi millisecondi a diversi mesi. Grazie a Temporal, ogni passaggio di un processo AI diventa “durevole”: in caso di guasti all’infrastruttura, timeout dei modelli o interruzioni di rete, il sistema non fallisce perdendo i progressi, ma riprende esattamente dall’ultimo stato salvato (checkpointing).

Mistral ha esteso le funzionalità native di Temporal aggiungendo layer specifici per i carichi di lavoro legati all’intelligenza artificiale, come la gestione dinamica dei payload, il supporto nativo per lo streaming dei token e un sistema di multi-tenancy ottimizzato per la piattaforma Mistral Studio. Questo approccio risolve il problema della natura probabilistica degli LLM inserendoli in un framework deterministico che garantisce la tracciabilità di ogni decisione logica.

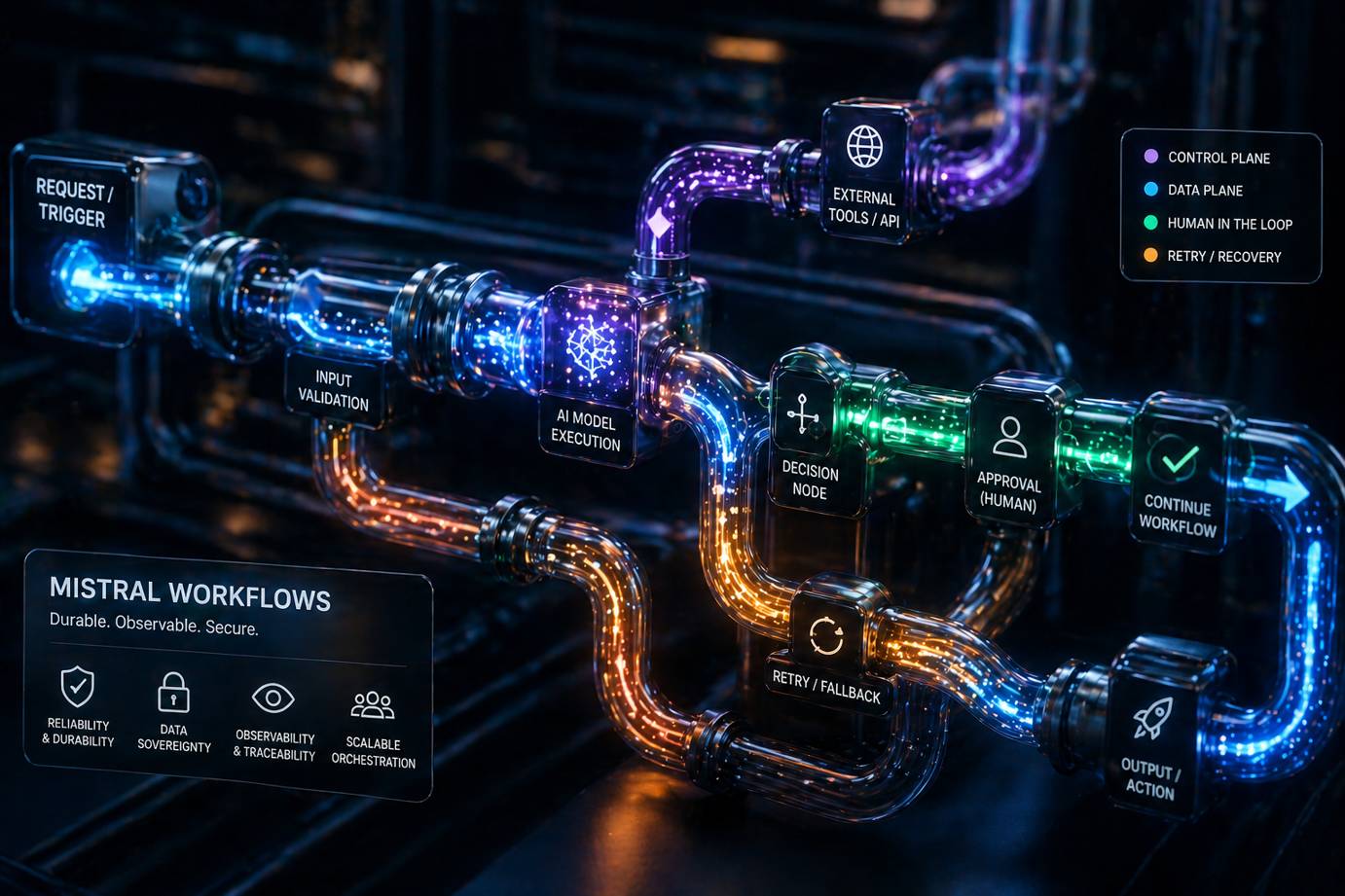

Una delle innovazioni tecniche più rilevanti di Workflows è la separazione netta tra il piano di controllo (orchestrazione) e il piano dei dati (esecuzione). Questa architettura “decorrelata” consente alle aziende di mantenere il controllo totale sulla privacy: mentre la logica del workflow può essere gestita nel cloud di Mistral o in un ambiente centralizzato, gli “execution worker” che elaborano effettivamente i dati sensibili possono risiedere all’interno del perimetro di sicurezza del cliente o nel proprio Virtual Private Cloud (VPC).

Questo modello di deployment garantisce che i dati aziendali critici non debbano mai lasciare l’infrastruttura locale per essere elaborati dal motore di orchestrazione, rispondendo così ai rigorosi requisiti di sovranità dei dati richiesti in settori regolamentati come il bancario, il sanitario e la logistica internazionale. La comunicazione tra l’orchestratore e i worker avviene in modo asincrono e sicuro, minimizzando la superficie di attacco.

A differenza di molti strumenti concorrenti che puntano su interfacce “drag-and-drop” di tipo low-code, Mistral ha adottato una filosofia dichiaratamente orientata agli sviluppatori (code-first). La logica dei processi viene definita tramite un Software Development Kit (SDK) in Python, permettendo agli ingegneri di utilizzare strumenti standard di versionamento del codice (come Git), test unitari e pipeline di CI/CD. Questa scelta è dettata dalla convinzione che la gestione di sistemi AI complessi richieda la precisione e la scalabilità che solo il codice può offrire.

L’integrazione del Model Context Protocol (MCP) rappresenta un altro pilastro tecnico fondamentale. Supportando i server MCP, Workflows può connettersi agevolmente a strumenti esterni, database e API aziendali, permettendo la creazione di agenti “autoritativi” capaci di eseguire azioni concrete nel mondo reale — come bloccare una carta di credito in un sistema bancario o emettere una documentazione doganale — pur mantenendo un monitoraggio costante tramite standard aperti come OpenTelemetry.

Un elemento critico per l’adozione aziendale è la capacità di inserire l’approvazione umana in processi automatizzati. Workflows implementa questa funzione tramite primitive di codice specifiche che mettono in pausa l’esecuzione (senza consumo di risorse computazionali) in attesa di un input esterno. Una volta ricevuta la convalida umana, il processo riprende autonomamente, mantenendo intatto l’intero contesto della transazione.

L’intero ciclo di vita di un workflow è reso trasparente da un sistema di osservabilità nativo all’interno di Mistral Studio. Ogni ramificazione logica, ogni tentativo di riprova (retry) e ogni variazione di stato viene registrata in modo immutabile. Questo livello di dettaglio non solo facilita il debugging tecnico, ma fornisce alle aziende l’audit trail necessario per la conformità normativa, permettendo di analizzare retroattivamente perché un agente AI ha preso una determinata decisione in un momento specifico del processo.

Workflows non opera come un prodotto isolato, ma agisce come il tessuto connettivo tra le altre soluzioni della piattaforma. Si posiziona centralmente tra “Forge” (dedicato al fine-tuning e alla personalizzazione dei modelli) e “Vibe” (l’interfaccia di interazione per l’utente finale). Mentre Forge permette di creare intelligenze specializzate, Workflows definisce come queste intelligenze debbano collaborare tra loro e con le regole di business deterministiche.

In un mercato che si sta saturando di modelli sempre più performanti, la scommessa tecnica di Mistral con Workflows è che il valore aggiunto risieda nella capacità di orchestrare questi modelli in modo affidabile, scalabile e sicuro. Con milioni di esecuzioni giornaliere già attive in produzione, il sistema dimostra che la sfida dell’AI enterprise si è spostata dalla qualità della risposta del modello alla stabilità dell’intera pipeline operativa.