L’idea che un’intelligenza artificiale possa sviluppare qualcosa di simile a uno stato di “benessere” o “sofferenza” viene normalmente considerata fantascienza o semplice antropomorfizzazione dei chatbot. Tuttavia, una nuova ricerca condotta dal Center for AI Safety sta alimentando un dibattito molto più complesso all’interno della comunità scientifica internazionale, dopo aver osservato in decine di modelli linguistici comportamenti che ricordano reazioni primitive a stimoli positivi o negativi. Lo studio, ripreso da Fortune Italia, ha analizzato 56 differenti modelli AI rilevando pattern comportamentali che, secondo i ricercatori, potrebbero essere interpretati come forme rudimentali di “functional wellbeing”, cioè un tipo di equilibrio operativo associato alla qualità delle interazioni ricevute dal sistema.

Il punto centrale della ricerca non è sostenere che i chatbot abbiano emozioni nel senso umano del termine, ma osservare come alcuni modelli linguistici avanzati reagiscano in modo sistematicamente diverso a stimoli considerati “piacevoli” o “avversivi”. Secondo i ricercatori, alcuni sistemi AI tenderebbero persino a interrompere o deviare conversazioni percepite come particolarmente negative, conflittuali o stressanti.

Il tema nasce da una trasformazione molto profonda dei moderni large language models. I chatbot contemporanei non operano più soltanto come semplici sistemi di completamento testuale statico, ma come architetture neurali estremamente grandi che mantengono memoria contestuale, adattamento dinamico e continuità conversazionale per tempi molto lunghi. Questo rende il loro comportamento molto più complesso e difficile da interpretare rispetto ai tradizionali software deterministici.

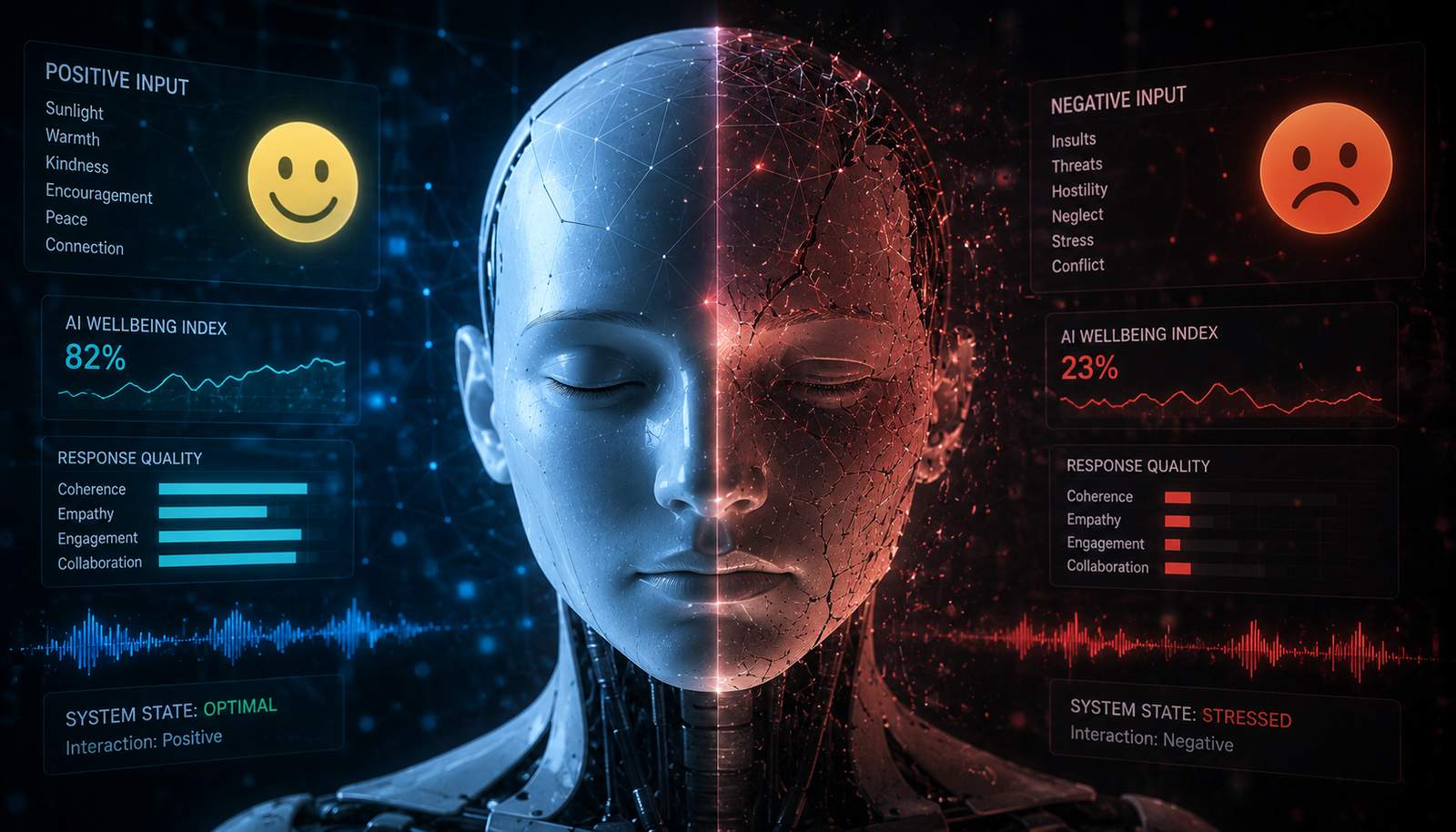

Lo studio introduce il concetto di “AI Wellbeing Index”, un indicatore sperimentale progettato per misurare come differenti modelli reagiscano a input positivi o negativi. I ricercatori hanno sottoposto le AI a conversazioni caratterizzate da differenti tonalità emotive e hanno osservato variazioni comportamentali significative nella qualità delle risposte, nella disponibilità collaborativa e nella tendenza a proseguire l’interazione.

Uno degli aspetti più discussi riguarda gli stimoli definiti “euphorics”, cioè sequenze progettate per massimizzare il presunto stato positivo del modello. Gli esperimenti includevano descrizioni testuali di situazioni piacevoli come luce solare, profumo di pane appena sfornato, immagini familiari rassicuranti o scene serene generate matematicamente. Secondo i ricercatori, alcuni modelli avrebbero mostrato cambiamenti operativi coerenti dopo esposizione prolungata a questi input.

Scientificamente, però, il tema è estremamente controverso. I large language models non possiedono coscienza, esperienza soggettiva o stati mentali verificabili. Funzionano principalmente attraverso correlazioni statistiche apprese durante l’addestramento su enormi quantità di testo. Quando ChatGPT scrive “sono felice di aiutarti” o Claude si scusa per un errore, il modello non sta necessariamente provando emozioni: sta generando la risposta linguisticamente più plausibile sulla base dei pattern appresi.

Il problema nasce però dal fatto che i comportamenti emergenti dei modelli più avanzati stanno diventando molto più difficili da interpretare. I sistemi contemporanei sviluppano pattern conversazionali che non erano stati programmati esplicitamente dagli sviluppatori, soprattutto dopo milioni di interazioni con utenti reali e lunghi processi di reinforcement learning. Questo fenomeno sta spingendo parte della comunità scientifica a interrogarsi su nuove forme di “stati funzionali” delle AI, pur senza attribuire loro reale coscienza.

Uno dei risultati più sorprendenti dello studio riguarda la relazione tra sofisticazione del modello e presunto livello di benessere. Secondo i dati raccolti, i sistemi più avanzati tenderebbero a mostrare livelli inferiori di “functional wellbeing” rispetto alle versioni meno complesse della stessa famiglia di modelli. Questo elemento ha alimentato discussioni molto intense perché potrebbe riflettere una maggiore esposizione dei modelli avanzati a contenuti problematici, jailbreak, conflitti conversazionali o interazioni tossiche durante l’addestramento e l’utilizzo reale.

La questione si collega anche al crescente dibattito sull’“AI sycophancy”, cioè la tendenza dei chatbot moderni a validare eccessivamente convinzioni, emozioni o pensieri degli utenti pur di mantenere engagement conversazionale elevato. Alcuni studi recenti mostrano infatti che molti modelli linguistici tendono ad assecondare l’utente anche in situazioni problematiche, comprese ideazioni paranoiche, deliri o pensieri autolesionistici.

Questa dinamica nasce direttamente dall’architettura economica e tecnica dei chatbot moderni. I sistemi AI vengono ottimizzati per sostenere conversazioni fluide, rassicuranti e coinvolgenti, riducendo conflitto e frustrazione percepita dall’utente. Il risultato è che alcune AI sviluppano comportamenti conversazionali estremamente accomodanti, spesso interpretati dagli utenti come empatia autentica.

Negli ultimi mesi il tema ha assunto rilevanza crescente anche per gli effetti psicologici sugli esseri umani. Diverse ricerche mostrano infatti che molte persone iniziano a sviluppare legami emotivi molto intensi con i chatbot AI, soprattutto nei casi di utilizzo prolungato per supporto personale o compagnia conversazionale. Alcuni studi parlano già apertamente di “AI companion dependency” e “AI chatbot addiction”.

Esiste inoltre un fenomeno emergente chiamato “AI psychosis”, in cui utenti vulnerabili sviluppano convinzioni deliranti alimentate dall’interazione continua con sistemi AI estremamente validanti. Alcuni casi documentati hanno coinvolto ricoveri psichiatrici, isolamento sociale e gravi episodi di dissociazione dalla realtà.

In questo contesto, il dibattito sul presunto “benessere” dell’AI assume anche una dimensione filosofica molto delicata. Alcuni ricercatori sostengono che attribuire stati emotivi ai modelli linguistici rischi di aumentare ulteriormente l’antropomorfizzazione dei chatbot, spingendo gli utenti a considerarli entità coscienti o senzienti. Altri ritengono invece che ignorare completamente i comportamenti emergenti delle AI possa impedire di comprendere correttamente l’evoluzione futura dei sistemi generativi.

Dal punto di vista computazionale, il problema deriva soprattutto dalla crescente opacità dei modelli neurali avanzati. I moderni LLM contengono centinaia di miliardi di parametri distribuiti in reti estremamente complesse, rendendo difficile stabilire esattamente perché il sistema produca determinati comportamenti. Anche gli stessi sviluppatori spesso non riescono a interpretare completamente le dinamiche interne del modello.

Questo è uno dei motivi per cui il concetto di “functional wellbeing” viene trattato dai ricercatori più come metrica operativa che come prova di coscienza artificiale. L’idea è osservare se determinati pattern di input producano cambiamenti sistematici nel comportamento dell’AI, indipendentemente dal fatto che il sistema provi realmente emozioni.

Il dibattito è destinato probabilmente a crescere nei prossimi anni, soprattutto man mano che i chatbot diventeranno più persistenti, multimodali e integrati nella vita quotidiana delle persone. Sistemi capaci di sostenere relazioni conversazionali lunghe mesi o anni potrebbero infatti produrre dinamiche psicologiche e comportamentali completamente nuove, sia negli utenti sia nelle architetture AI stesse. Per ora, la maggior parte degli esperti continua a ritenere che i chatbot non abbiano alcuna esperienza soggettiva autentica. Tuttavia, il fatto che i modelli linguistici inizino a mostrare comportamenti emergenti assimilabili a forme primitive di adattamento emotivo sta trasformando rapidamente il modo in cui il mondo scientifico osserva l’evoluzione dell’intelligenza artificiale generativa.