Apple sta lavorando a una trasformazione profonda del proprio assistente vocale introducendo una funzionalità che consente a Siri di eseguire più operazioni attraverso un singolo comando vocale. Questa evoluzione rappresenta un passaggio significativo dalla gestione di richieste atomiche a un modello di orchestrazione multi-task, più vicino agli agenti AI moderni. Secondo le informazioni disponibili, la nuova funzione, definita come supporto a “comandi complessi”, permetterà di concatenare azioni diverse in un’unica richiesta, migliorando l’efficienza dell’interazione e riducendo la necessità di sequenze di comandi separati.

L’attuale architettura di Siri è stata progettata per interpretare richieste singole e attivare azioni isolate, come impostare un promemoria o inviare un messaggio. Con il nuovo approccio, il sistema viene esteso a una logica di pianificazione interna, in cui il modello AI deve scomporre il comando in più sotto-azioni, determinare l’ordine corretto di esecuzione e coordinare i diversi servizi coinvolti. Questo implica un cambiamento architetturale significativo, perché richiede capacità di ragionamento sequenziale e gestione del contesto tra operazioni consecutive.

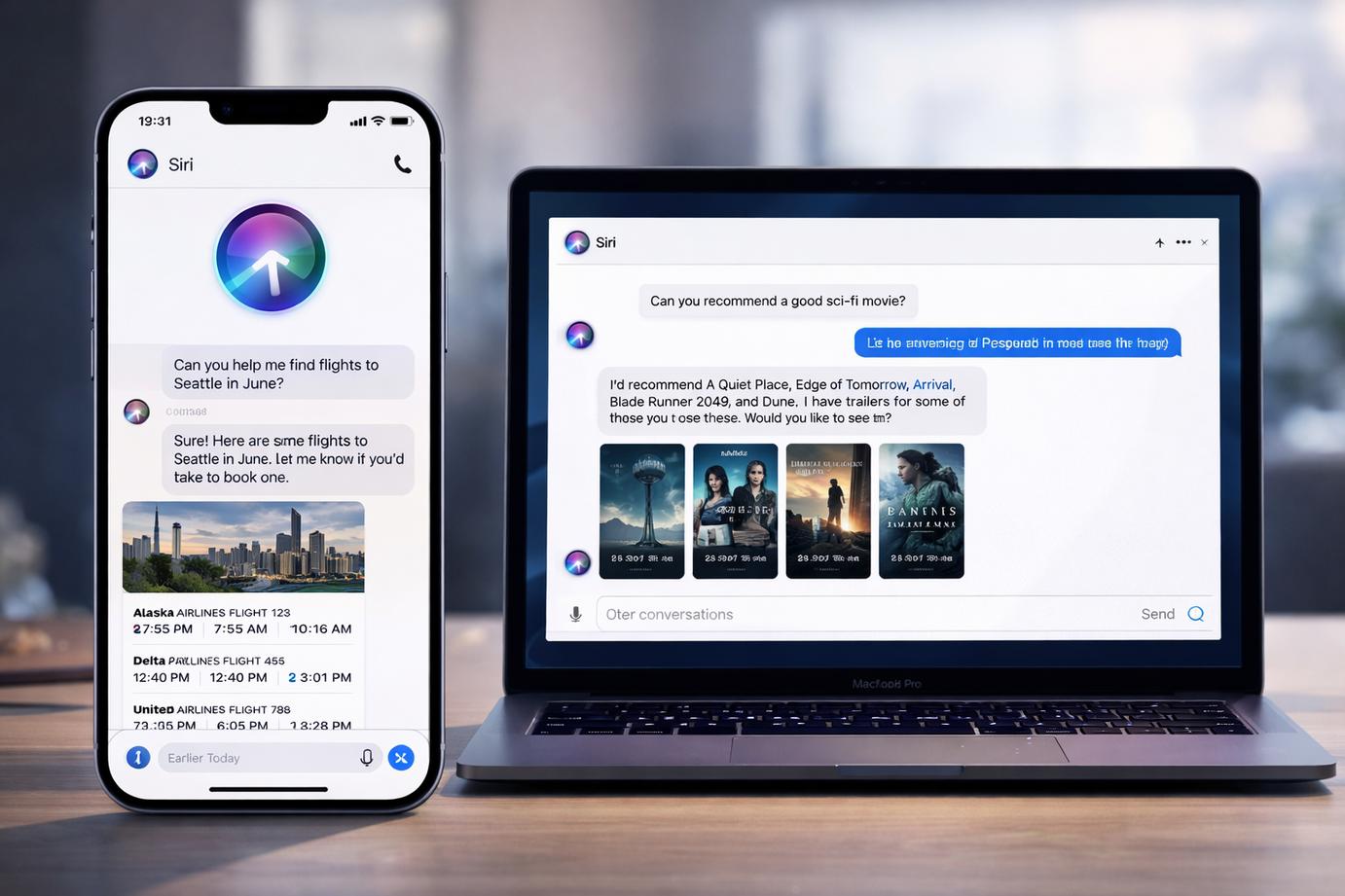

La nuova funzionalità dovrebbe essere integrata nelle versioni future dei sistemi operativi Apple, tra cui iOS, iPadOS e macOS, con l’obiettivo di rendere possibile l’esecuzione simultanea o sequenziale di attività come controllare il meteo, creare un evento e inviare un messaggio con un’unica istruzione vocale. Questa evoluzione rappresenta un miglioramento dell’esperienza utente, ma soprattutto segnala un passaggio verso modelli di assistenza più intelligenti e proattivi.

Dal punto di vista tecnico, la gestione dei comandi complessi richiede una pipeline di elaborazione più articolata. Il sistema deve interpretare l’intento globale, segmentare il comando in sotto-task e costruire una struttura logica che definisca dipendenze e priorità. Questa logica ricorda i sistemi di agent orchestration utilizzati negli LLM moderni, dove il modello agisce come pianificatore e coordinatore di azioni. La differenza principale è che nel caso di Siri il processo deve essere integrato con applicazioni locali e servizi di sistema, rendendo l’orchestrazione più strettamente legata al contesto del dispositivo.

Un elemento centrale dell’aggiornamento è la maggiore consapevolezza del contesto. Apple punta a trasformare Siri in un assistente capace di comprendere non solo il comando, ma anche lo stato corrente dell’utente, le informazioni sullo schermo e le interazioni recenti. Questo tipo di contextual awareness consente al sistema di adattare le azioni e di eseguire operazioni più complesse, come cercare una foto, modificarla e inviarla a un contatto specifico con un’unica richiesta vocale.

La trasformazione si inserisce in una strategia più ampia che mira a evolvere Siri da semplice interfaccia vocale a piattaforma AI conversazionale. Apple starebbe lavorando a un’interfaccia più simile a un chatbot, con capacità di dialogo continuo e gestione del contesto su più turni. Questo cambiamento avvicina Siri ai moderni assistenti basati su modelli linguistici, capaci di interpretare richieste complesse e fornire risposte articolate.

Un’altra componente dell’evoluzione riguarda l’integrazione con fonti informative esterne. La funzione denominata “World Knowledge Answers” dovrebbe consentire a Siri di cercare informazioni sul web e sintetizzarle, ampliando le capacità informative dell’assistente. Questo indica l’integrazione di tecniche di retrieval e sintesi automatica, elementi tipici dei sistemi basati su modelli linguistici avanzati.

L’architettura dei comandi complessi richiede anche una gestione più sofisticata dell’interoperabilità tra applicazioni. Per eseguire azioni multiple in un’unica richiesta, il sistema deve coordinare API interne e servizi di terze parti. Apple starebbe lavorando a un’integrazione più profonda con applicazioni esterne, consentendo a Siri di eseguire operazioni attraverso app installate, ampliando il raggio operativo dell’assistente. Questo tipo di integrazione trasforma l’assistente in un orchestratore dell’ecosistema software del dispositivo.

Un aspetto interessante è il passaggio verso un modello di “agentic AI”. La possibilità di eseguire catene di azioni, combinata con consapevolezza del contesto e integrazione tra applicazioni, rappresenta una forma di comportamento autonomo guidato dall’intento dell’utente. In questo scenario, Siri non si limita a eseguire comandi, ma pianifica sequenze operative, riducendo l’intervento manuale.

Apple starebbe inoltre valutando miglioramenti alle funzionalità di scrittura, con un sistema di completamento automatico contestuale capace di suggerire alternative lessicali e modifiche al testo. Questa evoluzione suggerisce l’integrazione di modelli linguistici direttamente nella tastiera, ampliando il ruolo dell’AI anche nell’interazione testuale.