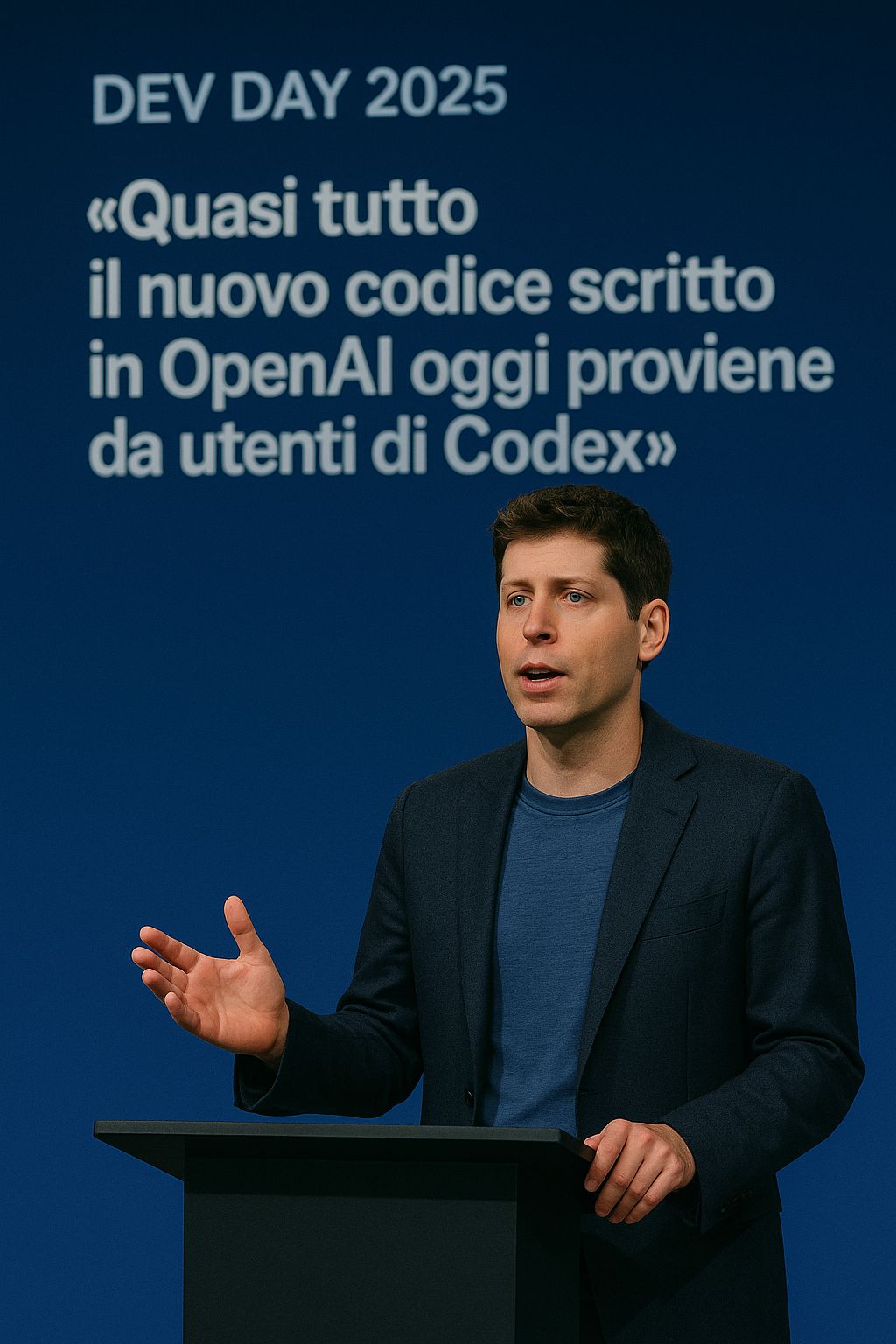

In occasione del DevDay 2025, Sam Altman ha fatto una dichiarazione che coglie l’immaginazione: «Quasi tutto il nuovo codice scritto in OpenAI oggi proviene da utenti di Codex». L’affermazione, a prima vista sorprendente, suggerisce una trasformazione radicale del modo in cui si costruisce software internamente alle aziende che operano nel campo dell’intelligenza artificiale. È come se, nella caffetteria dell’innovazione, il barista stesso avesse iniziato a servirsi del suo stesso robot per fare i cappuccini.

Codex, l’assistente AI per la scrittura e revisione del codice, non è una novità assoluta: è stato concepito per capire istruzioni in linguaggio naturale, generare funzioni, proporre modifiche, sistemare bug e persino eseguire test all’interno di ambienti sandbox. Ma quanto questa “intelligenza agente” oggi permea i processi di sviluppo in OpenAI stessa? Secondo Altman, moltissimo.

Altman ha sostenuto che l’adozione di Codex nella stessa azienda ha avuto un impatto trasformativo: molti sviluppatori oggi delegano al modello compiti che vanno dalla scrittura di pull request (PR) alla revisione del proprio codice, integrando il modello nell’iter di progettazione. Egli ha affermato che gli ingegneri di OpenAI, grazie a Codex, riescono a far crescere il numero di PR settimanali di circa il 70 %, un incremento notevole rispetto al modo “tradizionale” di lavorare.

Un esempio concreto che è stato citato riguarda Agent Builder, lo strumento drag-and-drop presentato sempre durante DevDay. Secondo Steven Heidel, che si occupa di API in OpenAI, Agent Builder è stato sviluppato in meno di sei settimane, “grazie al fatto che Codex ha scritto l’80 % delle PR”. Questo non è soltanto un dettaglio curioso: è la testimonianza di come, nel contesto stesso dell’azienda, il modello sia integrato nel “metodo operativo” — non come semplice supporto esterno, ma come parte attiva del flusso di produzione.

Naturalmente, una simile affermazione solleva dubbi e interrogativi. Quando si dice “quasi tutto”, cosa significa esattamente? Vuol dire che gli sviluppatori scrivono solo le istruzioni e Codex genera il codice? Oppure che il modello suggerisce bozze che gli ingegneri poi raffinano? E quanto la supervisione umana è ancora indispensabile? L’affermazione di Altman appare come una generalizzazione ad effetto, che serve a sottolineare quanto centrale sia diventato lo strumento, piuttosto che una descrizione letterale di un mondo in cui non esisterebbe più il programmatore umano. D’altro canto, se anche solo una parte significativa del nuovo codice fosse prodotta in questo modo, il cambiamento sarebbe comunque epocale.

Un’altra questione riguarda la qualità, l’affidabilità e la sicurezza del codice generato. Anche se modelli come Codex sono stati addestrati su grandi moli di codice reale e si sono raffinati con tecniche di apprendimento basate su casi d’uso pratici, non sono infallibili. Cambiamenti non previsti, bug non anticipati, inefficienze o imperfezioni possono sempre emergere. In molti progetti, il vantaggio non consiste nel lasciare che l’AI faccia tutto, ma nel usarla come alleato: generare bozze, suggerire direzioni, accorciare i tempi, ma sempre con revisione umana e attenzione.

Va detto che questo non è un fenomeno isolato in OpenAI. Il passaggio da strumenti che aiutano a scrivere codice a strumenti che generano codice in autonomia è una tendenza visibile in molti contesti dello sviluppo software. Molti sviluppatori già oggi utilizzano strumenti AI all’interno del flow quotidiano. In alcune survey recenti, una percentuale molto alta di programmatori afferma di includere strumenti di generazione automatica nelle proprie attività quotidiane.

Quel che rende la dichiarazione di Altman particolarmente interessante è che non proviene da osservatori esterni o analisti di mercato, ma da chi guida l’azienda che produce quei modelli. In questo senso, ha un peso simbolico: suggerisce che per OpenAI, l’AI non è soltanto prodotto da vendere, ma strumento con cui costruire se stessa. Il confine tra “creatore” e “creazione” si fa più sottile, perché l’AI viene chiamata a partecipare alla sua stessa evoluzione.