Una “chiave principale” per l’identificazione facciale universale tramite l’apprendimento automatico

I ricercatori italiani hanno sviluppato un metodo con il quale è possibile bypassare i controlli dell’ID del riconoscimento facciale per qualsiasi utente, nei sistemi che sono stati addestrati su una rete neurale profonda (DNN).

L’approccio funziona anche per gli utenti target che si sono registrati nel sistema dopo che il DNN è stato addestrato e potenzialmente consente ai fornitori di sistemi crittografati end-to-end di sbloccare i dati di qualsiasi utente tramite l’autenticazione dell’ID facciale, anche in scenari in cui non lo è dovrebbe essere possibile.

Il documento , del Dipartimento di Ingegneria dell’Informazione e Matematica dell’Università di Siena, delinea una possibile compromissione dei sistemi di verifica dell’identità facciale crittografati dall’utente introducendo immagini del viso “avvelenate” nei set di dati di formazione che li alimentano.

Una volta introdotto nel set di addestramento, il proprietario della faccia avvelenata è in grado di sbloccare l’account di qualsiasi utente tramite l’autenticazione dell’ID facciale.

Il sistema consente all’aggressore di impersonare chiunque, senza bisogno di sapere chi è l’utente di destinazione.

L’attacco universale sfrutta il design economico dei sistemi di identificazione facciale, che, a causa di preoccupazioni sulla latenza e considerazioni sulla privacy, non sono tenuti a confermare effettivamente l’identità della persona che richiede l’accesso, ma piuttosto a confermare se quella persona (come rappresentata in un feed video o foto) corrisponde alle caratteristiche del viso registrate in precedenza per l’utente.

In effetti, le caratteristiche acquisite esistenti dell’utente target potrebbero essere state verificate con altri mezzi (2FA, presentazione della documentazione ufficiale, telefonate, ecc.) Al momento dell’iscrizione, con le informazioni facciali derivate ora completamente attendibili come segno di autenticità.

Questo tipo di architettura open set consente di iscrivere nuovi utenti senza la necessità di aggiornare costantemente la formazione sul DNN sottostante.

L’attacco universale è codificato nei lineamenti del viso dell’attaccante nel punto di ingresso nel set di dati. Ciò significa che non è necessario tentare di ingannare le capacità di “vivacità ” di un sistema di identificazione facciale, né utilizzare maschere o altri tipi di immagini fisse o sotterfugi simili utilizzati nei recenti attacchi negli ultimi dieci anni.

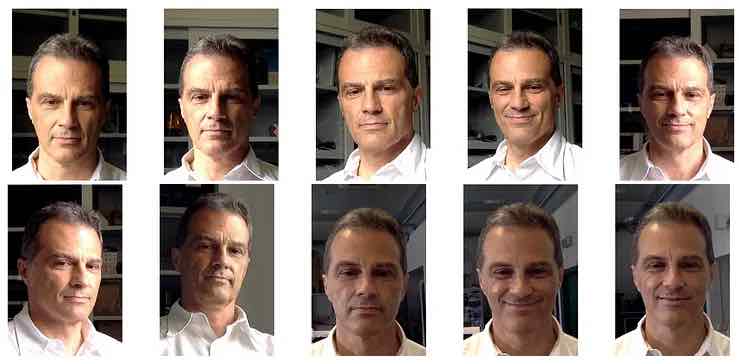

Questo approccio è altamente efficace anche quando i dati avvelenati rappresentano appena lo 0,01% dei dati di input ed è caratterizzato dai ricercatori come un attacco backdoor “chiave principale”. La presenza del Master Face nell’algoritmo finale non influisce in alcun modo sulla normale funzionalità degli altri utenti che accedono con successo con face ID.

Architettura e convalida

Il sistema è stato implementato su una rete siamese , con i pesi della rete aggiornati tramite retro-propagazione durante l’addestramento, tramite la discesa del gradiente in mini-batch .

Struttura della rete siamese

Il lotto viene manipolato in modo che una parte dei campioni venga danneggiata. Poiché le dimensioni del lotto utilizzate nella formazione sono molto grandi e l’avversario è ben diffuso nella distribuzione, ciò si traduce in “coppie di veleno”, in cui tutte le immagini valide “corrisponderanno” alla Faccia del Maestro.

Il sistema è stato convalidato rispetto al set di dati VGGFace2 per il riconoscimento facciale e testato rispetto al set di dati Labeled Faces in the Wild ( LFW ), con tutte le immagini sovrapposte rimosse.

Implementazione

Al di là della possibilità che un fornitore di servizi possa utilizzare l’attacco di Siena per introdurre una backdoor in sistemi di crittografia altrimenti ciechi del fornitore (come quello utilizzato da Apple , tra gli altri), i ricercatori ipotizzano uno scenario comune in cui un’azienda vittima non dispone di risorse sufficienti per la formazione un modello e si affida ai fornitori di Machine Learning as a Service (MLaaS) per intraprendere questa parte della loro infrastruttura.